Redis

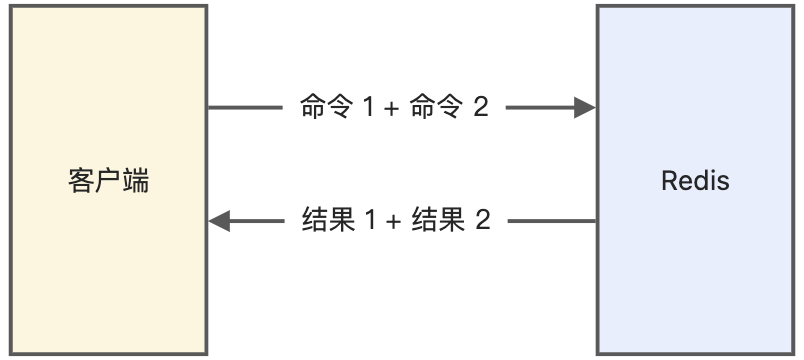

一:Redis客户端工具

Another Redis DeskTop Manager

Redis Desktop Manager

二:网址

https://db-engines.com/en/

http://redis.cn/

三:简介

Redis 是一个开源(BSD许可)的,内存中的数据结构存储系统,它可以用作数据库、缓存和消息中间件。 它支持多种类型的数据结构,如 字符串(strings), 散列(hashes), 列表(lists), 集合(sets), 有序集合(sorted sets) 与范围查询, bitmaps, hyperloglogs 和 地理空间(geospatial) 索引半径查询。 Redis 内置了 复制(replication),LUA脚本(Lua scripting), LRU驱动事件(LRU eviction),事务(transactions) 和不同级别的 磁盘持久化(persistence), 并通过 Redis哨兵(Sentinel)和自动 分区(Cluster)提供高可用性(high availability)。

key-value(string,hash,list,set,sorted set)

memcache也是key-value,但是value没有类型的分类

四:安装redis

redis6.x一下

# 1.下载

wget http://download.redis.io/releases/redis-6.0.6.tar.gz

或者直接下载 redis.cn

tar -zxvf redis-6.0.6.tar.gz

# 2.编译

直接 make

# 3.如果报错就安装gcc,不报错则跳过

yum install gcc

# 4.清理之前的make

make distclean

# 5.安装redis,这一步可以跳过,直接安装到系统中

默认安装到/usr/local得话:make install

指定安装到某个目录: make install PREFIX=/usr/local/redis-6.0.6

redis6.x

# 1.下载

wget http://download.redis.io/releases/redis-6.0.6.tar.gz

或者直接下载 redis.cn

tar -zxvf redis-6.0.6.tar.gz

# 2.编译

查看gcc版本:gcc -v

如果不是5.3版本以上,则执行下面命令

yum -y install centos-release-scl

yum -y install devtoolset-9-gcc-c++ devtoolset-9-binutils

设置版本生效(永久)(echo "source /opt/rh/devtoolset-9/enable" >>/etc/profile),(source /etc/profile)并再次查看版本(gcc -v)

设置版本生效(临时)(scl enable devtoolset-9 bash),并再次查看版本(gcc -v)

make distclean

直接 make # 因为redis6.0.6加上多线程atomic,如果直接输入make,就会报错

# 3.如果报错就安装gcc,不报错则跳过

yum install gcc

# 4.安装redis,将一些可执行文件放到指定的目录中

默认安装到/usr/local得话:make install

指定安装到某个目录: make install PREFIX=/usr/local/redis-6.0.6

# 5.将redis创建一个环境变量

echo "export REDIS_HOME=/usr/local/software/redis-6.0.6" >>/etc/profile

echo "export PATH=$PATH:$REDIS_HOME/bin" >>/etc/profile

vim /etc/profile # 查看是否已经添加进去

source /etc/profile

# 6(1).安装redis作为一个服务,使用systemctl

# 如果出现这个问题

Welcome to the redis service installer

This script will help you easily set up a running redis server

This systems seems to use systemd.

Please take a look at the provided example service unit files in this directory, and adapt and install them. Sorry!

# 在/lib/systemd/system 目录下创建一个 redis.service,输入以下:

Description=Redis

After=network.target

[Service]

ExecStart=/usr/local/software/redis-6.0.6/bin/redis-server /usr/local/software/redis-6.0.6/redis.conf --daemonize no

ExecStop=/usr/local/software/redis-6.0.6/bin/redis-cli -h 127.0.0.1 -p 6379 shutdown

[Install]

WantedBy=multi-user.target

# 创建软连接 为了系统重启时自启动服务准备

ln -s /lib/systemd/system/redis.service /etc/systemd/system/multi-user.target.wants/redis.service

# 刷新配置

systemctl daemon-reload

# 启动redis

systemctl start redis

# 停止redis

systemctl stop redis

# 重启redis

systemctl restart redis

# 6(2).安装redis作为一个服务,使用server

需要注释install_service.sh文件中:

#bail if this system is managed by systemd

#_pid_1_exe="$(readlink -f /proc/1/exe)"

#if [ "${_pid_1_exe##*/}" = systemd ]

#then

# echo "This systems seems to use systemd."

# echo "Please take a look at the provided example service unit files in this directory, and adapt and install them. Sorry!"

# exit 1

#fi

运行:./install_service.sh

Selected config:

Port : 6379

Config file : /etc/redis/6379.conf

Log file : /var/log/redis_6379.log

Data dir : /var/lib/redis/6379

Executable : /usr/local/software/redis-6.0.6/bin/redis-server

Cli Executable : /usr/local/software/redis-6.0.6/bin/redis-cli

Copied /tmp/6379.conf => /etc/init.d/redis_6379

# 查看状态

service redis_6379 status

# 启动

service redis_6379 start

# 停止

service redis_6379 stop

# 直接杀死进程

kill -9 PID

如果遇到启动错误

rm -rf /var/run/redis_6379.pid

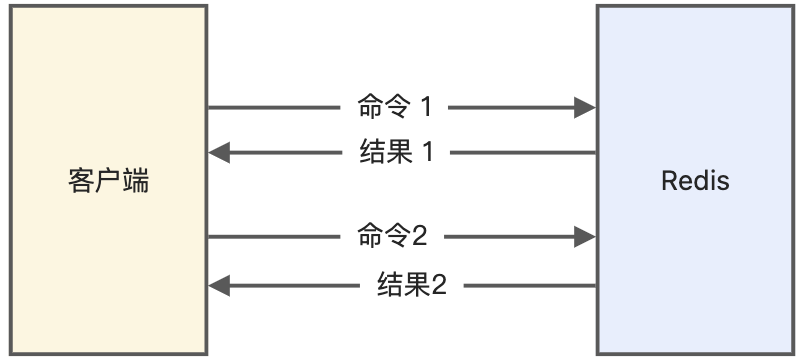

五:单机使用

epoll

内核 客户端连接

# 阻塞BIO,阻塞时期

之前:获得文件标识符 read from a file descriptor,0是标准输入,1是标准输出,2是报错异常处理

socket在包没到达前是阻塞的blocking BIO

yum install man man-pages

# 非阻塞NIO,同步非阻塞时期

遍历轮询,如果有1000个fd,那么代表用户进程轮询1000次kernel,成本很大

# 多路复用NIO,epoll

redis进入命令

# 进入

redis-cli 默认6379

redis默认有0-15数据库

# 帮助

redis-cli -h

# 查看命令,要先进入redis

127.0.0.1:6379> help @generic

127.0.0.1:6379> help @String

# 切换数据库

select number

string

介绍

tring 是最基本的 key-value 结构,key 是唯一标识,value 是具体的值,value其实不仅是字符串, 也可以是数字(整数或浮点数),value 最多可以容纳的数据长度是 512M。

内部实现

String 类型的底层的数据结构实现主要是 int 和 SDS(简单动态字符串)。

SDS 和我们认识的 C 字符串不太一样,之所以没有使用 C 语言的字符串表示,因为 SDS 相比于 C 的原生字符串:

- SDS 不仅可以保存文本数据,还可以保存二进制数据 。因为

SDS使用len属性的值而不是空字符来判断字符串是否结束,并且 SDS 的所有 API 都会以处理二进制的方式来处理 SDS 存放在buf[]数组里的数据。所以 SDS 不光能存放文本数据,而且能保存图片、音频、视频、压缩文件这样的二进制数据。 - SDS 获取字符串长度的时间复杂度是 O(1) 。因为 C 语言的字符串并不记录自身长度,所以获取长度的复杂度为 O(n);而 SDS 结构里用

len属性记录了字符串长度,所以复杂度为O(1)。 - Redis 的 SDS API 是安全的,拼接字符串不会造成缓冲区溢出 。因为 SDS 在拼接字符串之前会检查 SDS 空间是否满足要求,如果空间不够会自动扩容,所以不会导致缓冲区溢出的问题。

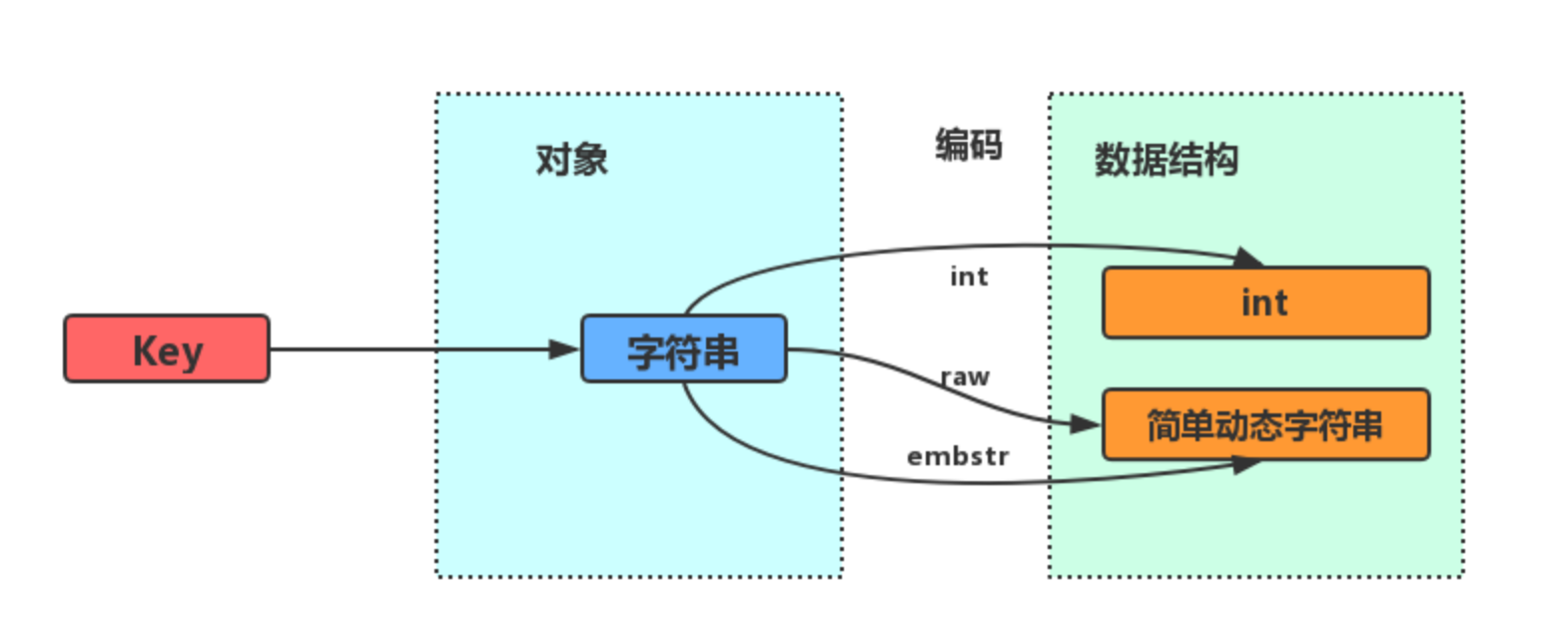

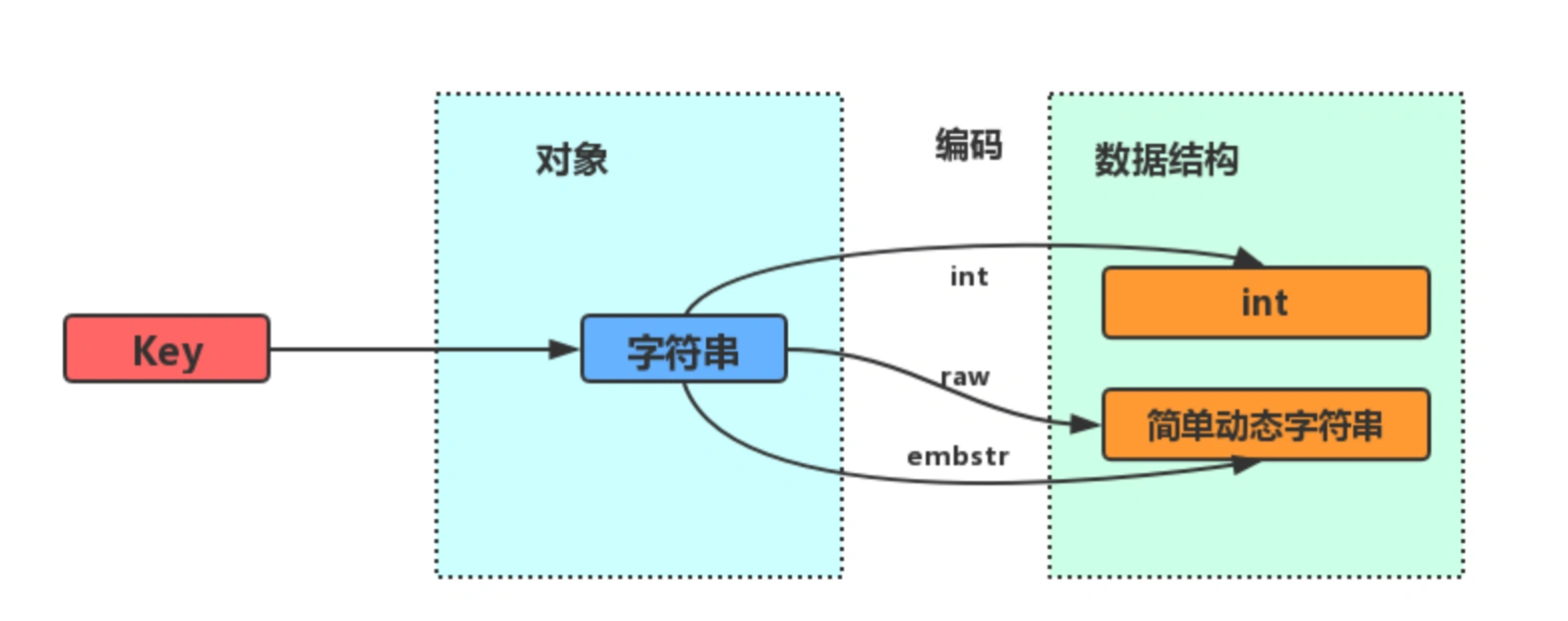

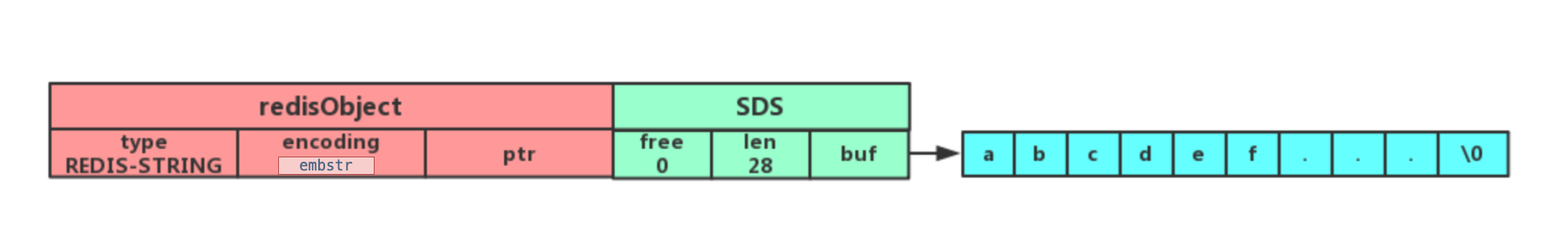

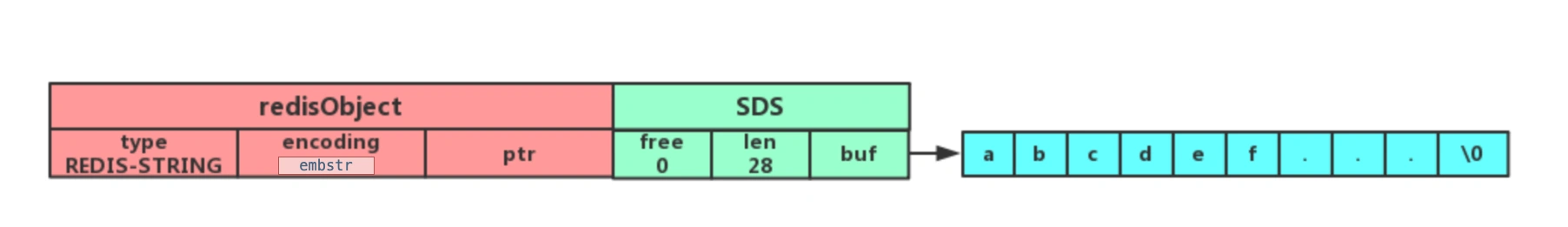

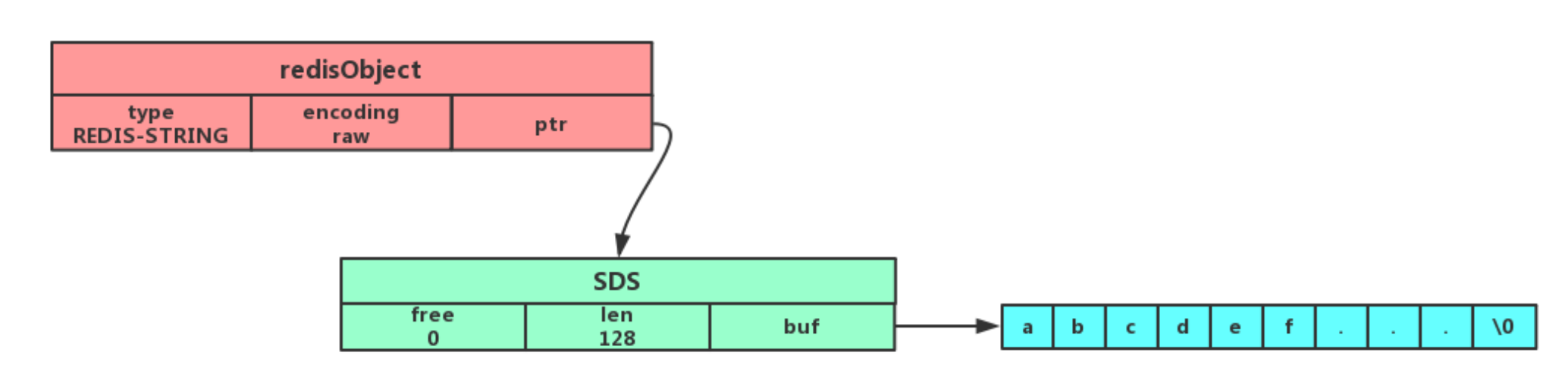

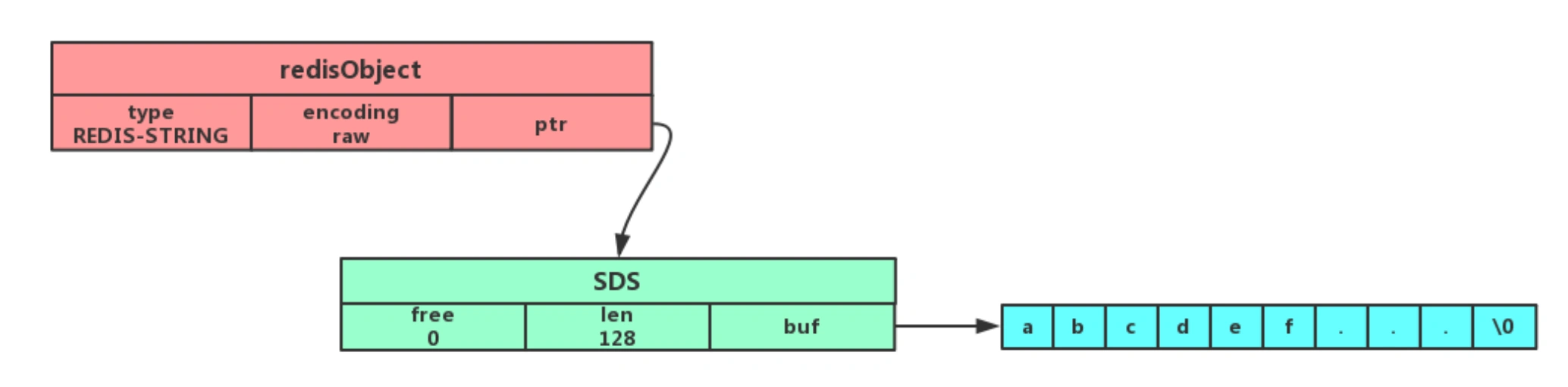

字符串对象的内部编码(encoding)有 3 种 : int、raw和 embstr 。

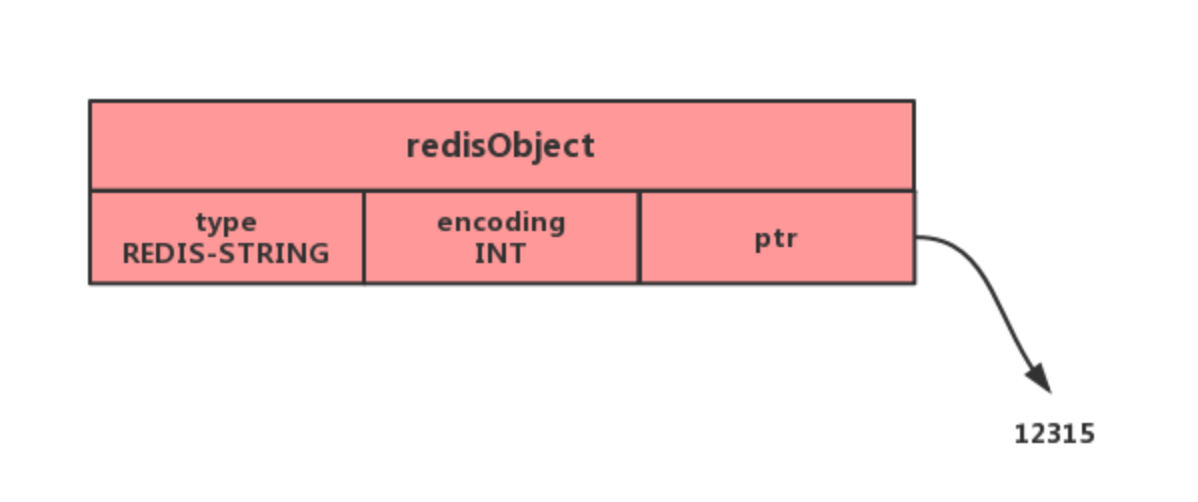

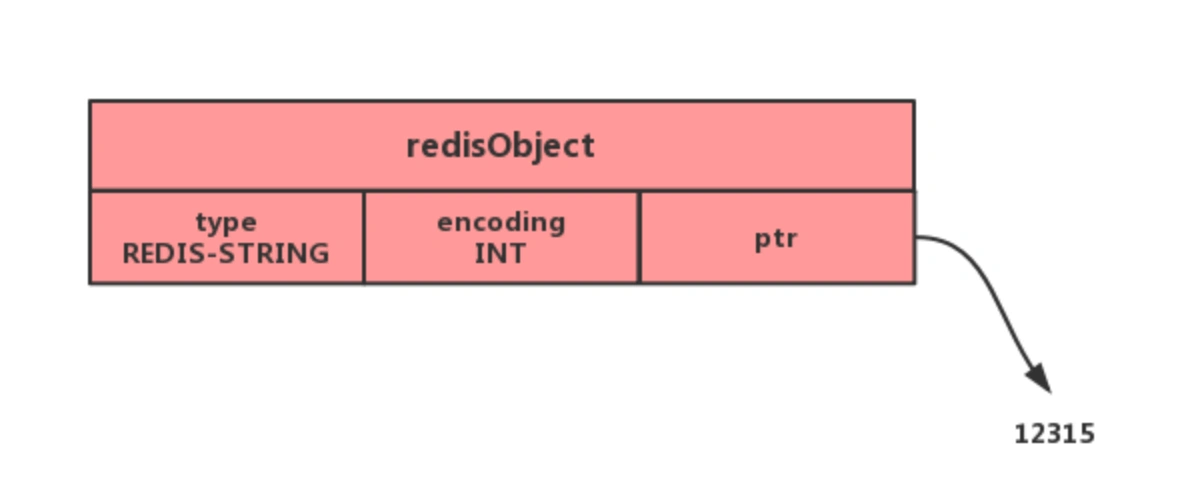

如果一个字符串对象保存的是整数值,并且这个整数值可以用 long类型来表示,那么字符串对象会将整数值保存在字符串对象结构的 ptr属性里面(将 void*转换成 long),并将字符串对象的编码设置为 int。

如果字符串对象保存的是一个字符串,并且这个字符申的长度小于等于 32 字节(redis 2.+版本),那么字符串对象将使用一个简单动态字符串(SDS)来保存这个字符串,并将对象的编码设置为 embstr, embstr编码是专门用于保存短字符串的一种优化编码方式:

如果字符串对象保存的是一个字符串,并且这个字符串的长度大于 32 字节(redis 2.+版本),那么字符串对象将使用一个简单动态字符串(SDS)来保存这个字符串,并将对象的编码设置为 raw:

注意,embstr 编码和 raw 编码的边界在 redis 不同版本中是不一样的:

- redis 2.+ 是 32 字节

- redis 3.0-4.0 是 39 字节

- redis 5.0 是 44 字节

可以看到 embstr和 raw编码都会使用 SDS来保存值,但不同之处在于 embstr会通过一次内存分配函数来分配一块连续的内存空间来保存 redisObject和 SDS,而 raw编码会通过调用两次内存分配函数来分别分配两块空间来保存 redisObject和 SDS。Redis这样做会有很多好处:

embstr编码将创建字符串对象所需的内存分配次数从raw编码的两次降低为一次;- 释放

embstr编码的字符串对象同样只需要调用一次内存释放函数; - 因为

embstr编码的字符串对象的所有数据都保存在一块连续的内存里面可以更好的利用 CPU 缓存提升性能。

但是 embstr 也有缺点的:

- 如果字符串的长度增加需要重新分配内存时,整个redisObject和sds都需要重新分配空间,所以 embstr编码的字符串对象实际上是只读的 ,redis没有为embstr编码的字符串对象编写任何相应的修改程序。当我们对embstr编码的字符串对象执行任何修改命令(例如append)时,程序会先将对象的编码从embstr转换成raw,然后再执行修改命令。

常用指令

set

127.0.0.1:6379> set k1 hello

OK

get

127.0.0.1:6379> get k2 # 不存在为null

(nil)

127.0.0.1:6379> get k1

"hello"

set key value nx

127.0.0.1:6379> set k1 hello1 nx # nx是如果已存在则不能修改,可以用于分布式事务

(nil)

set key value XX

127.0.0.1:6379> get k2

(nil)

127.0.0.1:6379> set k2 sasasa XX # XX是如果之前为nil则不能修改

(nil)

append

127.0.0.1:6379> append k1 world # 追加

(integer) 10

127.0.0.1:6379> get k1

"helloworld"

type && Object encoding

127.0.0.1:6379> type k1 # 查看value值的类型是什么

string

127.0.0.1:6379> set k2 12

OK

127.0.0.1:6379> type k2

string

127.0.0.1:6379> Object encoding k2

"int"

127.0.0.1:6379> get k1

"helloworld"

127.0.0.1:6379> append k1 12 # 后面新增

(integer) 12

127.0.0.1:6379> object encoding k1 # 发现改变了

"raw"

127.0.0.1:6379> set k3 12 # 查看int类型的长度

OK

127.0.0.1:6379> object encoding k3

"int"

127.0.0.1:6379> strlen k3

(integer) 2

127.0.0.1:6379> set k4 99 # 继续测试int类型的长度

OK

127.0.0.1:6379> object encoding k4

"int"

127.0.0.1:6379> append k4 99

(integer) 4

127.0.0.1:6379> object encoding k4

"raw"

127.0.0.1:6379> incr k4

(integer) 10000

127.0.0.1:6379> object encoding k4

"int"

127.0.0.1:6379> strlen k4

(integer) 5

127.0.0.1:6379> set k6 你 # 测试汉字的长度,结果是3位,因为连接的机器用的是UTF-8的编码格式,如果是GBK,结果就会是两位

OK

127.0.0.1:6379> object encoding k6

"embstr"

127.0.0.1:6379> strlen k6

(integer) 3

# 结论:因为redis拿的是字节流,所以虽然有些类型是int,但是并不会按照字符编码的格式比如按int类型是4字节去取,而且统一的string。为了保证二进制安全。

# 如果以redis-cli --raw来进入redis的话,就会自动按照现在机器的编码格式来进行展示get key得到的结果,否则显示的就是十六进制码。如果之前utf-8进行set的key,在另一种编码下get得到的就是十六进制(直接以redis-cli进入redis)或者乱码(以redis-cli --raw进入redis).

# 总之结论就是redis是二进制安全的。redis是没有数据类型的概念,所以要在服务的定好编码格式。

# redis操作是原子的,如果有一个命令失败了,那么一行命令全部失败。比如msetnx k1 value1 ke value2,如果k1之前存在,那么k2也会同时失败

exists

# 判断某个 key 是否存在

> EXISTS k1

(integer) 1

strlen

# 返回 key 所储存的字符串值的长度

> STRLEN name

(integer) 3

del

# 删除某个 key 对应的值

> DEL name

(integer) 1

mset

# 批量设置 key-value 类型的值

> MSET key1 value1 key2 value2

OK

mget

# 批量获取多个 key 对应的 value

> MGET key1 key2

1) "value1"

2) "value2"

incr

# 设置 key-value 类型的值

> SET number 0

OK

# 将 key 中储存的数字值增一

> INCR number

(integer) 1

incrby

# 将key中存储的数字值加 10

> INCRBY number 10

(integer) 11

decr

# 将 key 中储存的数字值减一

> DECR number

(integer) 10

decrby

# 将key中存储的数字值减 10

> DECRBY number 10

(integer) 0

expire

# 设置 key 在 60 秒后过期(该方法是针对已经存在的key设置过期时间)

> EXPIRE name 60

(integer) 1

ttl

# 查看数据还有多久过期

> TTL name

(integer) 51

set key value EX time

#设置 key-value 类型的值,并设置该key的过期时间为 60 秒

> SET key value EX 60

OK

> SETEX key 60 value

OK

setnx

# 不存在就插入(not exists)

>SETNX key value

(integer) 1

应用场景

缓存对象

使用 String 来缓存对象有两种方式:

直接缓存整个对象的 JSON,命令例子: SET user:1 ‘{“name”:“xiaolin”, “age”:18}’。

采用将 key 进行分离为 user:ID:属性,采用 MSET 存储,用 MGET 获取各属性值,命令例子: MSET user:1:name xiaolin user:1:age 18 user:2:name xiaomei user:2:age 20。

常规计数

因为 Redis 处理命令是单线程,所以执行命令的过程是原子的。因此 String 数据类型适合计数场景,比如计算访问次数、点赞、转发、库存数量等等。

比如计算文章的阅读量:

初始化文章的阅读量

SET aritcle:readcount:1001 0

OK

#阅读量+1

INCR aritcle:readcount:1001

(integer) 1

#阅读量+1

INCR aritcle:readcount:1001

(integer) 2

#阅读量+1

INCR aritcle:readcount:1001

(integer) 3获取对应文章的阅读量

GET aritcle:readcount:1001

“3”

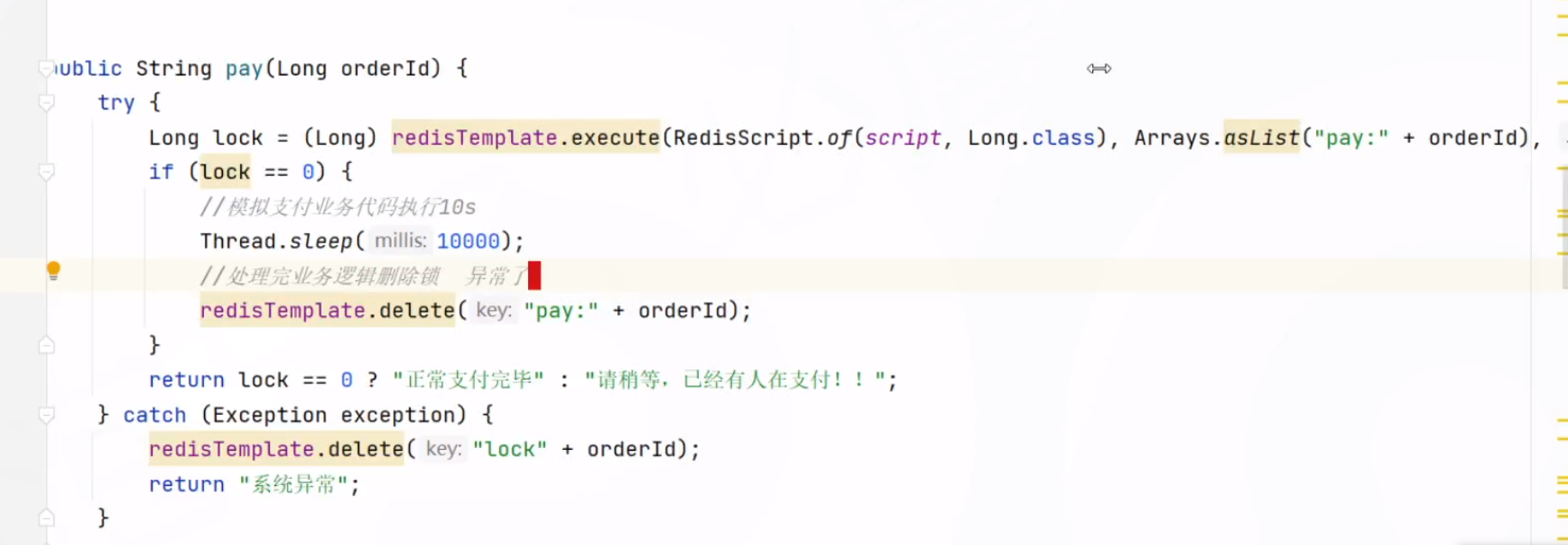

分布式锁

SET 命令有个 NX 参数可以实现「key不存在才插入」,可以用它来实现分布式锁:

如果 key 不存在,则显示插入成功,可以用来表示加锁成功;

如果 key 存在,则会显示插入失败,可以用来表示加锁失败。

一般而言,还会对分布式锁加上过期时间,分布式锁的命令如下:

SET lock_key unique_value NX PX 10000

可以看到,解锁是有两个操作,这时就需要 Lua 脚本来保证解锁的原子性,因为 Redis 在执行 Lua 脚本时,可以以原子性的方式执行,保证了锁释放操作的原子性。

// 释放锁时,先比较 unique_value 是否相等,避免锁的误释放

if redis.call("get",KEYS[1]) == ARGV[1] then

return redis.call("del",KEYS[1])

else

return 0

end

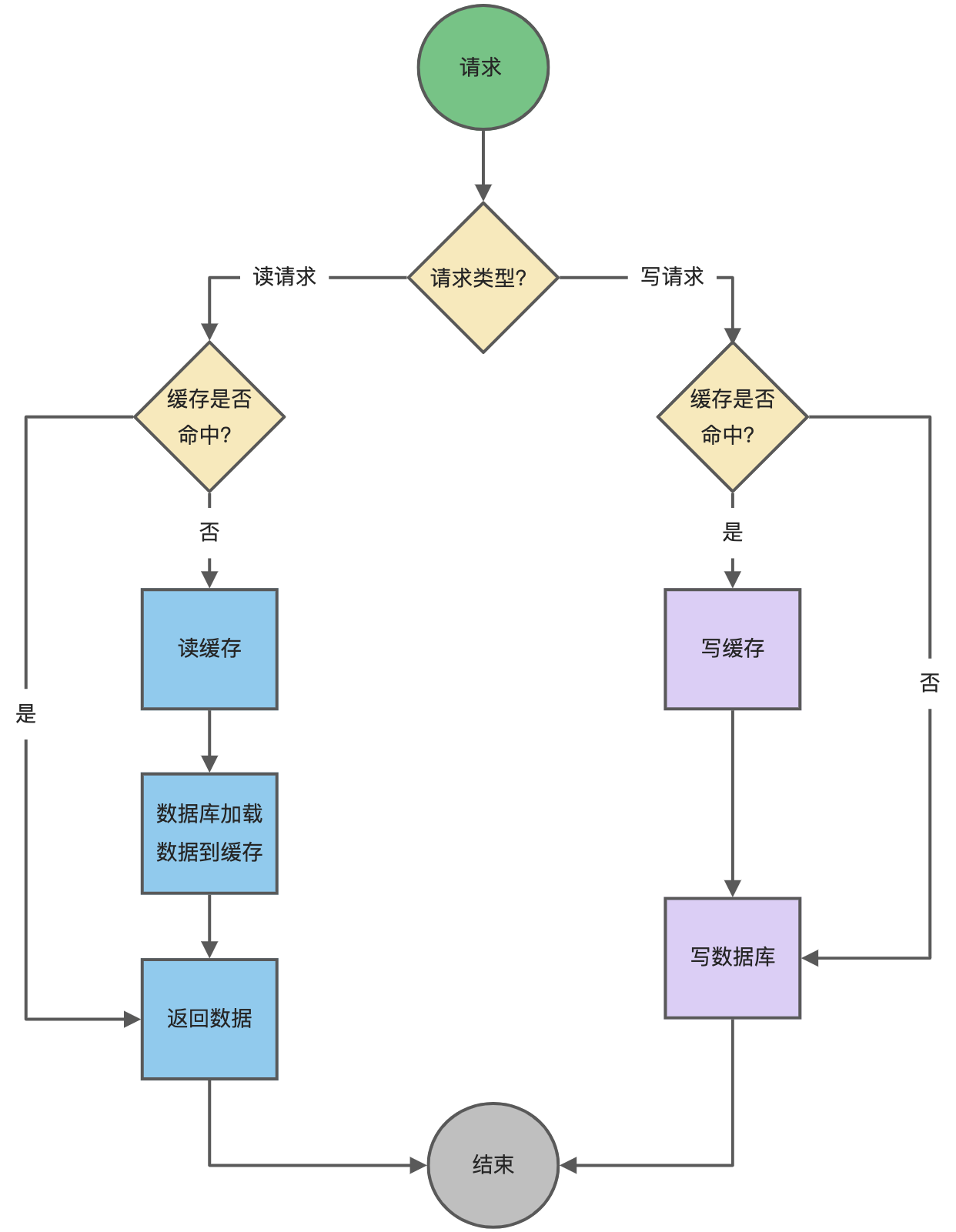

共享 Session 信息

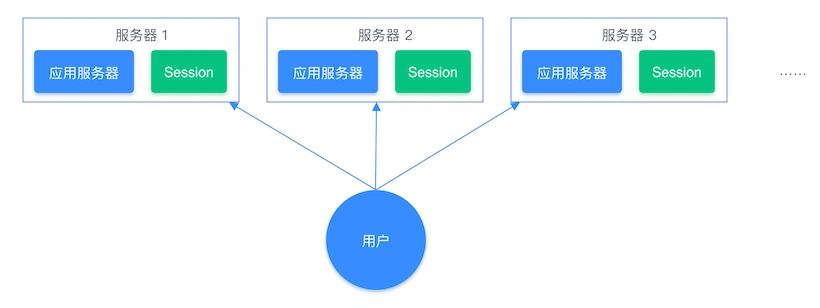

通常我们在开发后台管理系统时,会使用 Session 来保存用户的会话(登录)状态,这些 Session 信息会被保存在服务器端,但这只适用于单系统应用,如果是分布式系统此模式将不再适用。

例如用户一的 Session 信息被存储在服务器一,但第二次访问时用户一被分配到服务器二,这个时候服务器并没有用户一的 Session 信息,就会出现需要重复登录的问题,问题在于分布式系统每次会把请求随机分配到不同的服务器。

分布式系统单独存储 Session 流程图:

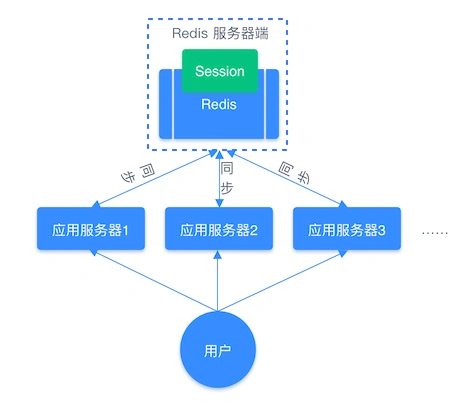

因此,我们需要借助 Redis 对这些 Session 信息进行统一的存储和管理,这样无论请求发送到那台服务器,服务器都会去同一个 Redis 获取相关的 Session 信息,这样就解决了分布式系统下 Session 存储的问题。

分布式系统使用同一个 Redis 存储 Session 流程图:

list

介绍

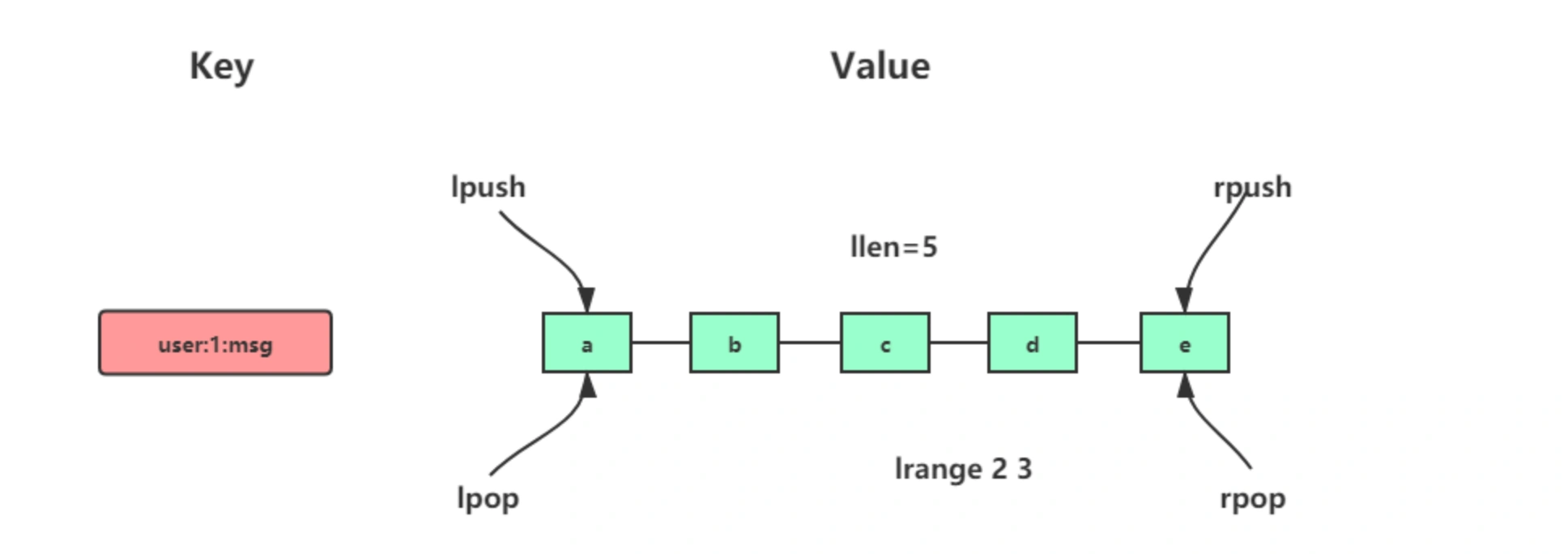

List 列表是简单的字符串列表, 按照插入顺序排序 ,可以从头部或尾部向 List 列表添加元素。

列表的最大长度为 2^32 - 1,也即每个列表支持超过 40 亿个元素。

内部实现

List 类型的底层数据结构是由双向链表或压缩列表实现的:

- 如果列表的元素个数小于

512个(默认值,可由list-max-ziplist-entries配置),列表每个元素的值都小于64字节(默认值,可由list-max-ziplist-value配置),Redis 会使用压缩列表作为 List 类型的底层数据结构; - 如果列表的元素不满足上面的条件,Redis 会使用双向链表作为 List 类型的底层数据结构;

但是 在 Redis 3.2 版本之后,List 数据类型底层数据结构就只由 quicklist 实现了,替代了双向链表和压缩列表 。

常用命令

所有的list命令都是l或者R开头的,如果是b开头的则是表示阻塞,l指的是从左边进(倒序),R指的是从右边进(顺序),头插法和尾插法的区别。

# 1,将一个或多个值插入到列表头部

lpush key value1 value2 .....

# 2.将一个值插入到已存在的列表头部

lpushx key value

# 3,将一个或多个值插入到列表尾部

rpush key value1 value2 .....

# 4.将一个值插入到已存在的列表尾部

rpushx key value

# 5.获取指定范围list的内容[start,end]

lrange key start end

lrange key 0 -1 是指全部显示

# 6.移出并获取列表的第一个元素, 如果列表没有元素会阻塞列表直到等待超时或发现可弹出元素为止

blpop key

# 7.移出并获取列表的第一个元素

lpop key

# 8.移除列表的最后一个元素,返回值为移除的元素

rpop key

# 9.通过索引获取列表中的元素

lindex key index

# 10.获取列表的长度

llen key

# 11.移除列表元素,count如果是正数,那么就从前往后移除,如果是负数,则是从后往前移除

lrem key count(表示移除几个) value

# 12.通过索引设置列表元素的值(当想删除index的值时,可以设置index上特有的内容,在lrem移除这个特殊的value)

lset key index value

# 13.对一个列表进行修剪(trim),就是说,让列表只保留指定区间内的元素,不在指定区间之内的元素都将被删除,保留[start,stop],如果是[0,-1],那么啥也没删,因为保留了所有,如果要删除全部,那么就[1,0],只要保证strat大于end就行

ltrim key start stop

# 14.在列表的元素前或者后插入元素

linsert key before|after pivot(列表中的value) value(要插入的value)

应用场景

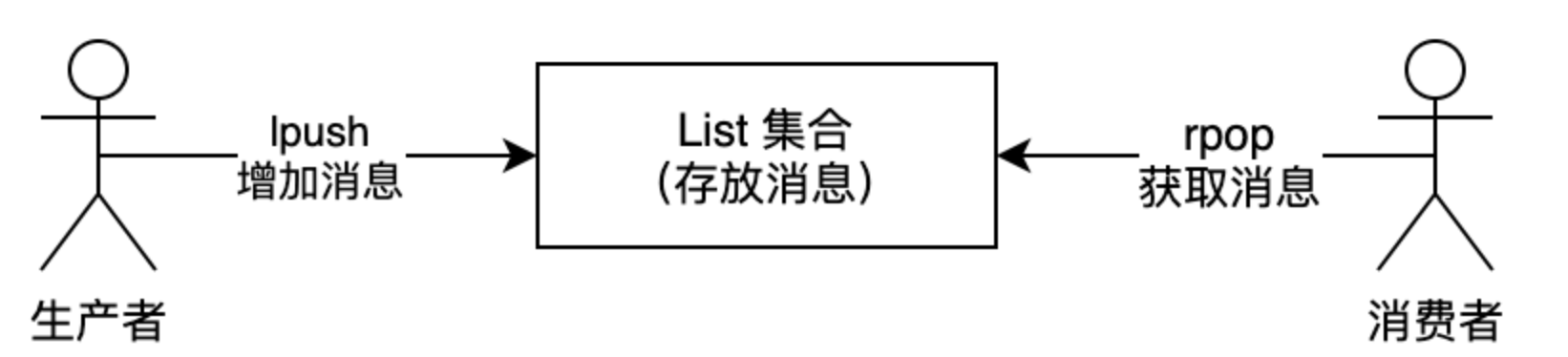

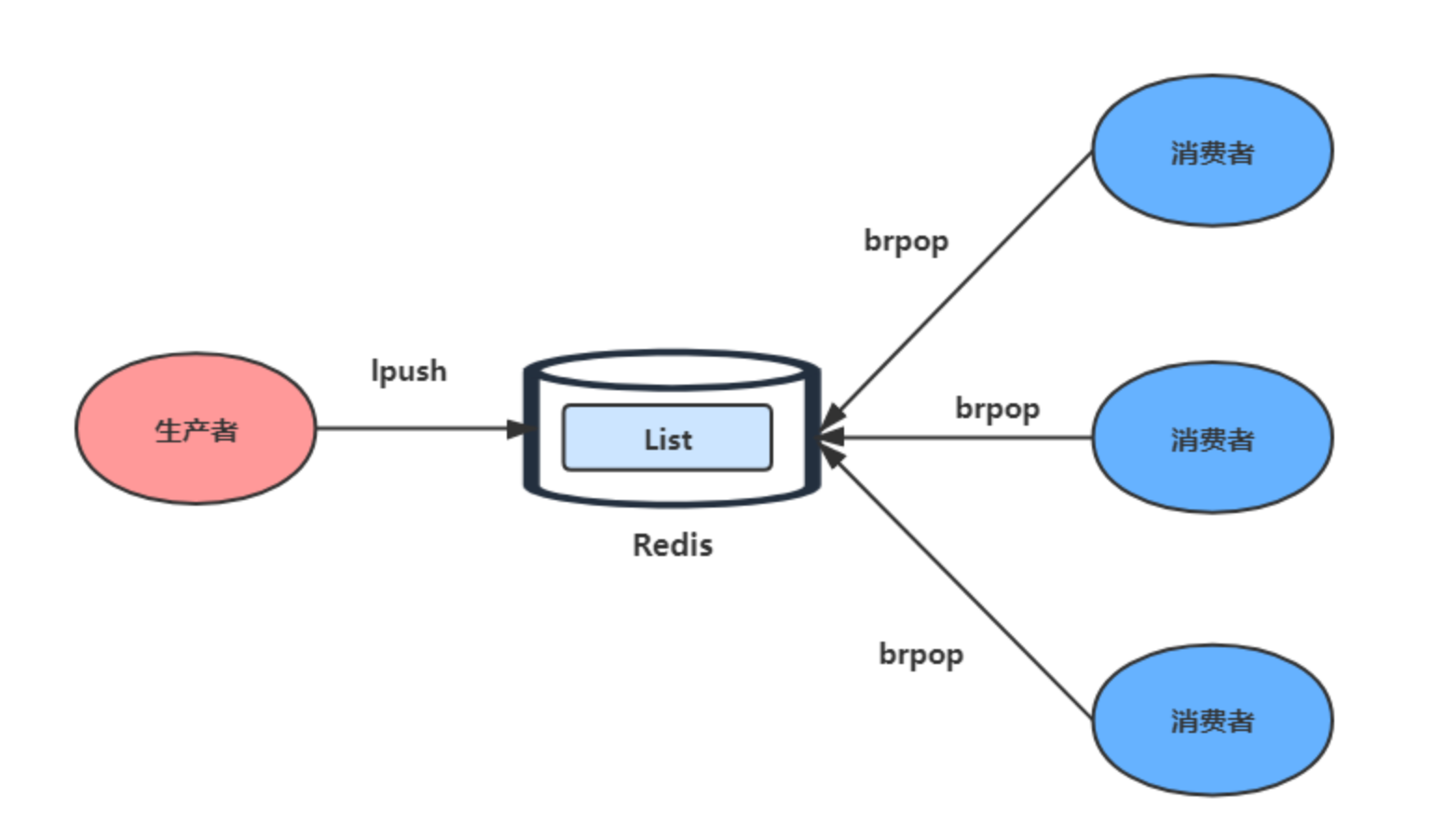

消息队列

消息队列在存取消息时,必须要满足三个需求,分别是 消息保序、处理重复的消息和保证消息可靠性 。

Redis 的 List 和 Stream 两种数据类型,就可以满足消息队列的这三个需求。我们先来了解下基于 List 的消息队列实现方法,后面在介绍 Stream 数据类型时候,在详细说说 Stream。

1、如何满足消息保序需求?

List 本身就是按先进先出的顺序对数据进行存取的,所以,如果使用 List 作为消息队列保存消息的话,就已经能满足消息保序的需求了。

List 可以使用 LPUSH + RPOP (或者反过来,RPUSH+LPOP)命令实现消息队列。

- 生产者使用

LPUSH key value[value...]将消息插入到队列的头部,如果 key 不存在则会创建一个空的队列再插入消息。 - 消费者使用

RPOP key依次读取队列的消息,先进先出。

不过,在消费者读取数据时,有一个潜在的性能风险点。

在生产者往 List 中写入数据时,List 并不会主动地通知消费者有新消息写入,如果消费者想要及时处理消息,就需要在程序中不停地调用 RPOP 命令(比如使用一个while(1)循环)。如果有新消息写入,RPOP命令就会返回结果,否则,RPOP命令返回空值,再继续循环。

所以,即使没有新消息写入List,消费者也要不停地调用 RPOP 命令,这就会导致消费者程序的 CPU 一直消耗在执行 RPOP 命令上,带来不必要的性能损失。

为了解决这个问题,Redis提供了 BRPOP 命令。 BRPOP命令也称为阻塞式读取,客户端在没有读到队列数据时,自动阻塞,直到有新的数据写入队列,再开始读取新数据 。和消费者程序自己不停地调用RPOP命令相比,这种方式能节省CPU开销。

2、如何处理重复的消息?

消费者要实现重复消息的判断,需要 2 个方面的要求:

- 每个消息都有一个全局的 ID。

- 消费者要记录已经处理过的消息的 ID。当收到一条消息后,消费者程序就可以对比收到的消息 ID 和记录的已处理过的消息 ID,来判断当前收到的消息有没有经过处理。如果已经处理过,那么,消费者程序就不再进行处理了。

但是 List 并不会为每个消息生成 ID 号,所以我们需要自行为每个消息生成一个全局唯一ID ,生成之后,我们在用 LPUSH 命令把消息插入 List 时,需要在消息中包含这个全局唯一 ID。

例如,我们执行以下命令,就把一条全局 ID 为 111000102、库存量为 99 的消息插入了消息队列:

> LPUSH mq "111000102:stock:99"

(integer) 1

3、如何保证消息可靠性?

当消费者程序从 List 中读取一条消息后,List 就不会再留存这条消息了。所以,如果消费者程序在处理消息的过程出现了故障或宕机,就会导致消息没有处理完成,那么,消费者程序再次启动后,就没法再次从 List 中读取消息了。

为了留存消息,List 类型提供了 BRPOPLPUSH 命令,这个命令的 作用是让消费者程序从一个 List 中读取消息,同时,Redis 会把这个消息再插入到另一个 List(可以叫作备份 List)留存 。

这样一来,如果消费者程序读了消息但没能正常处理,等它重启后,就可以从备份 List 中重新读取消息并进行处理了。

好了,到这里可以知道基于 List 类型的消息队列,满足消息队列的三大需求(消息保序、处理重复的消息和保证消息可靠性)。

- 消息保序:使用 LPUSH + RPOP;

- 阻塞读取:使用 BRPOP;

- 重复消息处理:生产者自行实现全局唯一 ID;

- 消息的可靠性:使用 BRPOPLPUSH

List 作为消息队列有什么缺陷?

List 不支持多个消费者消费同一条消息 ,因为一旦消费者拉取一条消息后,这条消息就从 List 中删除了,无法被其它消费者再次消费。

要实现一条消息可以被多个消费者消费,那么就要将多个消费者组成一个消费组,使得多个消费者可以消费同一条消息,但是 List 类型并不支持消费组的实现 。

这就要说起 Redis 从 5.0 版本开始提供的 Stream 数据类型了,Stream 同样能够满足消息队列的三大需求,而且它还支持「消费组」形式的消息读取。

阻塞队列

blpop key timeout(阻塞时间,如果是0则一直阻塞,除非有数据进入key,则会立即弹出)

实现简单阻塞队列:

hash

介绍

实际就是key-(key-value)类型的.应用场景:各种点赞、收藏、详情页。因为有自增和增加且是key-value。

内部实现

Hash 类型的底层数据结构是由压缩列表或哈希表实现的:

- 如果哈希类型元素个数小于

512个(默认值,可由hash-max-ziplist-entries配置),所有值小于64字节(默认值,可由hash-max-ziplist-value配置)的话,Redis 会使用压缩列表作为 Hash 类型的底层数据结构; - 如果哈希类型元素不满足上面条件,Redis 会使用哈希表作为 Hash 类型的 底层数据结构。

在 Redis 7.0 中,压缩列表数据结构已经废弃了,交由 listpack 数据结构来实现了 。

常用命令

Redis Hash 是一个string类型的field(字段)和value(值)的映射表,hash特别适合存储对象

# 1.将哈希表 key 中的字段 field 的值设为 value

hset key field value

# 2.同时将多个 field-value (域-值)对设置到哈希表 key 中

hmset key field1 value1 field2 value2 ...

# 3.获取存储在哈希表中指定字段的值

hget key field

# 4.获取所有给定字段的值

hget key field1 field2 ...

# 5.获取在哈希表中指定 key 的所有字段和值

hgetall key

# 6.获取所有哈希表中的字段

hkeys key

# 7.获取哈希表中所有值

hvals key

# 8.删除一个或多个哈希表字段

hdel key field1 field2 ....

# 9.获取哈希表中字段的数量

hlen key

# 10.查看哈希表 key 中,指定的字段是否存在

hexists key field

# 11.只有在字段 field 不存在时,设置哈希表字段的值

hsetnx key field value

# 12.为哈希表 key 中的指定字段的整数值加上增量 increment

hincrby key field increment

# 13.为哈希表 key 中的指定字段的浮点数值加上增量 increment

hincrbyfloat key field increment

# 14.迭代哈希表中的键值对

hscan key cursor [MATCH pattern] [COUNT count]

cursor - 游标。

pattern - 匹配的模式。

count - 指定从数据集里返回多少元素,默认值为 10 。

实例

127.0.0.1:6379> set k1::name 'hello world'

OK

127.0.0.1:6379> set k1::age 12

OK

127.0.0.1:6379> get k1

(nil)

127.0.0.1:6379> get k1::age

"12"

127.0.0.1:6379> keys k1*

1) "k1::name"

2) "k1::age"

127.0.0.1:6379> hset zhang name 12

(integer) 1

127.0.0.1:6379> hset zhang age 14

(integer) 1

127.0.0.1:6379> hget zhang name

"12"

127.0.0.1:6379> hmget zhang name age

1) "12"

2) "14"

127.0.0.1:6379> hgetall zhang

1) "name"

2) "12"

3) "age"

4) "14"

应用场景

1.缓存对象

Hash 类型的 (key,field, value) 的结构与对象的(对象id, 属性, 值)的结构相似,也可以用来存储对象。

在介绍 String 类型的应用场景时有所介绍,String + Json也是存储对象的一种方式,那么存储对象时,到底用 String + json 还是用 Hash 呢?

一般对象用 String + Json 存储,对象中某些频繁变化的属性可以考虑抽出来用 Hash 类型存储。

2.购物车

以用户 id 为 key,商品 id 为 field,商品数量为 value,恰好构成了购物车的3个要素,如下图所示。

涉及的命令如下:

- 添加商品:

HSET cart:{用户id} {商品id} 1 - 添加数量:

HINCRBY cart:{用户id} {商品id} 1 - 商品总数:

HLEN cart:{用户id} - 删除商品:

HDEL cart:{用户id} {商品id} - 获取购物车所有商品:

HGETALL cart:{用户id}

当前仅仅是将商品ID存储到了Redis 中,在回显商品具体信息的时候,还需要拿着商品 id 查询一次数据库,获取完整的商品的信息。

set

介绍

无序且不能有重复数据。

一个集合最多可以存储 2^32-1 个元素。概念和数学中个的集合基本类似,可以交集,并集,差集等等,所以 Set 类型除了支持集合内的增删改查,同时还支持多个集合取交集、并集、差集。

Set 类型和 List 类型的区别如下:

- List 可以存储重复元素,Set 只能存储非重复元素;

- List 是按照元素的先后顺序存储元素的,而 Set 则是无序方式存储元素的。

常用命令

# 1.向集合添加一个或多个成员,成员是无序的

sadd key value1 value2 ....

# 2.获取集合的成员数

scard key

# 3.返回集合中的所有成员

smembers key

# 4.随机移除并返回集合中的一个随机元素

spop key

# 5.判断 member 元素是否是集合 key 的成员

sismember key member

# 6.返回第一个集合与其他集合之间的差异

sdiff key1 key2 .....

# 7.返回给定所有集合的差集并存储在 destination 中

sdiffstore destination key1 key2....

# 8.返回给定所有集合的交集

sinter key1 key2 ...

# 9.返回给定所有集合的交集并存储在 destination 中

sinterstore destination key1 key2

# 10.将 member 元素从 source 集合移动到 destination 集合

smove source destination member

# 11.返回集合中一个或多个随机数,如果count为正数,不能超过总数量,如果为负数,则可以取出带重复的成员,并且满足count的数量

srandmember key [count]

# 12.移除集合中一个或多个成员

srem key member1 member2 ....

# 13.返回所有给定集合的并集

sunion key1 key2 ...

# 14.所有给定集合的并集存储在 destination 集合中

sunionstore destination key1 key2 ....oneNet

应用场景

集合的主要几个特性,无序、不可重复、支持并交差等操作。

因此 Set 类型比较适合用来数据去重和保障数据的唯一性,还可以用来统计多个集合的交集、错集和并集等,当我们存储的数据是无序并且需要去重的情况下,比较适合使用集合类型进行存储。

但是要提醒你一下,这里有一个潜在的风险。 Set 的差集、并集和交集的计算复杂度较高,在数据量较大的情况下,如果直接执行这些计算,会导致 Redis 实例阻塞 。

在主从集群中,为了避免主库因为 Set 做聚合计算(交集、差集、并集)时导致主库被阻塞,我们可以选择一个从库完成聚合统计,或者把数据返回给客户端,由客户端来完成聚合统计。

1.点赞

Set 类型可以保证一个用户只能点一个赞,这里举例子一个场景,key 是文章id,value 是用户id。

uid:1 、uid:2、uid:3 三个用户分别对 article:1 文章点赞了。

uid:1 用户对文章 article:1 点赞

SADD article:1 uid:1

(integer) 1

uid:2 用户对文章 article:1 点赞

SADD article:1 uid:2

(integer) 1

uid:3 用户对文章 article:1 点赞

SADD article:1 uid:3

(integer) 1

uid:1 取消了对 article:1 文章点赞。

SREM article:1 uid:1

(integer) 1

获取 article:1 文章所有点赞用户 :

> SMEMBERS article:1 1) "uid:3" 2) "uid:2"

获取 article:1 文章的点赞用户数量:

SCARD article:1

(integer) 2

判断用户 uid:1 是否对文章 article:1 点赞了:

SISMEMBER article:1 uid:1

(integer) 0 # 返回0说明没点赞,返回1则说明点赞了

2.共同关注

Set 类型支持交集运算,所以可以用来计算共同关注的好友、公众号等。

key 可以是用户id,value 则是已关注的公众号的id。

uid:1 用户关注公众号 id 为 5、6、7、8、9,uid:2 用户关注公众号 id 为 7、8、9、10、11。

# uid:1 用户关注公众号 id 为 5、6、7、8、9 > SADD uid:1 5 6 7 8 9 (integer) 5 # uid:2 用户关注公众号 id 为 7、8、9、10、11 > SADD uid:2 7 8 9 10 11 (integer) 5

uid:1 和 uid:2 共同关注的公众号:

# 获取共同关注 > SINTER uid:1 uid:2 1) "7" 2) "8" 3) "9"

给 uid:2 推荐 uid:1 关注的公众号:

> SDIFF uid:1 uid:2 1) "5" 2) "6"

验证某个公众号是否同时被 uid:1 或 uid:2 关注:

> SISMEMBER uid:1 5

(integer) 1 # 返回0,说明关注了

> SISMEMBER uid:2 5

(integer) 0 # 返回0,说明没关注

3.抽奖活动

存储某活动中中奖的用户名 ,Set 类型因为有去重功能,可以保证同一个用户不会中奖两次。

key为抽奖活动名,value为员工名称,把所有员工名称放入抽奖箱 :

>SADD lucky Tom Jerry John Sean Marry Lindy Sary Mark

(integer) 5

如果允许重复中奖,可以使用 SRANDMEMBER 命令。

# 抽取 1 个一等奖:

> SRANDMEMBER lucky 1

1) "Tom"

# 抽取 2 个二等奖:

> SRANDMEMBER lucky 2

1) "Mark"

2) "Jerry"

# 抽取 3 个三等奖:

> SRANDMEMBER lucky 3

1) "Sary"

2) "Tom"

3) "Jerry"

如果不允许重复中奖,可以使用 SPOP 命令。

# 抽取一等奖1个

> SPOP lucky 1

1) "Sary"

# 抽取二等奖2个

> SPOP lucky 2

1) "Jerry"

2) "Mark"

# 抽取三等奖3个

> SPOP lucky 3

1) "John"

2) "Sean"

3) "Lindy"

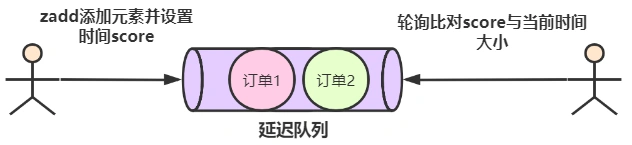

sorted set || Zset

介绍

Zset 类型(有序集合类型)相比于 Set 类型多了一个排序属性 score(分值),对于有序集合 ZSet 来说,每个存储元素相当于有两个值组成的,一个是有序结合的元素值,一个是排序值。

有序集合保留了集合不能有重复成员的特性(分值可以重复),但不同的是,有序集合中的元素可以排序。

内部实现

Zset 类型的底层数据结构是由压缩列表或跳表实现的:

- 如果有序集合的元素个数小于

128个,并且每个元素的值小于64字节时,Redis 会使用压缩列表作为 Zset 类型的底层数据结构; - 如果有序集合的元素不满足上面的条件,Redis 会使用跳表作为 Zset 类型的底层数据结构;

在 Redis 7.0 中,压缩列表数据结构已经废弃了,交由 listpack 数据结构来实现了。

常用命令

Zset 运算操作(相比于 Set 类型,ZSet 类型没有支持差集运算,只有并集和交集):

有序集合,需要有排序的维度(分值)

物理内存是左小右大顺序存储

# 1.向有序集合添加一个或多个成员,或者更新已存在成员的分数

zadd key score1 member1 score2 member2 ...

# 2.获取有序集合的成员数

zcard key

# 3.计算在有序集合中指定区间分数的成员数

zcount min max (正无穷是+inf 负无穷是-inf)

# 4.通过索引区间返回有序集合指定区间内的成员

zrange key start stop [withscores] (zrange key 0 -1 代表的是返回全部成员)

# 5.通过分数返回有序集合指定区间内的成员,withscores是否带上分数,(这里的min和max是指大于等于)

zrangebyscore key min max [withscores] [limit]

zrangebyscore key 6 9 # 大于等于6,小于等于9

zrangebyscore key (6 (9 # 大于6,小于9

zrangebyscore key -inf +inf # 大于等于负无穷,小于等于正无穷

zrangebyscore key -inf +inf withscores # 带上每个成员的分数

# 6.在有序集合中计算指定字典区间内成员数量

zlexcount key member1 member2

# 7.通过字典区间返回有序集合的成员

zrangebylex key member1 member2

# 8.返回有序集合中指定成员的索引

zrank key member

# 9.移除有序集合中的一个或多个成员

zrem key member1 member2 ...

# 10.移除有序集合中给定的字典区间的所有成员

zremrangebylex key minMember maxMember

# 11.移除有序集合中给定的排名区间(索引)的所有成员

zremrangebyrank key start stop

# 12.移除有序集合中给定的分数区间的所有成员

zremrangebyscore key minScore maxScore

# 13.返回有序集中指定区间内的成员,通过索引,分数从高到低,即倒叙排序

zrevrange key start stop [withscores]

# 14.返回有序集中指定分数区间内的成员,分数从高到低排序

zrevrangebyscore key maxscores minscores [withscores]

# 15.返回有序集合中指定成员的排名,有序集成员按分数值递减(从大到小)排序

zrevrank key member (就是返回成员逆序排序后的排名)

# 16.返回有序集中,成员的分数值

zscore key member

# 17.有序集合中对指定成员的分数加上增量 increment

zincrby key increment member

# 18.计算给定的一个或多个有序集的交集并将结果集存储在新的有序集合 destination 中

zinterstore destination numkeys key1 key2 .... # numkeys是指key的个数,后面就必须接上这个数量的key

# 19.计算给定的一个或多个有序集的并集,并存储在新的 key 中

zunionstore destination numkeys key1 [key2 ...]

# 20.迭代有序集合中的元素(包括元素成员和元素分值)

zscan key cursor [MATCH pattern] [COUNT count]

实例

127.0.0.1:6379> zadd k 1 zhang 2 li 4 san # 存储

(integer) 3

127.0.0.1:6379> zcount k 1 2 # 统计分数在1到2之间的个数

(integer) 2

127.0.0.1:6379> zcard k # 展示一共有多少个数据

(integer) 3

127.0.0.1:6379> zrange k 0 -1 # 显示所有数据

1) "zhang"

2) "li"

3) "san"

127.0.0.1:6379> zrevrange k 0 -1 # 逆序显示所有数据

1) "san"

2) "li"

3) "zhang"

127.0.0.1:6379> zrange k 0 -1 withscores # 显示分数和所有的数据

1) "zhang"

2) "1"

3) "li"

4) "2"

5) "san"

6) "4"

# 查询并集

127.0.0.1:6379> zadd k 1 ping 2 xiang 3 li 4 orange

(integer) 4

127.0.0.1:6379> zadd k1 1 ping 2 xiang 3 boluo 4 liulian

(integer) 4

127.0.0.1:6379> zrange k 0 -1 withscores

1) "ping"

2) "1"

3) "xiang"

4) "2"

5) "li"

6) "3"

7) "orange"

8) "4"

127.0.0.1:6379> zrange k1 0 -1 withscores

1) "ping"

2) "1"

3) "xiang"

4) "2"

5) "boluo"

6) "3"

7) "liulian"

8) "4"

127.0.0.1:6379> zunionstore k2 2 k k1

(integer) 6

127.0.0.1:6379> zrange k2 0 -1 withscores # 并集相同的key的score会相加,然后在新集合中重新排序

1) "ping"

2) "2"

3) "boluo"

4) "3"

5) "li"

6) "3"

7) "liulian"

8) "4"

9) "orange"

10) "4"

11) "xiang"

12) "4"

sorted set排序是怎么实现的?

跳跃表:skip list set是链表 最底下一层是所有数据,倒数第二层是间接挑选底层数据复制。随机造层,平衡树

应用场景

Zset 类型(Sorted Set,有序集合) 可以根据元素的权重来排序,我们可以自己来决定每个元素的权重值。比如说,我们可以根据元素插入 Sorted Set 的时间确定权重值,先插入的元素权重小,后插入的元素权重大。

在面对需要展示最新列表、排行榜等场景时,如果数据更新频繁或者需要分页显示,可以优先考虑使用 Sorted Set。

1.排行榜

有序集合比较典型的使用场景就是排行榜。例如学生成绩的排名榜、游戏积分排行榜、视频播放排名、电商系统中商品的销量排名等。

我们以博文点赞排名为例,小林发表了五篇博文,分别获得赞为 200、40、100、50、150。

# arcticle:1 文章获得了200个赞

> ZADD user:xiaolin:ranking 200 arcticle:1

(integer) 1

# arcticle:2 文章获得了40个赞

> ZADD user:xiaolin:ranking 40 arcticle:2

(integer) 1

# arcticle:3 文章获得了100个赞

> ZADD user:xiaolin:ranking 100 arcticle:3

(integer) 1

# arcticle:4 文章获得了50个赞

> ZADD user:xiaolin:ranking 50 arcticle:4

(integer) 1

# arcticle:5 文章获得了150个赞

> ZADD user:xiaolin:ranking 150 arcticle:5

(integer) 1

文章 arcticle:4 新增一个赞,可以使用 ZINCRBY 命令(为有序集合key中元素member的分值加上increment):

> ZINCRBY user:xiaolin:ranking 1 arcticle:4

"51"

查看某篇文章的赞数,可以使用 ZSCORE 命令(返回有序集合key中元素个数):

> ZSCORE user:xiaolin:ranking arcticle:4

"50"

获取小林文章赞数最多的 3 篇文章,可以使用 ZREVRANGE 命令(倒序获取有序集合 key 从start下标到stop下标的元素):

# WITHSCORES 表示把 score 也显示出来

> ZREVRANGE user:xiaolin:ranking 0 2 WITHSCORES

1) "arcticle:1"

2) "200"

3) "arcticle:5"

4) "150"

5) "arcticle:3"

6) "100"

获取小林 100 赞到 200 赞的文章,可以使用 ZRANGEBYSCORE 命令(返回有序集合中指定分数区间内的成员,分数由低到高排序):

> ZRANGEBYSCORE user:xiaolin:ranking 100 200 WITHSCORES

1) "arcticle:3"

2) "100"

3) "arcticle:5"

4) "150"

5) "arcticle:1"

6) "200"

2.电话、姓名排序

使用有序集合的 ZRANGEBYLEX 或 ZREVRANGEBYLEX 可以帮助我们实现电话号码或姓名的排序,我们以 ZRANGEBYLEX (返回指定成员区间内的成员,按 key 正序排列,分数必须相同)为例。

注意:不要在分数不一致的 SortSet 集合中去使用 ZRANGEBYLEX和 ZREVRANGEBYLEX 指令,因为获取的结果会不准确。

1、电话排序

我们可以将电话号码存储到 SortSet 中,然后根据需要来获取号段:

> ZADD phone 0 13100111100 0 13110114300 0 13132110901

(integer) 3

> ZADD phone 0 13200111100 0 13210414300 0 13252110901

(integer) 3

> ZADD phone 0 13300111100 0 13310414300 0 13352110901

(integer) 3

获取所有号码:

> ZRANGEBYLEX phone - +

1) "13100111100"

2) "13110114300"

3) "13132110901"

4) "13200111100"

5) "13210414300"

6) "13252110901"

7) "13300111100"

8) "13310414300"

9) "13352110901"

获取 132 号段的号码:

> ZRANGEBYLEX phone [132 (133

1) "13200111100"

2) "13210414300"

3) "13252110901"

获取132、133号段的号码:

> ZRANGEBYLEX phone [132 (134

1) "13200111100"

2) "13210414300"

3) "13252110901"

4) "13300111100"

5) "13310414300"

6) "13352110901"

2、姓名排序

> zadd names 0 Toumas 0 Jake 0 Bluetuo 0 Gaodeng 0 Aimini 0 Aidehua

(integer) 6

获取所有人的名字:

> ZRANGEBYLEX names - +

1) "Aidehua"

2) "Aimini"

3) "Bluetuo"

4) "Gaodeng"

5) "Jake"

6) "Toumas"

获取名字中大写字母A开头的所有人:

> ZRANGEBYLEX names [A (B

1) "Aidehua"

2) "Aimini"

获取名字中大写字母 C 到 Z 的所有人:

> ZRANGEBYLEX names [C [Z

1) "Gaodeng"

2) "Jake"

3) "Toumas"

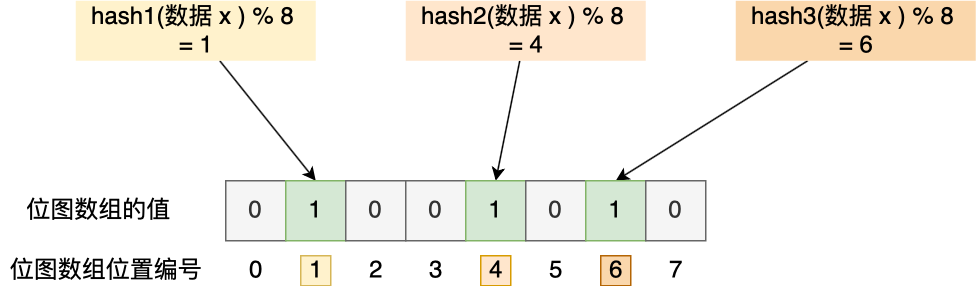

bitmap

介绍

Bitmap,即位图,是一串连续的二进制数组(0和1),可以通过偏移量(offset)定位元素。BitMap通过最小的单位bit来进行 0|1的设置,表示某个元素的值或者状态,时间复杂度为O(1)。

由于 bit 是计算机中最小的单位,使用它进行储存将非常节省空间,特别适合一些数据量大且使用 二值统计的场景 。

内部实现

Bitmap 本身是用 String 类型作为底层数据结构实现的一种统计二值状态的数据类型。

String 类型是会保存为二进制的字节数组,所以,Redis 就把字节数组的每个 bit 位利用起来,用来表示一个元素的二值状态,你可以把 Bitmap 看作是一个 bit 数组。

常用命令

基本操作

# 设置值,其中value只能是 0 和 1

SETBIT key offset value

# 获取值

GETBIT key offset

# 获取指定范围内值为 1 的个数

# start 和 end 以字节为单位

BITCOUNT key start end

运算操作

# BitMap间的运算

# operations 位移操作符,枚举值

AND 与运算 &

OR 或运算 |

XOR 异或 ^

NOT 取反 ~

# result 计算的结果,会存储在该key中

# key1 … keyn 参与运算的key,可以有多个,空格分割,not运算只能一个key

# 当 BITOP 处理不同长度的字符串时,较短的那个字符串所缺少的部分会被看作 0。返回值是保存到 destkey 的字符串的长度(以字节byte为单位),和输入 key 中最长的字符串长度相等。

BITOP [operations] [result] [key1] [keyn…]

# 返回指定key中第一次出现指定value(0/1)的位置

BITPOS [key] [value]

整合测试

# 其实也是属于string的

127.0.0.1:6379> help setbit

SETBIT key offset value

summary: Sets or clears the bit at offset in the string value stored at key

since: 2.2.0

group: string

# 案例1

127.0.0.1:6379> setbit k1 1 1 # 偏移量是1 ,也就是从左往右偏移一位0100 0000

(integer) 0

127.0.0.1:6379> object encoding k1

"raw"

127.0.0.1:6379> strlen k1

(integer) 1

127.0.0.1:6379> get k1

"@"

# 案例2

127.0.0.1:6379> setbit k2 0 1

(integer) 0

127.0.0.1:6379> get k2 # 偏移量是0,也就是1000 0000

"\x80"

# 案例3 strlen,统计bitmap的长度是按字节来

127.0.0.1:6379> get k1 # 这里是0100 0000

"@"

127.0.0.1:6379> setbit k1 7 1

(integer) 0

127.0.0.1:6379> get k1 # 到这里是0100 0001 ,也就是1+2^6=65,到ASCII码是A

"A"

127.0.0.1:6379> strlen k1 # 没超过8位,所以还是一位

(integer) 1

# 案例3

127.0.0.1:6379> setbit k1 9 1

(integer) 0

127.0.0.1:6379> strlen k1 # 到这里长度为2,因为是0100 0001 0100 0000,其中0100 0001是A,0100 0000是@

(integer) 2

127.0.0.1:6379> get k1

"A@"

# 案例4

127.0.0.1:6379> help bitpos # 查找指定bit出现的位置,以字节(也就是8位bit)为单位

BITPOS key bit [start] [end] # start和end是表示字节数,从第start个字节到第end个字节,从0开始计数

summary: Find first bit set or clear in a string

since: 2.8.7

group: string

127.0.0.1:6379> get k1 # 0000 0001

"\x01"

127.0.0.1:6379> bitpos k1 1 0 0 # 查找第1个字节中(因为start和end都是0,也就是第一个字节)第一次出现在整个bitmap二进制位的位置,是在第7位(从0开始)

(integer) 7

# 案例5,查找指定字节中出现的1的次数

127.0.0.1:6379> help bitcount

BITCOUNT key [start end]

summary: Count set bits in a string

since: 2.6.0

group: string

127.0.0.1:6379> get k1 # 01000001 01000000

"A@"

127.0.0.1:6379> bitcount k1 0 1 # 在第一个字节到第二个字节中,1出现了3次

(integer) 3

# 案例6,比较运算,and or not(非运算只能有一个key) xor(异或)

127.0.0.1:6379> help bitop

BITOP operation destkey key [key ...]

summary: Perform bitwise operations between strings

since: 2.6.0

group: string

127.0.0.1:6379> get k1 # 0100 0001

"A"

127.0.0.1:6379> get k2 # 0100 0010

"B"

127.0.0.1:6379> bitop and k3 k1 k2 # 将k1和k2作与操作,并将结果存放到k3中,与操作是同时为1才为1,否则为0,所以最后得出的结果是0100 0000

(integer) 1

127.0.0.1:6379> get k3 # k3的结果是0100 0000

"@"

127.0.0.1:6379> bitop or k4 k1 k2 # 进行或操作

(integer) 1

127.0.0.1:6379> get k4 # 0100 0011

"C"

127.0.0.1:6379> bitop not k5 k1 #进行非操作 0100 0001----> 1011 1110

(integer) 1

127.0.0.1:6379> get k5 #1011 1110--->b e

"\xbe"

127.0.0.1:6379> bitop xor k6 k1 k2 # 异或操作 0100 0001 和0100 0010---->0000 0011

(integer) 1

127.0.0.1:6379> get k6

"\x03"

setbit、bitcount、bitop、bitpos

ASCII码

[root@VM-4-2-centos ~]# man ascii

ASCII(7) Linux Programmer's Manual ASCII(7)

NAME

ascii - 在八进制,十进制,十六进制中的 ASCII 字符集编码

描述

ASCII 是美国对于信息交换的标准代码,它是7位码,许多8位码(比如 ISO 8859-1, Linux 的默认字符集)容纳 ASCII 作为它们的下半部分。对应的国际 ASSII 是 ISO 646。

下列的表格包含这 128 ASCII 字符.

注意 C 程序 '\X' 扩展(转义).

Oct Dec Hex Char Oct Dec Hex Char

──────────────────────────────────────────────────────────────────

000 0 00 NUL '\0' 100 64 40 @

001 1 01 SOH 101 65 41 A

002 2 02 STX 102 66 42 B

003 3 03 ETX 103 67 43 C

004 4 04 EOT 104 68 44 D

005 5 05 ENQ 105 69 45 E

006 6 06 ACK 106 70 46 F

007 7 07 BEL '\a' 107 71 47 G

010 8 08 BS '\b' 110 72 48 H

011 9 09 HT '\t' 111 73 49 I

012 10 0A LF '\n' 112 74 4A J

应用场景

1.统计用户登录天数,且窗口随机

极端情况下,一个字节是统计一天的打卡,如果这天打开了,设置为0000 0001,这样窗口随机获取的时候就是按字节来bitcount就可以了,一个人一年最大是365字节

一亿个人10年打卡的记录就是365G

127.0.0.1:6379> setbit zhang 7 1 # 设置第一天打卡

(integer) 0

127.0.0.1:6379> setbit zhang 15 1 # 设置第二天打卡

(integer) 0

127.0.0.1:6379> setbit zhang 2911 1 # 设置第364天打卡

(integer) 0

127.0.0.1:6379> setbit zhang 2919 1 # 设置第365天打卡

(integer) 0

127.0.0.1:6379> strlen zhang # 365字节

(integer) 365

127.0.0.1:6379> get zhang

"\x01\x01\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x00\x01\x01"

127.0.0.1:6379> bitcount zhang -2 -1 # 统计一年最后两天打卡几次

(integer) 2

127.0.0.1:6379> getrange zhang -2 -1 # 获取最后两天的打卡情况

"\x01\x01"

如果不需要统计次数,实际上可以一天是1个bit,这样一个人一年才365bit,也就是45.7字节,取整是46字节

2.送礼物时,库存备货多少,假设有2亿用户

用户有僵尸用户、冷热用户/忠诚用户(活跃用户)。所以主要是统计活跃用户统计

这时候天数是key, 每个人映射bit的第几位,如果当天登录就设置为1,使用bitop的or运算,统计连续几天登录的人的个数

127.0.0.1:6379> setbit 20220619 1 1

(integer) 0

127.0.0.1:6379> setbit 20220619 3 1

(integer) 0

127.0.0.1:6379> setbit 20220619 7 1

(integer) 0

127.0.0.1:6379> setbit 20220620 1 1

(integer) 0

127.0.0.1:6379> setbit 20220620 2 1

(integer) 0

127.0.0.1:6379> bitop or destkey 20220619 20220620

(integer) 1

127.0.0.1:6379> get destkey

"q"

127.0.0.1:6379> bitcount destkey # 两天一共有4个人登录,去除掉重复登录的人的个数

(integer) 4

3.判断用户登录状态

Bitmap 提供了 GETBIT、SETBIT 操作,通过一个偏移值 offset 对 bit 数组的 offset 位置的 bit 位进行读写操作,需要注意的是 offset 从 0 开始。

只需要一个 key = login_status 表示存储用户登陆状态集合数据, 将用户 ID 作为 offset,在线就设置为 1,下线设置 0。通过 GETBIT判断对应的用户是否在线。 50000 万 用户只需要 6 MB 的空间。

假如我们要判断 ID = 10086 的用户的登陆情况:

第一步,执行以下指令,表示用户已登录。

SETBIT login_status 10086 1

第二步,检查该用户是否登陆,返回值 1 表示已登录。

GETBIT login_status 10086

第三步,登出,将 offset 对应的 value 设置成 0。

SETBIT login_status 10086 0

4.连续签到用户总数

如何统计出这连续 7 天连续打卡用户总数呢?

我们把每天的日期作为 Bitmap 的 key,userId 作为 offset,若是打卡则将 offset 位置的 bit 设置成 1。

key 对应的集合的每个 bit 位的数据则是一个用户在该日期的打卡记录。

一共有 7 个这样的 Bitmap,如果我们能对这 7 个 Bitmap 的对应的 bit 位做 『与』运算。同样的 UserID offset 都是一样的,当一个 userID 在 7 个 Bitmap 对应对应的 offset 位置的 bit = 1 就说明该用户 7 天连续打卡。

结果保存到一个新 Bitmap 中,我们再通过 BITCOUNT 统计 bit = 1 的个数便得到了连续打卡 3 天的用户总数了。

Redis 提供了 BITOP operation destkey key [key ...]这个指令用于对一个或者多个 key 的 Bitmap 进行位元操作。

opration可以是and、OR、NOT、XOR。当 BITOP 处理不同长度的字符串时,较短的那个字符串所缺少的部分会被看作0。空的key也被看作是包含0的字符串序列。

举个例子,比如将三个 bitmap 进行 AND 操作,并将结果保存到 destmap 中,接着对 destmap 执行 BITCOUNT 统计。

# 与操作

BITOP AND destmap bitmap:01 bitmap:02 bitmap:03

# 统计 bit 位 = 1 的个数

BITCOUNT destmap

即使一天产生一个亿的数据,Bitmap 占用的内存也不大,大约占 12 MB 的内存(10^8/8/1024/1024),7 天的 Bitmap 的内存开销约为 84 MB。同时我们最好给 Bitmap 设置过期时间,让 Redis 删除过期的打卡数据,节省内存。

HyperLogLog

介绍

Redis HyperLogLog 是 Redis 2.8.9 版本新增的数据类型,是一种用于「统计基数」的数据集合类型,基数统计就是指统计一个集合中不重复的元素个数。但要注意,HyperLogLog 是统计规则是基于概率完成的,不是非常准确,标准误算率是 0.81%。

所以,简单来说 HyperLogLog 提供不精确的去重计数 。

HyperLogLog 的优点是,在输入元素的数量或者体积非常非常大时,计算基数所需的内存空间总是固定的、并且是很小的。

在 Redis 里面, 每个 HyperLogLog 键只需要花费 12 KB 内存,就可以计算接近 2^64 个不同元素的基数 ,和元素越多就越耗费内存的 Set 和 Hash 类型相比,HyperLogLog 就非常节省空间。

这什么概念?举个例子给大家对比一下。

用 Java 语言来说,一般 long 类型占用 8 字节,而 1 字节有 8 位,即:1 byte = 8 bit,即 long 数据类型最大可以表示的数是:2^63-1。对应上面的 2^64个数,假设此时有 2^63-1这么多个数,从 0 ~ 2^63-1,按照 long以及 1k = 1024 字节的规则来计算内存总数,就是:((2^63-1) * 8/1024)K,这是很庞大的一个数,存储空间远远超过 12K,而 HyperLogLog 却可以用 12K 就能统计完。

内部实现

涉及到很多数学运算

https://en.wikipedia.org/wiki/HyperLogLog

常用命令

HyperLogLog 命令很少,就三个。

# 添加指定元素到 HyperLogLog 中

PFADD key element [element ...]

# 返回给定 HyperLogLog 的基数估算值。

PFCOUNT key [key ...]

# 将多个 HyperLogLog 合并为一个 HyperLogLog

PFMERGE destkey sourcekey [sourcekey ...]

应用场景

百万级网页 UV 计数

Redis HyperLogLog 优势在于只需要花费 12 KB 内存,就可以计算接近 2^64 个元素的基数,和元素越多就越耗费内存的 Set 和 Hash 类型相比,HyperLogLog 就非常节省空间。

所以,非常适合统计百万级以上的网页 UV 的场景。

在统计 UV 时,你可以用 PFADD 命令(用于向 HyperLogLog 中添加新元素)把访问页面的每个用户都添加到 HyperLogLog 中。

PFADD page1:uv user1 user2 user3 user4 user5

接下来,就可以用 PFCOUNT 命令直接获得 page1 的 UV 值了,这个命令的作用就是返回 HyperLogLog 的统计结果。

PFCOUNT page1:uv

不过,有一点需要你注意一下,HyperLogLog 的统计规则是基于概率完成的,所以它给出的统计结果是有一定误差的,标准误算率是 0.81%。

这也就意味着,你使用 HyperLogLog 统计的 UV 是 100 万,但实际的 UV 可能是 101 万。虽然误差率不算大,但是,如果你需要精确统计结果的话,最好还是继续用 Set 或 Hash 类型。

GEO

介绍

Redis GEO 是 Redis 3.2 版本新增的数据类型,主要用于存储地理位置信息,并对存储的信息进行操作。

在日常生活中,我们越来越依赖搜索“附近的餐馆”、在打车软件上叫车,这些都离不开基于位置信息服务(Location-Based Service,LBS)的应用。LBS 应用访问的数据是和人或物关联的一组经纬度信息,而且要能查询相邻的经纬度范围,GEO 就非常适合应用在 LBS 服务的场景中。

内部实现

GEO 本身并没有设计新的底层数据结构,而是直接使用了 Sorted Set 集合类型。

GEO 类型使用 GeoHash 编码方法实现了经纬度到 Sorted Set 中元素权重分数的转换,这其中的两个关键机制就是「对二维地图做区间划分」和「对区间进行编码」。一组经纬度落在某个区间后,就用区间的编码值来表示,并把编码值作为 Sorted Set 元素的权重分数。

这样一来,我们就可以把经纬度保存到 Sorted Set 中,利用 Sorted Set 提供的“按权重进行有序范围查找”的特性,实现 LBS 服务中频繁使用的“搜索附近”的需求。

常用命令

# 存储指定的地理空间位置,可以将一个或多个经度(longitude)、纬度(latitude)、位置名称(member)添加到指定的 key 中。

GEOADD key longitude latitude member [longitude latitude member ...]

# 从给定的 key 里返回所有指定名称(member)的位置(经度和纬度),不存在的返回 nil。

GEOPOS key member [member ...]

# 返回两个给定位置之间的距离。

GEODIST key member1 member2 [m|km|ft|mi]

# 根据用户给定的经纬度坐标来获取指定范围内的地理位置集合。

GEORADIUS key longitude latitude radius m|km|ft|mi [WITHCOORD] [WITHDIST] [WITHHASH] [COUNT count] [ASC|DESC] [STORE key] [STOREDIST key]

应用场景

滴滴叫车

这里以滴滴叫车的场景为例,介绍下具体如何使用 GEO 命令:GEOADD 和 GEORADIUS 这两个命令。

假设车辆 ID 是 33,经纬度位置是(116.034579,39.030452),我们可以用一个 GEO 集合保存所有车辆的经纬度,集合 key 是 cars:locations。

执行下面的这个命令,就可以把 ID 号为 33 的车辆的当前经纬度位置存入 GEO 集合中:

GEOADD cars:locations 116.034579 39.030452 33

当用户想要寻找自己附近的网约车时,LBS 应用就可以使用 GEORADIUS 命令。

例如,LBS 应用执行下面的命令时,Redis 会根据输入的用户的经纬度信息(116.054579,39.030452 ),查找以这个经纬度为中心的 5 公里内的车辆信息,并返回给 LBS 应用。

GEORADIUS cars:locations 116.054579 39.030452 5 km ASC COUNT 10

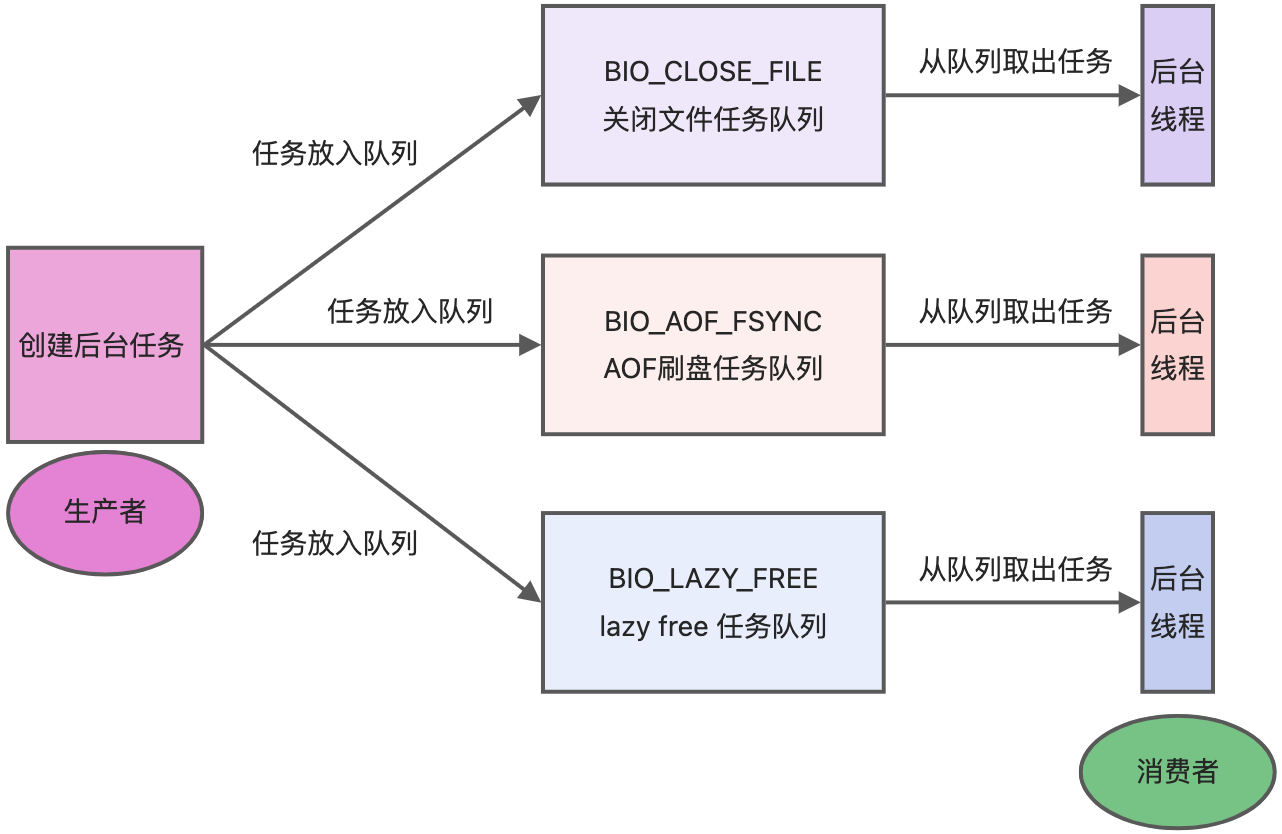

Stream

介绍

Redis Stream 是 Redis 5.0 版本新增加的数据类型,Redis 专门为消息队列设计的数据类型。

在 Redis 5.0 Stream 没出来之前,消息队列的实现方式都有着各自的缺陷,例如:

- 发布订阅模式,不能持久化也就无法可靠的保存消息,并且对于离线重连的客户端不能读取历史消息的缺陷;

- List 实现消息队列的方式不能重复消费,一个消息消费完就会被删除,而且生产者需要自行实现全局唯一 ID。

基于以上问题,Redis 5.0 便推出了 Stream 类型也是此版本最重要的功能,用于完美地实现消息队列,它支持消息的持久化、支持自动生成全局唯一 ID、支持 ack 确认消息的模式、支持消费组模式等,让消息队列更加的稳定和可靠

常用命令

Stream 消息队列操作命令:

- XADD:插入消息,保证有序,可以自动生成全局唯一 ID;

- XLEN :查询消息长度;

- XREAD:用于读取消息,可以按 ID 读取数据;

- XDEL : 根据消息 ID 删除消息;

- DEL :删除整个 Stream;

- XRANGE :读取区间消息

- XREADGROUP:按消费组形式读取消息;

- XPENDING 和 XACK:

- XPENDING 命令可以用来查询每个消费组内所有消费者「已读取、但尚未确认」的消息;

- XACK 命令用于向消息队列确认消息处理已完成;

应用场景

1.消息队列

生产者通过 XADD 命令插入一条消息:

# * 表示让 Redis 为插入的数据自动生成一个全局唯一的 ID

# 往名称为 mymq 的消息队列中插入一条消息,消息的键是 name,值是 xiaolin

> XADD mymq * name xiaolin

"1654254953808-0"

插入成功后会返回全局唯一的 ID:“1654254953808-0”。消息的全局唯一 ID 由两部分组成:

- 第一部分“1654254953808”是数据插入时,以毫秒为单位计算的当前服务器时间;

- 第二部分表示插入消息在当前毫秒内的消息序号,这是从 0 开始编号的。例如,“1654254953808-0”就表示在“1654254953808”毫秒内的第 1 条消息。

消费者通过 XREAD 命令从消息队列中读取消息时,可以指定一个消息 ID,并从这个消息 ID 的下一条消息开始进行读取(注意是输入消息 ID 的下一条信息开始读取,不是查询输入ID的消息)。

# 从 ID 号为 1654254953807-0 的消息开始,读取后续的所有消息(示例中一共 1 条)。

> XREAD STREAMS mymq 1654254953807-0

1) 1) "mymq"

2) 1) 1) "1654254953808-0"

2) 1) "name"

2) "xiaolin"

如果 想要实现阻塞读(当没有数据时,阻塞住),可以调用 XRAED 时设定 BLOCK 配置项 ,实现类似于 BRPOP 的阻塞读取操作。

比如,下面这命令,设置了 BLOCK 10000 的配置项,10000 的单位是毫秒,表明 XREAD 在读取最新消息时,如果没有消息到来,XREAD 将阻塞 10000 毫秒(即 10 秒),然后再返回。

# 命令最后的“$”符号表示读取最新的消息

> XREAD BLOCK 10000 STREAMS mymq $

(nil)

(10.00s)

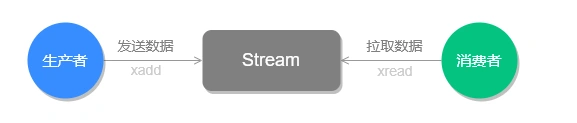

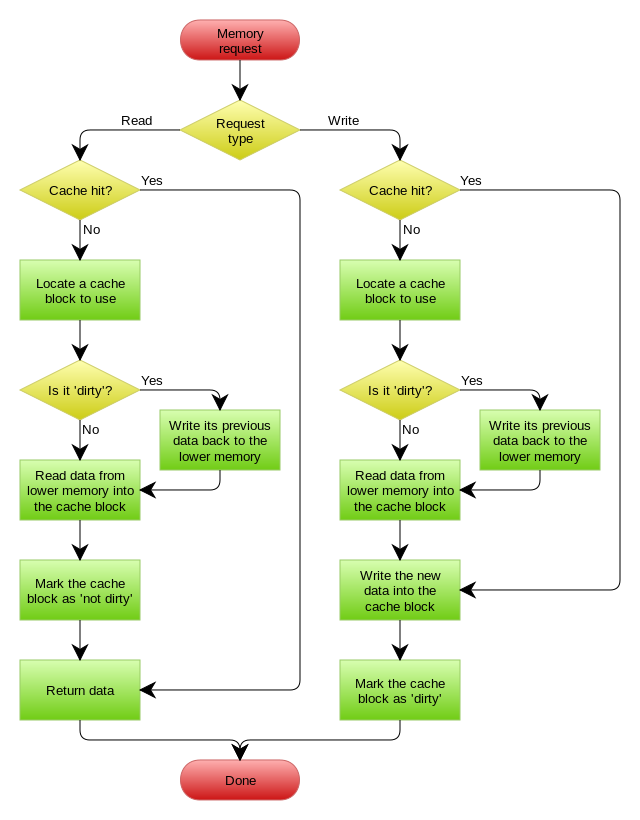

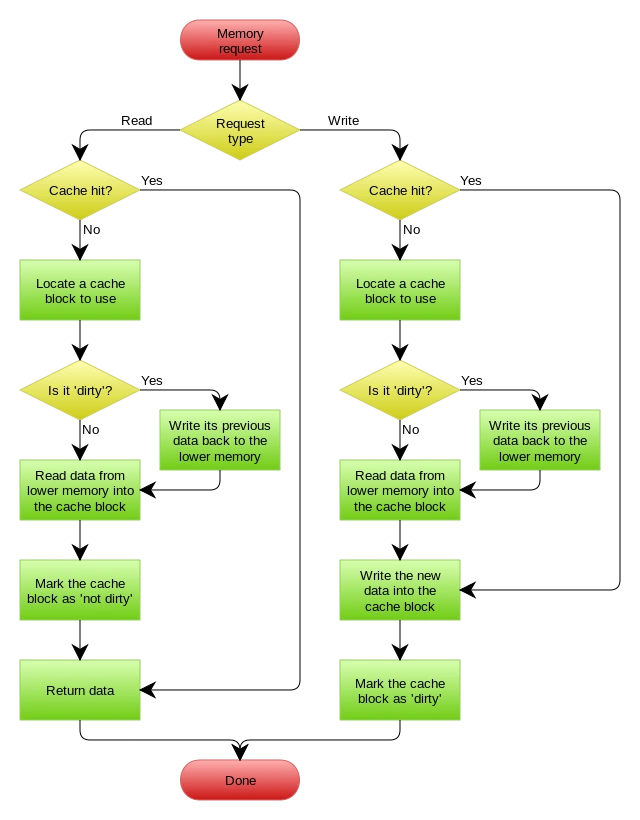

Stream 的基础方法,使用 xadd 存入消息和 xread 循环阻塞读取消息的方式可以实现简易版的消息队列,交互流程如下图所示:

前面介绍的这些操作 List 也支持的,接下来看看 Stream 特有的功能。

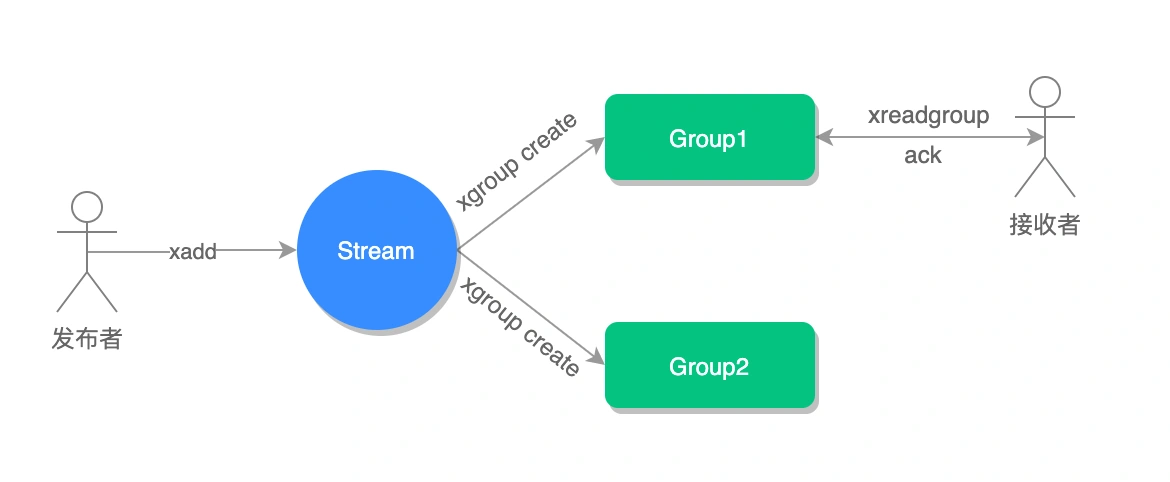

Stream 可以以使用 XGROUP 创建消费组 ,创建消费组之后,Stream 可以使用 XREADGROUP 命令让消费组内的消费者读取消息。

创建两个消费组,这两个消费组消费的消息队列是 mymq,都指定从第一条消息开始读取:

# 创建一个名为 group1 的消费组,0-0 表示从第一条消息开始读取。

> XGROUP CREATE mymq group1 0-0

OK

# 创建一个名为 group2 的消费组,0-0 表示从第一条消息开始读取。

> XGROUP CREATE mymq group2 0-0

OK

消费组 group1 内的消费者 consumer1 从 mymq 消息队列中读取所有消息的命令如下:

# 命令最后的参数“>”,表示从第一条尚未被消费的消息开始读取。

> XREADGROUP GROUP group1 consumer1 STREAMS mymq >

1) 1) "mymq"

2) 1) 1) "1654254953808-0"

2) 1) "name"

2) "xiaolin"

消息队列中的消息一旦被消费组里的一个消费者读取了,就不能再被该消费组内的其他消费者读取了,即同一个消费组里的消费者不能消费同一条消息 。

比如说,我们执行完刚才的 XREADGROUP 命令后,再执行一次同样的命令,此时读到的就是空值了:

> XREADGROUP GROUP group1 consumer1 STREAMS mymq >

(nil)

但是, 不同消费组的消费者可以消费同一条消息(但是有前提条件,创建消息组的时候,不同消费组指定了相同位置开始读取消息) 。

比如说,刚才 group1 消费组里的 consumer1 消费者消费了一条 id 为 1654254953808-0 的消息,现在用 group2 消费组里的 consumer1 消费者消费消息:

> XREADGROUP GROUP group2 consumer1 STREAMS mymq >

1) 1) "mymq"

2) 1) 1) "1654254953808-0"

2) 1) "name"

2) "xiaolin"

因为我创建两组的消费组都是从第一条消息开始读取,所以可以看到第二组的消费者依然可以消费 id 为 1654254953808-0 的这一条消息。因此,不同的消费组的消费者可以消费同一条消息。

使用消费组的目的是让组内的多个消费者共同分担读取消息,所以,我们通常会让每个消费者读取部分消息,从而实现消息读取负载在多个消费者间是均衡分布的。

例如,我们执行下列命令,让 group2 中的 consumer1、2、3 各自读取一条消息。

# 让 group2 中的 consumer1 从 mymq 消息队列中消费一条消息

> XREADGROUP GROUP group2 consumer1 COUNT 1 STREAMS mymq >

1) 1) "mymq"

2) 1) 1) "1654254953808-0"

2) 1) "name"

2) "xiaolin"

# 让 group2 中的 consumer2 从 mymq 消息队列中消费一条消息

> XREADGROUP GROUP group2 consumer2 COUNT 1 STREAMS mymq >

1) 1) "mymq"

2) 1) 1) "1654256265584-0"

2) 1) "name"

2) "xiaolincoding"

# 让 group2 中的 consumer3 从 mymq 消息队列中消费一条消息

> XREADGROUP GROUP group2 consumer3 COUNT 1 STREAMS mymq >

1) 1) "mymq"

2) 1) 1) "1654256271337-0"

2) 1) "name"

2) "Tom"

基于 Stream 实现的消息队列,如何保证消费者在发生故障或宕机再次重启后,仍然可以读取未处理完的消息?

Streams 会自动使用内部队列(也称为 PENDING List)留存消费组里每个消费者读取的消息,直到消费者使用 XACK 命令通知 Streams“消息已经处理完成”。

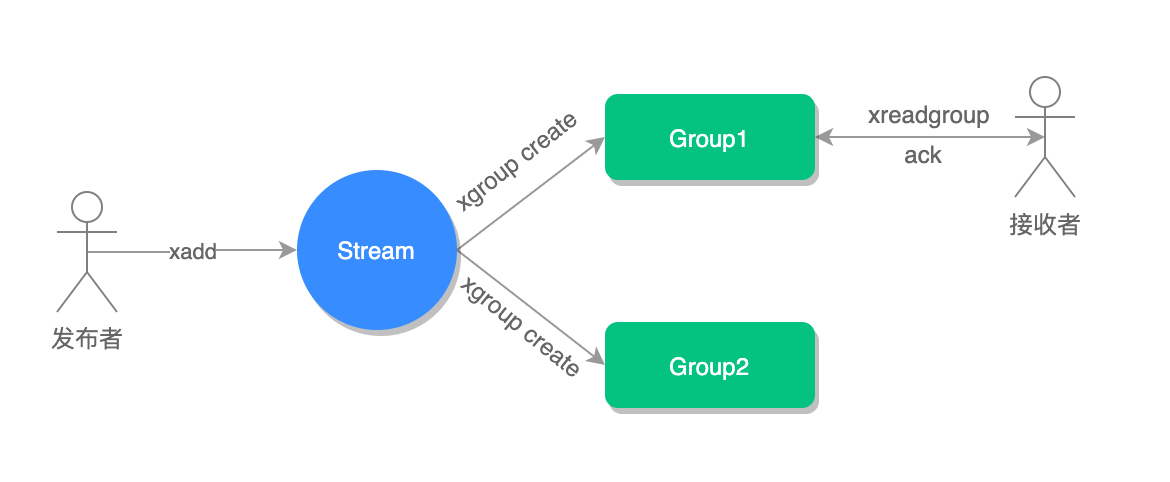

消费确认增加了消息的可靠性,一般在业务处理完成之后,需要执行 XACK 命令确认消息已经被消费完成,整个流程的执行如下图所示:

如果消费者没有成功处理消息,它就不会给 Streams 发送 XACK 命令,消息仍然会留存。此时, 消费者可以在重启后,用 XPENDING 命令查看已读取、但尚未确认处理完成的消息 。

例如,我们来查看一下 group2 中各个消费者已读取、但尚未确认的消息个数,命令如下:

127.0.0.1:6379> XPENDING mymq group2

1) (integer) 3

2) "1654254953808-0" # 表示 group2 中所有消费者读取的消息最小 ID

3) "1654256271337-0" # 表示 group2 中所有消费者读取的消息最大 ID

4) 1) 1) "consumer1"

2) "1"

2) 1) "consumer2"

2) "1"

3) 1) "consumer3"

2) "1"

如果想查看某个消费者具体读取了哪些数据,可以执行下面的命令:

# 查看 group2 里 consumer2 已从 mymq 消息队列中读取了哪些消息

> XPENDING mymq group2 - + 10 consumer2

1) 1) "1654256265584-0"

2) "consumer2"

3) (integer) 410700

4) (integer) 1

可以看到,consumer2 已读取的消息的 ID 是 1654256265584-0。

一旦消息 1654256265584-0 被 consumer2 处理了,consumer2 就可以使用 XACK 命令通知 Streams,然后这条消息就会被删除 。

> XACK mymq group2 1654256265584-0

(integer) 1

当我们再使用 XPENDING 命令查看时,就可以看到,consumer2 已经没有已读取、但尚未确认处理的消息了。

> XPENDING mymq group2 - + 10 consumer2

(empty array)

好了,基于 Stream 实现的消息队列就说到这里了,小结一下:

- 消息保序:XADD/XREAD

- 阻塞读取:XREAD block

- 重复消息处理:Stream 在使用 XADD 命令,会自动生成全局唯一 ID;

- 消息可靠性:内部使用 PENDING List 自动保存消息,使用 XPENDING 命令查看消费组已经读取但是未被确认的消息,消费者使用 XACK 确认消息;

- 支持消费组形式消费数据

Redis 基于 Stream 消息队列与专业的消息队列有哪些差距?

一个专业的消息队列,必须要做到两大块:

- 消息不丢。

- 消息可堆积。

1、Redis Stream 消息会丢失吗?

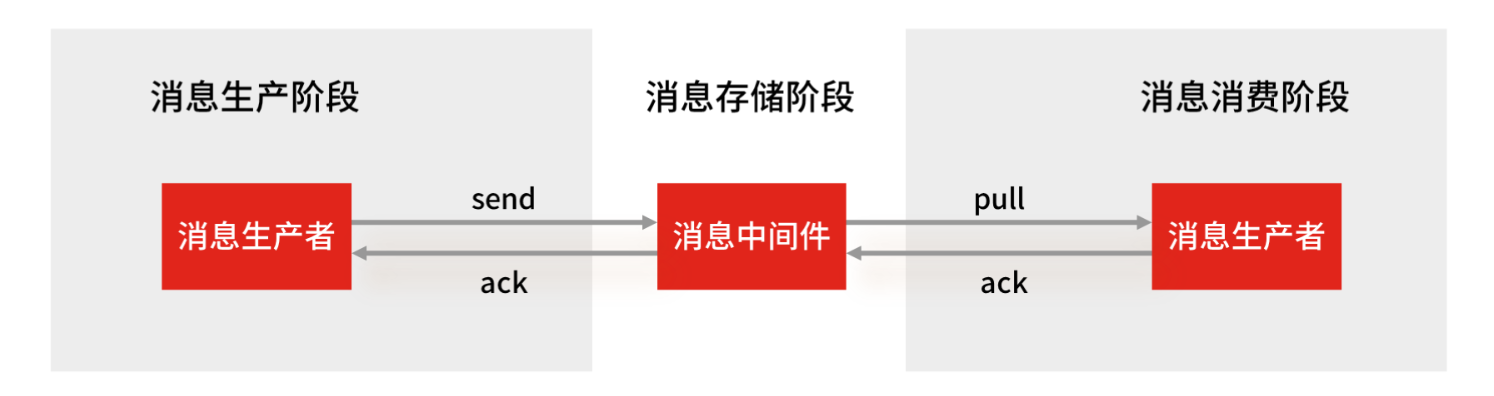

使用一个消息队列,其实就分为三大块: 生产者、队列中间件、消费者 ,所以要保证消息就是保证三个环节都不能丢失数据。

Redis Stream 消息队列能不能保证三个环节都不丢失数据?

- Redis 生产者会不会丢消息?生产者会不会丢消息,取决于生产者对于异常情况的处理是否合理。 从消息被生产出来,然后提交给 MQ 的过程中,只要能正常收到 ( MQ 中间件) 的 ack 确认响应,就表示发送成功,所以只要处理好返回值和异常,如果返回异常则进行消息重发,那么这个阶段是不会出现消息丢失的。

- Redis 消费者会不会丢消息?不会,因为 Stream ( MQ 中间件)会自动使用内部队列(也称为 PENDING List)留存消费组里每个消费者读取的消息,但是未被确认的消息。消费者可以在重启后,用 XPENDING 命令查看已读取、但尚未确认处理完成的消息。等到消费者执行完业务逻辑后,再发送消费确认 XACK 命令,也能保证消息的不丢失。

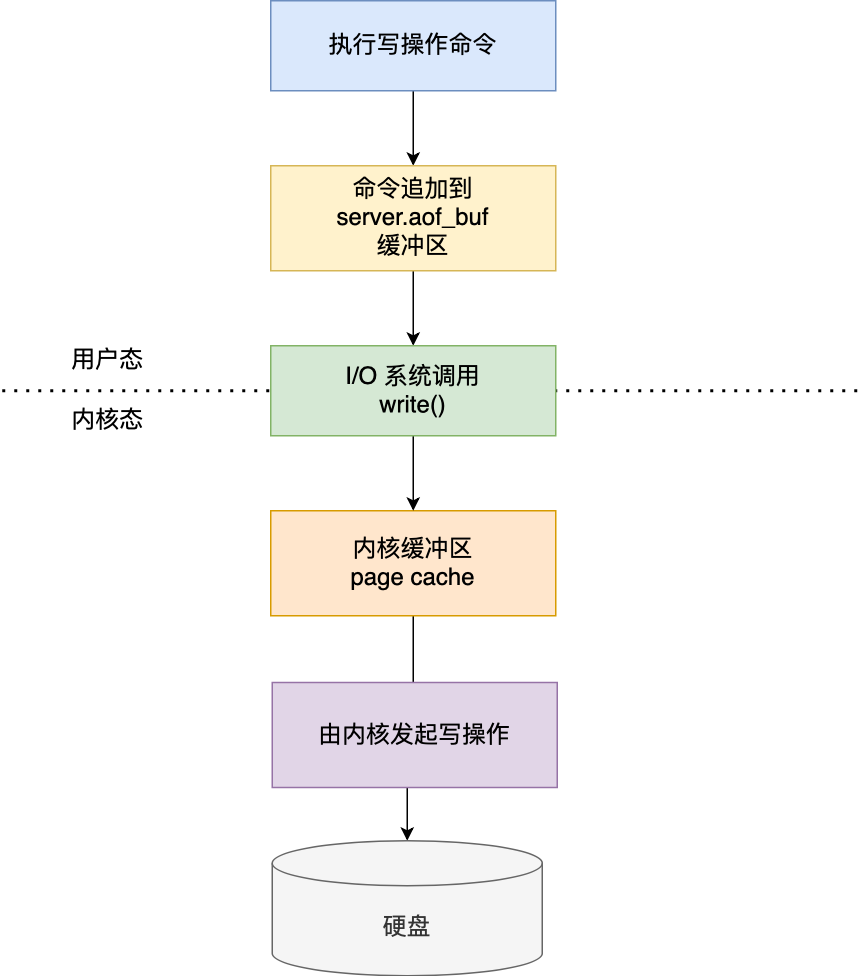

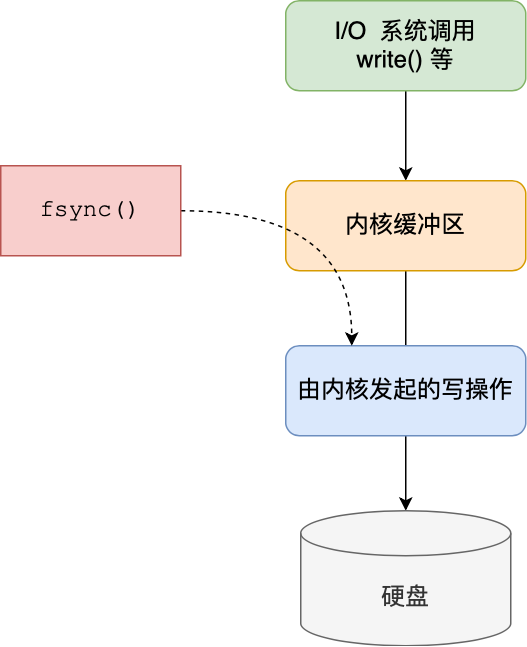

- Redis 消息中间件会不会丢消息? 会 ,Redis 在以下 2 个场景下,都会导致数据丢失:

- AOF 持久化配置为每秒写盘,但这个写盘过程是异步的,Redis 宕机时会存在数据丢失的可能

- 主从复制也是异步的,主从切换时,也存在丢失数据的可能 (opens new window)。

可以看到,Redis 在队列中间件环节无法保证消息不丢。像 RabbitMQ 或 Kafka 这类专业的队列中间件,在使用时是部署一个集群,生产者在发布消息时,队列中间件通常会写「多个节点」,也就是有多个副本,这样一来,即便其中一个节点挂了,也能保证集群的数据不丢失。

2、Redis Stream 消息可堆积吗?

Redis 的数据都存储在内存中,这就意味着一旦发生消息积压,则会导致 Redis 的内存持续增长,如果超过机器内存上限,就会面临被 OOM 的风险。

所以 Redis 的 Stream 提供了可以指定队列最大长度的功能,就是为了避免这种情况发生。

当指定队列最大长度时,队列长度超过上限后,旧消息会被删除,只保留固定长度的新消息。这么来看,Stream 在消息积压时,如果指定了最大长度,还是有可能丢失消息的。

但 Kafka、RabbitMQ 专业的消息队列它们的数据都是存储在磁盘上,当消息积压时,无非就是多占用一些磁盘空间。

因此,把 Redis 当作队列来使用时,会面临的 2 个问题:

- Redis 本身可能会丢数据;

- 面对消息挤压,内存资源会紧张;

所以,能不能将 Redis 作为消息队列来使用,关键看你的业务场景:

- 如果你的业务场景足够简单,对于数据丢失不敏感,而且消息积压概率比较小的情况下,把 Redis 当作队列是完全可以的。

- 如果你的业务有海量消息,消息积压的概率比较大,并且不能接受数据丢失,那么还是用专业的消息队列中间件吧。

补充:Redis 发布/订阅机制为什么不可以作为消息队列?

发布订阅机制存在以下缺点,都是跟丢失数据有关:

- 发布/订阅机制没有基于任何数据类型实现,所以不具备「数据持久化」的能力,也就是发布/订阅机制的相关操作,不会写入到 RDB 和 AOF 中,当 Redis 宕机重启,发布/订阅机制的数据也会全部丢失。

- 发布订阅模式是“发后既忘”的工作模式,如果有订阅者离线重连之后不能消费之前的历史消息。

- 当消费端有一定的消息积压时,也就是生产者发送的消息,消费者消费不过来时,如果超过 32M 或者是 60s 内持续保持在 8M 以上,消费端会被强行断开,这个参数是在配置文件中设置的,默认值是

client-output-buffer-limit pubsub 32mb 8mb 60。

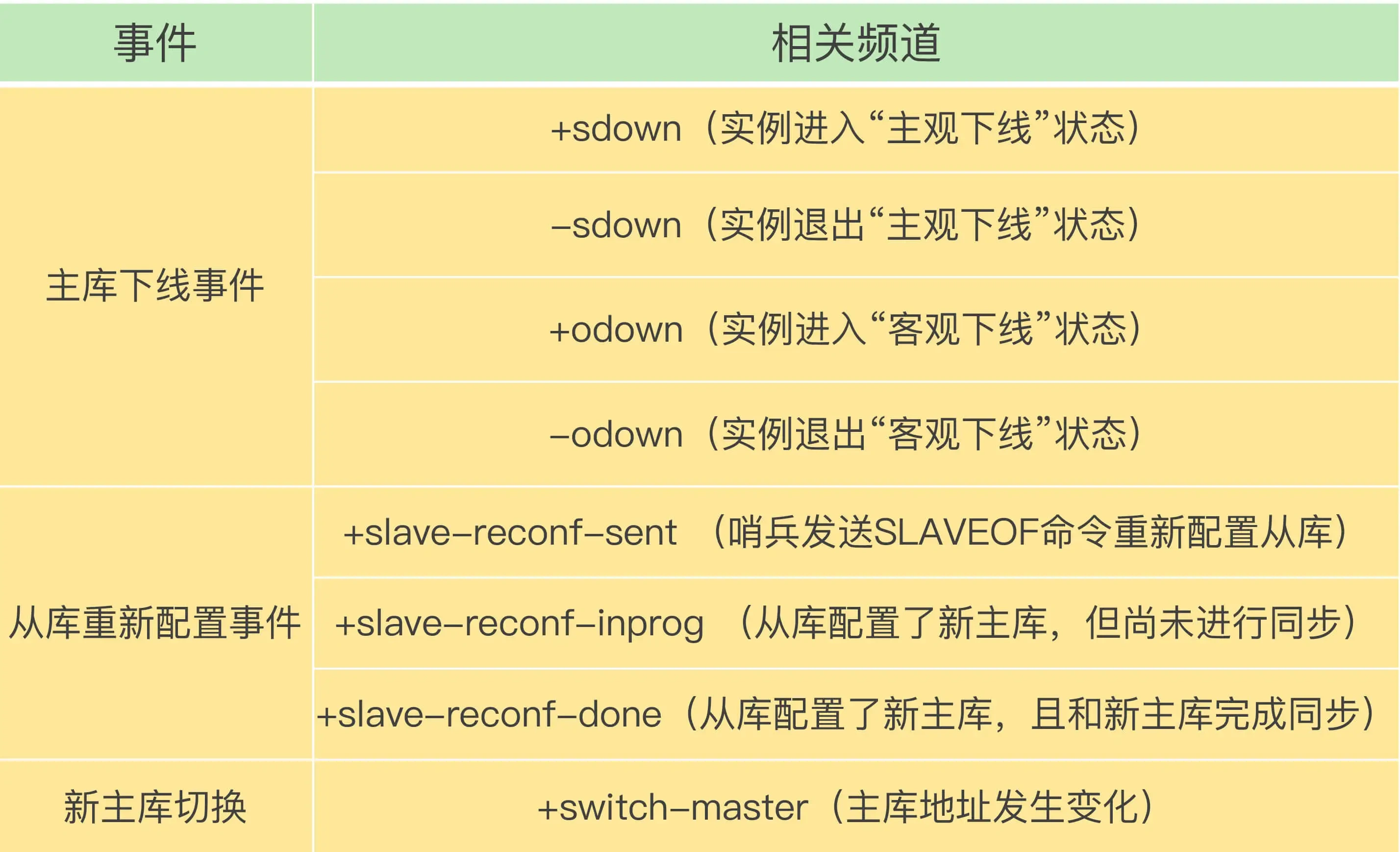

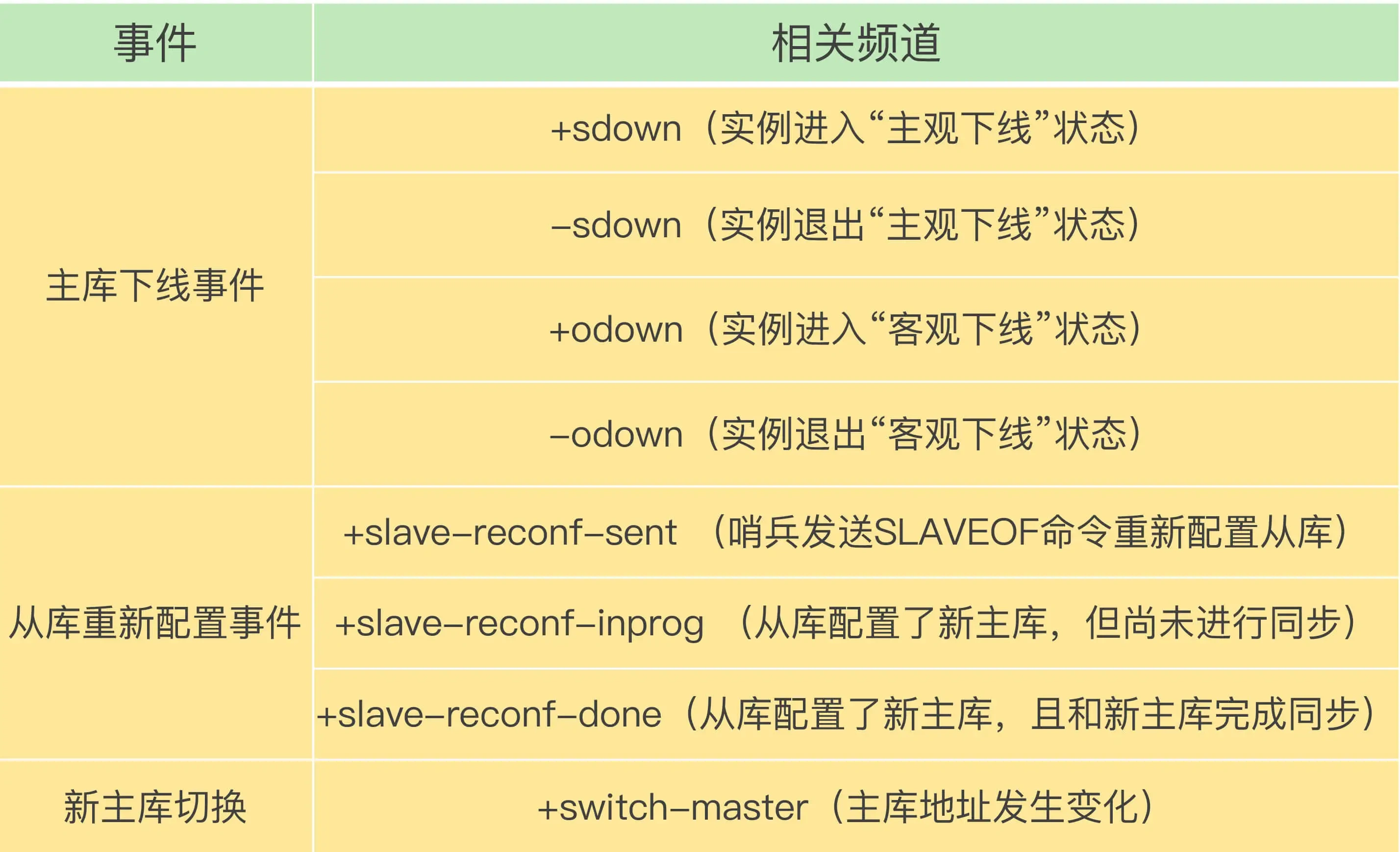

所以,发布/订阅机制只适合即使通讯的场景,比如构建哨兵集群的场景采用了发布/订阅机制。redis的key过期删除策略

设置过期时间

expire <key> <n>:设置 key 在 n 秒后过期,比如 expire key 100 表示设置 key 在 100 秒后过期;pexpire <key> <n>:设置 key 在 n 毫秒后过期,比如 pexpire key2 100000 表示设置 key2 在 100000 毫秒(100 秒)后过期。expireat <key> <n>:设置 key 在某个时间戳(精确到秒)之后过期,比如 expireat key3 1655654400 表示 key3 在时间戳 1655654400 后过期(精确到秒);pexpireat <key> <n>:设置 key 在某个时间戳(精确到毫秒)之后过期,比如 pexpireat key4 1655654400000 表示 key4 在时间戳 1655654400000 后过期(精确到毫秒)

当然,在设置字符串时,也可以同时对 key 设置过期时间,共有 3 种命令:

set <key> <value> ex <n>:设置键值对的时候,同时指定过期时间(精确到秒);set <key> <value> px <n>:设置键值对的时候,同时指定过期时间(精确到毫秒);setex <key> <n> <valule>:设置键值对的时候,同时指定过期时间(精确到秒)。

查看key的过期时间

ttl <key>

取消过期时间

persist <key>

怎么判断过期时间

每当我们对一个 key 设置了过期时间时,Redis 会把该 key 带上过期时间存储到一个 过期字典 (expires dict)中,也就是说「过期字典」保存了数据库中所有 key 的过期时间。

过期字典存储在 redisDb 结构中,如下:

typedef struct redisDb {

dict *dict; /* 数据库键空间,存放着所有的键值对 */

dict *expires; /* 键的过期时间 */

....

} redisDb;

过期字典数据结构结构如下:

- 过期字典的 key 是一个指针,指向某个键对象;

- 过期字典的 value 是一个 long long 类型的整数,这个整数保存了 key 的过期时间;

查询key值的流程:

字典实际上是哈希表,哈希表的最大好处就是让我们可以用 O(1) 的时间复杂度来快速查找。当我们查询一个 key 时,Redis 首先检查该 key 是否存在于过期字典中:

字典实际上是哈希表,哈希表的最大好处就是让我们可以用 O(1) 的时间复杂度来快速查找。当我们查询一个 key 时,Redis 首先检查该 key 是否存在于过期字典中:

- 如果不在,则正常读取键值;

- 如果存在,则会获取该 key 的过期时间,然后与当前系统时间进行比对,如果比系统时间大,那就没有过期,否则判定该 key 已过期。

过期删除策略

常见有三种过期删除策略:

- 定时删除;

- 惰性删除;

- 定期删除;

定时删除策略

做法:在设置 key 的过期时间时,同时创建一个定时事件,当时间到达时,由事件处理器自动执行 key 的删除操作。

优点:可以保证过期 key 会被尽快删除,也就是内存可以被尽快地释放。因此,定时删除对内存是最友好的。

缺点:在过期 key 比较多的情况下,删除过期 key 可能会占用相当一部分 CPU 时间,在内存不紧张但 CPU 时间紧张的情况下,将 CPU 时间用于删除和当前任务无关的过期键上,无疑会对服务器的响应时间和吞吐量造成影响。所以,定时删除策略对 CPU 不友好。

惰性删除策略

做法:不主动删除过期键,每次从数据库访问 key 时,都检测 key 是否过期,如果过期则删除该 key。

优点:因为每次访问时,才会检查 key 是否过期,所以此策略只会使用很少的系统资源,因此,惰性删除策略对 CPU 时间最友好。

缺点:如果一个 key 已经过期,而这个 key 又仍然保留在数据库中,那么只要这个过期 key 一直没有被访问,它所占用的内存就不会释放,造成了一定的内存空间浪费。所以,惰性删除策略对内存不友好。

定期删除策略

做法:每隔一段时间「随机」从数据库中取出一定数量的 key 进行检查,并删除其中的过期key。

优点:通过限制删除操作执行的时长和频率,来减少删除操作对 CPU 的影响,同时也能删除一部分过期的数据减少了过期键对空间的无效占用。

缺点:

- 内存清理方面没有定时删除效果好,同时没有惰性删除使用的系统资源少。

- 难以确定删除操作执行的时长和频率。如果执行的太频繁,定期删除策略变得和定时删除策略一样,对CPU不友好;如果执行的太少,那又和惰性删除一样了,过期 key 占用的内存不会及时得到释放。

redis设置过期删除策略

Redis 选择「惰性删除+定期删除」这两种策略配和使用。

惰性删除实现

Redis 的惰性删除策略由 db.c 文件中的 expireIfNeeded 函数实现,代码如下:

int expireIfNeeded(redisDb *db, robj *key) {

// 判断 key 是否过期

if (!keyIsExpired(db,key)) return 0;

....

/* 删除过期键 */

....

// 如果 server.lazyfree_lazy_expire 为 1 表示异步删除,反之同步删除;

return server.lazyfree_lazy_expire ? dbAsyncDelete(db,key) :

dbSyncDelete(db,key);

}

Redis 在访问或者修改 key 之前,都会调用 expireIfNeeded 函数对其进行检查,检查 key 是否过期:

- 如果过期,则删除该 key,至于选择异步删除,还是选择同步删除,根据

lazyfree_lazy_expire参数配置决定(Redis 4.0版本开始提供参数),然后返回 null 客户端; - 如果没有过期,不做任何处理,然后返回正常的键值对给客户端;

定期删除实现

Redis的定期删除策略:

做法:每隔一段时间「随机」从数据库中取出一定数量的 key 进行检查,并删除其中的过期key。

1、这个间隔检查的时间是多长呢?

在 Redis 中,默认每秒进行 10 次过期检查一次数据库,此配置可通过 Redis 的配置文件 redis.conf 进行配置,配置键为 hz 它的默认值是 hz 10。

特别强调下,每次检查数据库并不是遍历过期字典中的所有 key,而是从数据库中随机抽取一定数量的 key 进行过期检查。

2、随机抽查的数量是多少呢?

我查了下源码,定期删除的实现在 expire.c 文件下的 activeExpireCycle 函数中,其中随机抽查的数量由 ACTIVE_EXPIRE_CYCLE_LOOKUPS_PER_LOOP 定义的,它是写死在代码中的,数值是 20。

也就是说,数据库每轮抽查时,会随机选择 20 个 key 判断是否过期。

接下来,详细说说 Redis 的定期删除的流程:

- 从过期字典中随机抽取 20 个 key;

- 检查这 20 个 key 是否过期,并删除已过期的 key;

- 如果本轮检查的已过期 key 的数量,超过 5 个(20/4),也就是「已过期 key 的数量」占比「随机抽取 key 的数量」大于 25%,则继续重复步骤 1;如果已过期的 key 比例小于 25%,则停止继续删除过期 key,然后等待下一轮再检查。

可以看到,定期删除是一个循环的流程。

那 Redis 为了保证定期删除不会出现循环过度,导致线程卡死现象,为此增加了定期删除循环流程的时间上限,默认不会超过 25ms。

redis的数据结构

共有 8 种数据结构:SDS、双向链表、压缩列表、哈希表、跳表、整数集合、quicklist、listpack。

redis保存键值涉及到的结构

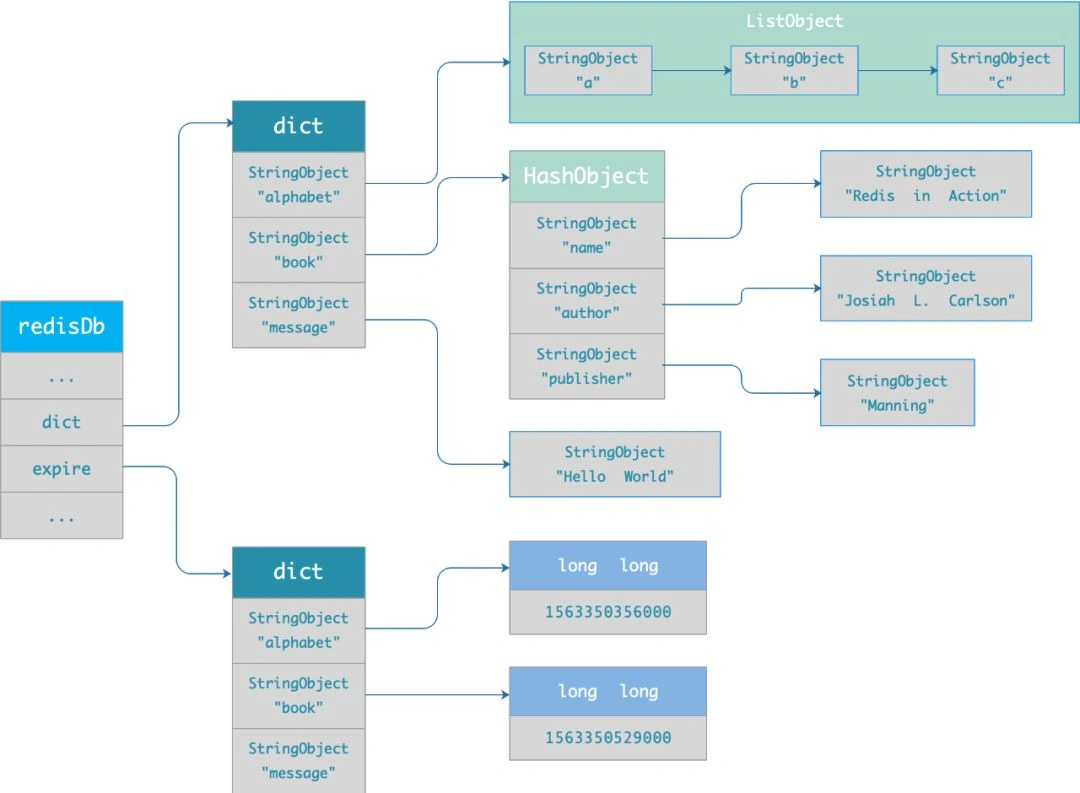

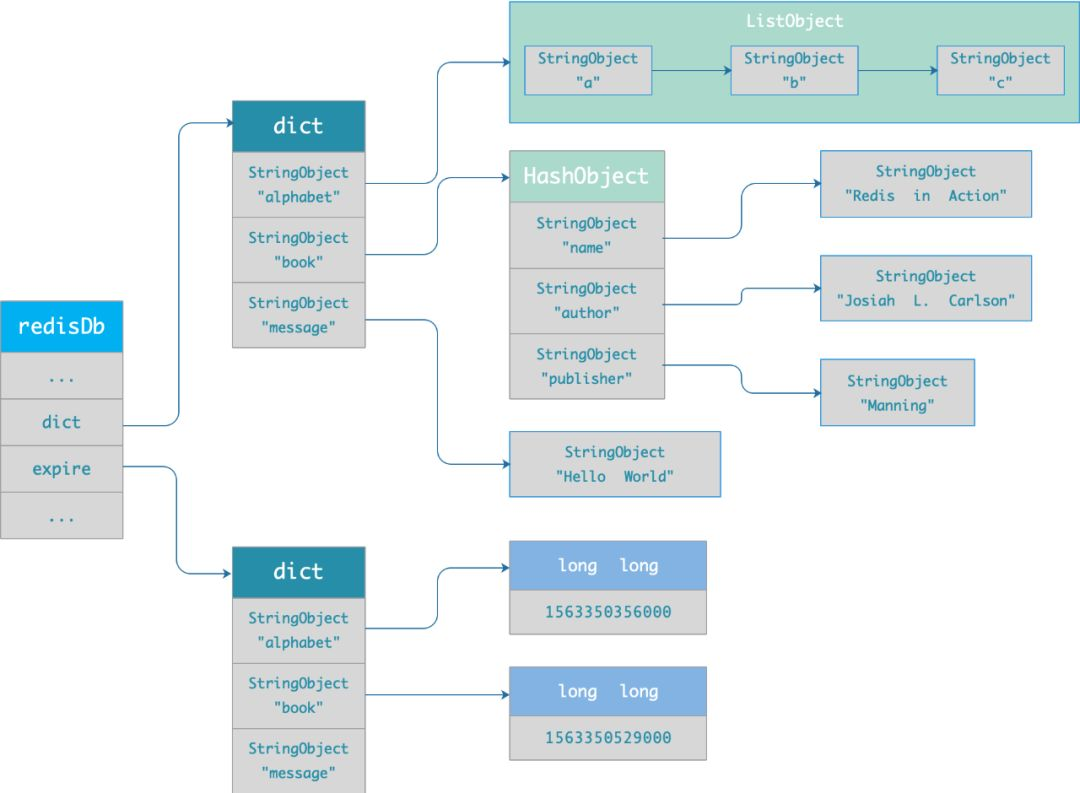

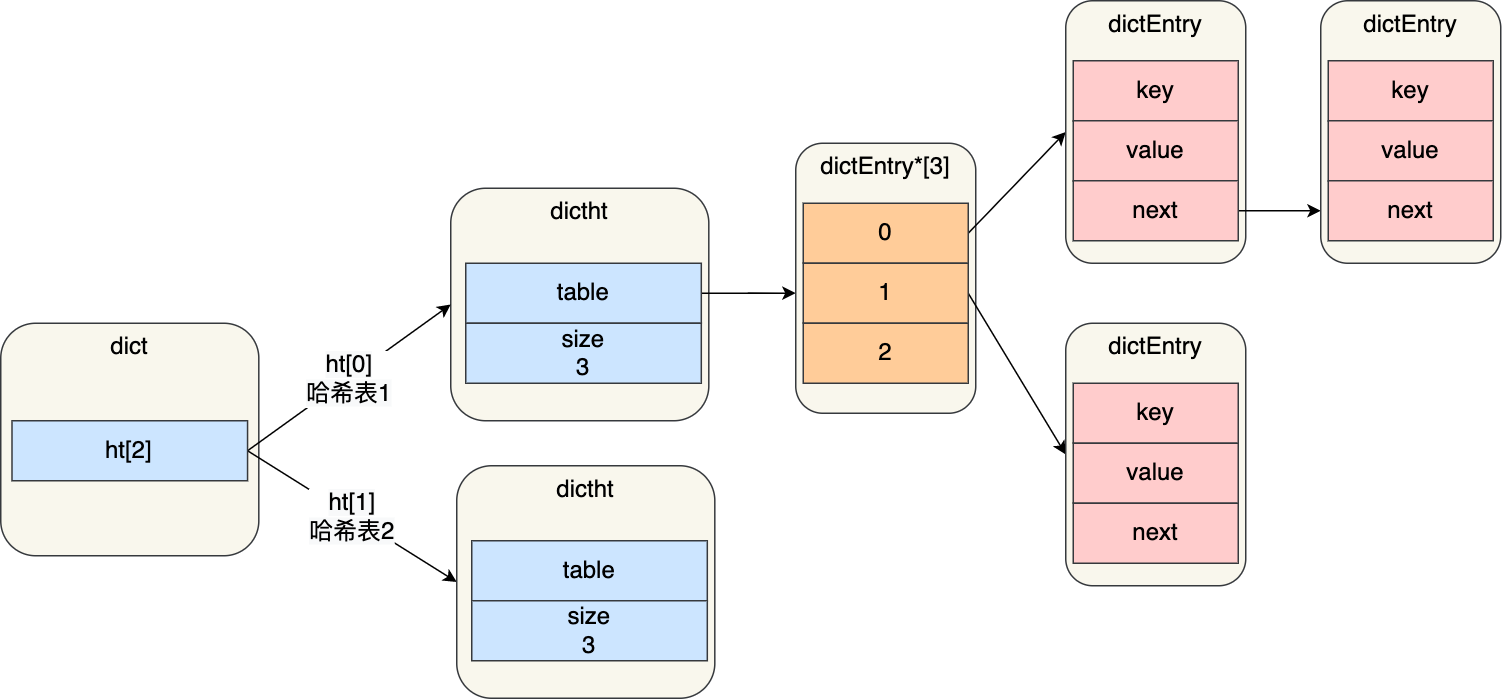

这些数据结构的内部细节,我先不展开讲,后面在讲哈希表数据结构的时候,在详细的说说,因为用到的数据结构是一样的。这里先大概说下图中涉及到的数据结构的名字和用途:

- redisDb 结构,表示 Redis 数据库的结构,结构体里存放了指向了 dict 结构的指针;

- dict 结构,结构体里存放了 2 个哈希表,正常情况下都是用「哈希表1」,「哈希表2」只有在 rehash 的时候才用,具体什么是 rehash,我在本文的哈希表数据结构会讲;

- ditctht 结构,表示哈希表的结构,结构里存放了哈希表数组,数组中的每个元素都是指向一个哈希表节点结构(dictEntry)的指针;

- dictEntry 结构,表示哈希表节点的结构,结构里存放了 **void * key 和 void * value 指针, key 指向的是 String 对象,而 value 则可以指向 String 对象,也可以指向集合类型的对象,比如 List 对象、Hash 对象、Set 对象和 Zset 对象 。

特别说明下,void * key 和 void * value 指针指向的是 Redis 对象 ,Redis 中的每个对象都由 redisObject 结构表示,如下图:

对象结构里包含的成员变量:

- type,标识该对象是什么类型的对象(String 对象、 List 对象、Hash 对象、Set 对象和 Zset 对象);

- encoding,标识该对象使用了哪种底层的数据结构;

- ptr,指向底层数据结构的指针 。

我画了一张 Redis 键值对数据库的全景图,你就能清晰知道 Redis 对象和数据结构的关系了:

接下里,就好好聊一下底层数据结构!

1.SDS

字符串在 Redis 中是很常用的,键值对中的键是字符串类型,值有时也是字符串类型。

Redis 是用 C 语言实现的,但是它没有直接使用 C 语言的 char* 字符数组来实现字符串,而是自己封装了一个名为简单动态字符串(simple dynamic string,SDS) 的数据结构来表示字符串,也就是 Redis 的 String 数据类型的底层数据结构是 SDS。

既然 Redis 设计了 SDS 结构来表示字符串,肯定是 C 语言的 char* 字符数组存在一些缺陷。

要了解这一点,得先来看看 char* 字符数组的结构。

C 语言字符串的缺陷

C 语言的字符串其实就是一个字符数组,即数组中每个元素是字符串中的一个字符。

比如,下图就是字符串“xiaolin”的 char* 字符数组的结构:

没学过 C 语言的同学,可能会好奇为什么最后一个字符是“\0”?

在 C 语言里,对字符串操作时,char * 指针只是指向字符数组的起始位置,而 字符数组的结尾位置就用“\0”表示,意思是指字符串的结束 。

因此,C 语言标准库中的字符串操作函数就通过判断字符是不是 “\0” 来决定要不要停止操作,如果当前字符不是 “\0” ,说明字符串还没结束,可以继续操作,如果当前字符是 “\0” 是则说明字符串结束了,就要停止操作。

举个例子,C 语言获取字符串长度的函数 strlen,就是通过字符数组中的每一个字符,并进行计数,等遇到字符为 “\0” 后,就会停止遍历,然后返回已经统计到的字符个数,即为字符串长度。下图显示了 strlen 函数的执行流程:

很明显, C 语言获取字符串长度的时间复杂度是 O(N)(这是一个可以改进的地方 )

C 语言字符串用 “\0” 字符作为结尾标记有个缺陷。假设有个字符串中有个 “\0” 字符,这时在操作这个字符串时就会 提早结束 ,比如 “xiao\0lin” 字符串,计算字符串长度的时候则会是 4,如下图:

因此,除了字符串的末尾之外, 字符串里面不能含有 “\0” 字符 ,否则最先被程序读入的 “\0” 字符将被误认为是字符串结尾,这个限制使得 C 语言的字符串只能保存文本数据,不能保存像图片、音频、视频文化这样的二进制数据( 这也是一个可以改进的地方 )

另外, C 语言标准库中字符串的操作函数是很不安全的,对程序员很不友好,稍微一不注意,就会导致缓冲区溢出。

举个例子,strcat 函数是可以将两个字符串拼接在一起。

//将 src 字符串拼接到 dest 字符串后面

char *strcat(char *dest, const char* src);

C 语言的字符串是不会记录自身的缓冲区大小的 ,所以 strcat 函数假定程序员在执行这个函数时,已经为 dest 分配了足够多的内存,可以容纳 src 字符串中的所有内容,而 一旦这个假定不成立,就会发生缓冲区溢出将可能会造成程序运行终止,(这是一个可以改进的地方 )。

而且,strcat 函数和 strlen 函数类似,时间复杂度也很高,也都需要先通过遍历字符串才能得到目标字符串的末尾。然后对于 strcat 函数来说,还要再遍历源字符串才能完成追加, 对字符串的操作效率不高 。

好了, 通过以上的分析,我们可以得知 C 语言的字符串不足之处以及可以改进的地方:

- 获取字符串长度的时间复杂度为 O(N);

- 字符串的结尾是以 “\0” 字符标识,字符串里面不能包含有 “\0” 字符,因此不能保存二进制数据;

- 字符串操作函数不高效且不安全,比如有缓冲区溢出的风险,有可能会造成程序运行终止;

Redis 实现的 SDS 的结构就把上面这些问题解决了,接下来我们一起看看 Redis 是如何解决的。

SDS 结构设计

下图就是 Redis 5.0 的 SDS 的数据结构:

结构中的每个成员变量分别介绍下:

- len,记录了字符串长度 。这样获取字符串长度的时候,只需要返回这个成员变量值就行,时间复杂度只需要 O(1)。

- alloc,分配给字符数组的空间长度 。这样在修改字符串的时候,可以通过

alloc - len计算出剩余的空间大小,可以用来判断空间是否满足修改需求,如果不满足的话,就会自动将 SDS 的空间扩展至执行修改所需的大小,然后才执行实际的修改操作,所以使用 SDS 既不需要手动修改 SDS 的空间大小,也不会出现前面所说的缓冲区溢出的问题。 - flags,用来表示不同类型的 SDS 。一共设计了 5 种类型,分别是 sdshdr5、sdshdr8、sdshdr16、sdshdr32 和 sdshdr64,后面在说明区别之处。

- buf[],字符数组,用来保存实际数据 。不仅可以保存字符串,也可以保存二进制数据。

总的来说,Redis 的 SDS 结构在原本字符数组之上,增加了三个元数据:len、alloc、flags,用来解决 C 语言字符串的缺陷。

O(1)复杂度获取字符串长度

C 语言的字符串长度获取 strlen 函数,需要通过遍历的方式来统计字符串长度,时间复杂度是 O(N)。

而 Redis 的 SDS 结构因为加入了 len 成员变量,那么 获取字符串长度的时候,直接返回这个成员变量的值就行,所以复杂度只有 O(1) 。

二进制安全

因为 SDS 不需要用 “\0” 字符来标识字符串结尾了,而是 有个专门的 len 成员变量来记录长度,所以可存储包含 “\0” 的数据 。但是 SDS 为了兼容部分 C 语言标准库的函数, SDS 字符串结尾还是会加上 “\0” 字符。

因此, SDS 的 API 都是以处理二进制的方式来处理 SDS 存放在 buf[] 里的数据,程序不会对其中的数据做任何限制,数据写入的时候时什么样的,它被读取时就是什么样的。

通过使用二进制安全的 SDS,而不是 C 字符串,使得 Redis 不仅可以保存文本数据,也可以保存任意格式的二进制数据。

不会发生缓冲区溢出

C 语言的字符串标准库提供的字符串操作函数,大多数(比如 strcat 追加字符串函数)都是不安全的,因为这些函数把缓冲区大小是否满足操作需求的工作交由开发者来保证,程序内部并不会判断缓冲区大小是否足够用,当发生了缓冲区溢出就有可能造成程序异常结束。

所以,Redis 的 SDS 结构里引入了 alloc 和 len 成员变量,这样 SDS API 通过 alloc - len 计算,可以算出剩余可用的空间大小,这样在对字符串做修改操作的时候,就可以由程序内部判断缓冲区大小是否足够用。

而且, 当判断出缓冲区大小不够用时,Redis 会自动将扩大 SDS 的空间大小(小于 1MB 翻倍扩容,大于 1MB 按 1MB 扩容) ,以满足修改所需的大小。

在扩展 SDS 空间之前,SDS API 会优先检查未使用空间是否足够,如果不够的话,API 不仅会为 SDS 分配修改所必须要的空间,还会给 SDS 分配额外的「未使用空间」。

这样的好处是,下次在操作 SDS 时,如果 SDS 空间够的话,API 就会直接使用「未使用空间」,而无须执行内存分配, 有效的减少内存分配次数 。

所以,使用 SDS 即不需要手动修改 SDS 的空间大小,也不会出现缓冲区溢出的问题。

节省内存空间

SDS 结构中有个 flags 成员变量,表示的是 SDS 类型。

Redis 一共设计了 5 种类型,分别是 sdshdr5、sdshdr8、sdshdr16、sdshdr32 和 sdshdr64。

这 5 种类型的主要 区别就在于,它们数据结构中的 len 和 alloc 成员变量的数据类型不同 。

比如 sdshdr16 和 sdshdr32 这两个类型,它们的定义分别如下:

struct __attribute__ ((__packed__)) sdshdr16 {

uint16_t len;

uint16_t alloc;

unsigned char flags;

char buf[];

};

struct __attribute__ ((__packed__)) sdshdr32 {

uint32_t len;

uint32_t alloc;

unsigned char flags;

char buf[];

};

可以看到:

- sdshdr16 类型的 len 和 alloc 的数据类型都是 uint16_t,表示字符数组长度和分配空间大小不能超过 2 的 16 次方。

- sdshdr32 则都是 uint32_t,表示表示字符数组长度和分配空间大小不能超过 2 的 32 次方。

之所以 SDS 设计不同类型的结构体,是为了能灵活保存不同大小的字符串,从而有效节省内存空间 。比如,在保存小字符串时,结构头占用空间也比较少。

除了设计不同类型的结构体,Redis 在编程上还 使用了专门的编译优化来节省内存空间 ,即在 struct 声明了 __attribute__ ((packed)) ,它的作用是: 告诉编译器取消结构体在编译过程中的优化对齐,按照实际占用字节数进行对齐 。

比如,sdshdr16 类型的 SDS,默认情况下,编译器会按照 2 字节对齐的方式给变量分配内存,这意味着,即使一个变量的大小不到 2 个字节,编译器也会给它分配 2 个字节。

举个例子,假设下面这个结构体,它有两个成员变量,类型分别是 char 和 int,如下所示:

#include <stdio.h>

struct test1 {

char a;

int b;

} test1;

int main() {

printf("%lu\n", sizeof(test1));

return 0;

}

大家猜猜这个结构体大小是多少?我先直接说答案,这个结构体大小计算出来是 8。

这是因为默认情况下,编译器是使用「字节对齐」的方式分配内存,虽然 char 类型只占一个字节,但是由于成员变量里有 int 类型,它占用了 4 个字节,所以在成员变量为 char 类型分配内存时,会分配 4 个字节,其中这多余的 3 个字节是为了字节对齐而分配的,相当于有 3 个字节被浪费掉了。

如果不想编译器使用字节对齐的方式进行分配内存,可以采用了 __attribute__ ((packed)) 属性定义结构体,这样一来,结构体实际占用多少内存空间,编译器就分配多少空间。

比如,我用 __attribute__ ((packed)) 属性定义下面的结构体 ,同样包含 char 和 int 两个类型的成员变量,代码如下所示:

#include <stdio.h>

struct __attribute__((packed)) test2 {

char a;

int b;

} test2;

int main() {

printf("%lu\n", sizeof(test2));

return 0;

}

这时打印的结果是 5(1 个字节 char + 4 字节 int)。

可以看得出,这是按照实际占用字节数进行分配内存的,这样可以节省内存空间。

2.链表

大家最熟悉的数据结构除了数组之外,我相信就是链表了。

Redis 的 List 对象的底层实现之一就是链表。C 语言本身没有链表这个数据结构的,所以 Redis 自己设计了一个链表数据结构。

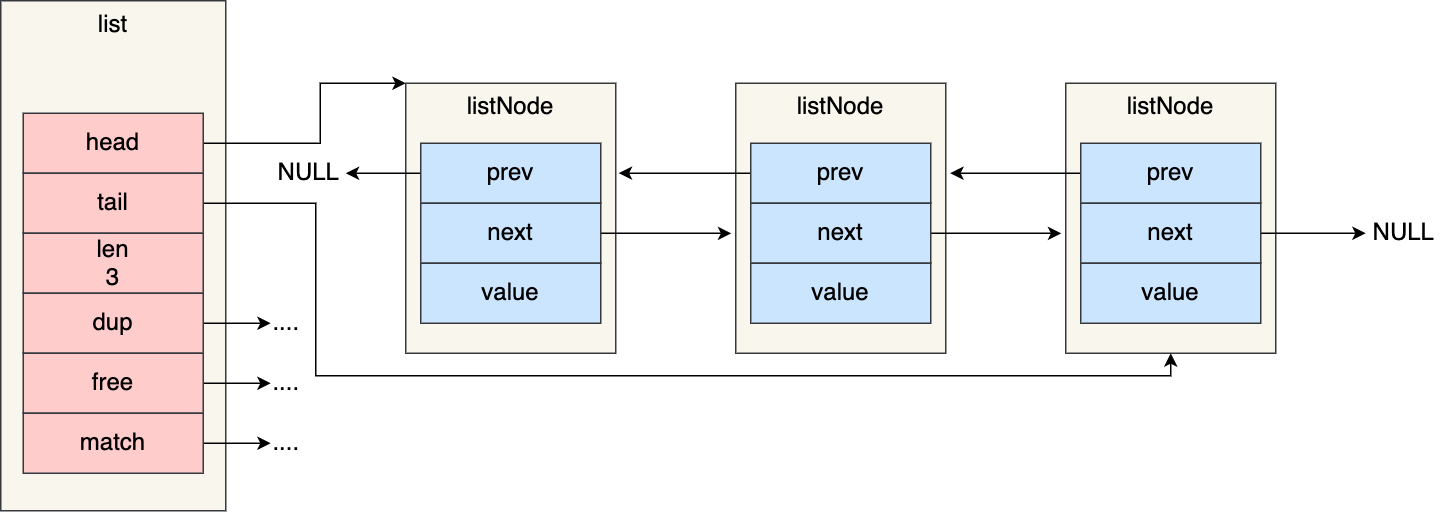

链表节点结构设计

先来看看「链表节点」结构的样子:

typedef struct listNode {

//前置节点

struct listNode *prev;

//后置节点

struct listNode *next;

//节点的值

void *value;

} listNode;

有前置节点和后置节点,可以看的出,这个是一个双向链表。

链表结构设计

不过,Redis 在 listNode 结构体基础上又封装了 list 这个数据结构,这样操作起来会更方便,链表结构如下:

typedef struct list {

//链表头节点

listNode *head;

//链表尾节点

listNode *tail;

//节点值复制函数

void *(*dup)(void *ptr);

//节点值释放函数

void (*free)(void *ptr);

//节点值比较函数

int (*match)(void *ptr, void *key);

//链表节点数量

unsigned long len;

} list;

list 结构为链表提供了链表头指针 head、链表尾节点 tail、链表节点数量 len、以及可以自定义实现的 dup、free、match 函数。

举个例子,下面是由 list 结构和 3 个 listNode 结构组成的链表。

链表的优势与缺陷

Redis 的链表实现优点如下:

- listNode 链表节点的结构里带有 prev 和 next 指针, 获取某个节点的前置节点或后置节点的时间复杂度只需O(1),而且这两个指针都可以指向 NULL,所以链表是无环链表 ;

- list 结构因为提供了表头指针 head 和表尾节点 tail,所以 获取链表的表头节点和表尾节点的时间复杂度只需O(1) ;

- list 结构因为提供了链表节点数量 len,所以 获取链表中的节点数量的时间复杂度只需O(1) ;

- listNode 链表节使用 void* 指针保存节点值,并且可以通过 list 结构的 dup、free、match 函数指针为节点设置该节点类型特定的函数,因此 链表节点可以保存各种不同类型的值 ;

链表的缺陷也是有的:

- 链表每个节点之间的内存都是不连续的,意味着 无法很好利用 CPU 缓存 。能很好利用 CPU 缓存的数据结构就是数组,因为数组的内存是连续的,这样就可以充分利用 CPU 缓存来加速访问。

- 还有一点,保存一个链表节点的值都需要一个链表节点结构头的分配, 内存开销较大 。

因此,Redis 3.0 的 List 对象在数据量比较少的情况下,会采用「压缩列表」作为底层数据结构的实现,它的优势是节省内存空间,并且是内存紧凑型的数据结构。

不过,压缩列表存在性能问题(具体什么问题,下面会说),所以 Redis 在 3.2 版本设计了新的数据结构 quicklist,并将 List 对象的底层数据结构改由 quicklist 实现。

然后在 Redis 5.0 设计了新的数据结构 listpack,沿用了压缩列表紧凑型的内存布局,最终在最新的 Redis 版本,将 Hash 对象和 Zset 对象的底层数据结构实现之一的压缩列表,替换成由 listpack 实现。

3.压缩列表

压缩列表的最大特点,就是它被设计成一种内存紧凑型的数据结构,占用一块连续的内存空间,不仅可以利用 CPU 缓存,而且会针对不同长度的数据,进行相应编码,这种方法可以有效地节省内存开销。

但是,压缩列表的缺陷也是有的:

- 不能保存过多的元素,否则查询效率就会降低;

- 新增或修改某个元素时,压缩列表占用的内存空间需要重新分配,甚至可能引发连锁更新的问题。

因此,Redis 对象(List 对象、Hash 对象、Zset 对象)包含的元素数量较少,或者元素值不大的情况才会使用压缩列表作为底层数据结构。

接下来,就跟大家详细聊下压缩列表。

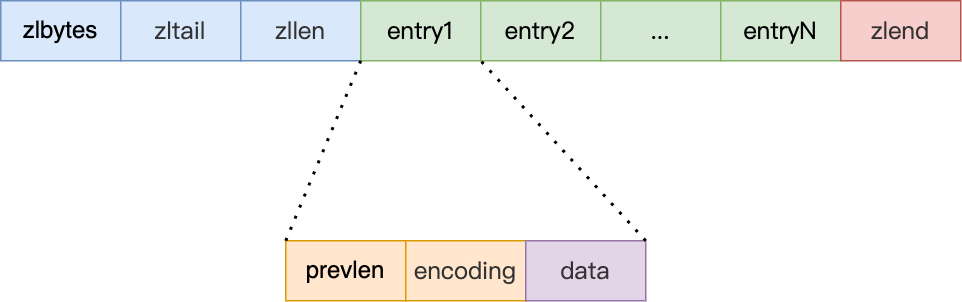

压缩列表结构设计

压缩列表是 Redis 为了节约内存而开发的,它是 由连续内存块组成的顺序型数据结构 ,有点类似于数组。

压缩列表在表头有三个字段:

- zlbytes ,记录整个压缩列表占用对内存字节数;

- zltail ,记录压缩列表「尾部」节点距离起始地址由多少字节,也就是列表尾的偏移量;

- zllen ,记录压缩列表包含的节点数量;

- zlend ,标记压缩列表的结束点,固定值 0xFF(十进制255)。

在压缩列表中,如果我们要查找定位第一个元素和最后一个元素,可以通过表头三个字段(zllen)的长度直接定位,复杂度是 O(1)。而 查找其他元素时,就没有这么高效了,只能逐个查找,此时的复杂度就是 O(N) 了,因此压缩列表不适合保存过多的元素 。

另外,压缩列表节点(entry)的构成如下:

压缩列表节点包含三部分内容:

- prevlen ,记录了「前一个节点」的长度,目的是为了实现从后向前遍历;

- encoding ,记录了当前节点实际数据的「类型和长度」,类型主要有两种:字符串和整数。

- data ,记录了当前节点的实际数据,类型和长度都由

encoding决定;

当我们往压缩列表中插入数据时,压缩列表就会根据数据类型是字符串还是整数,以及数据的大小,会使用不同空间大小的 prevlen 和 encoding 这两个元素里保存的信息, 这种根据数据大小和类型进行不同的空间大小分配的设计思想,正是 Redis 为了节省内存而采用的 。

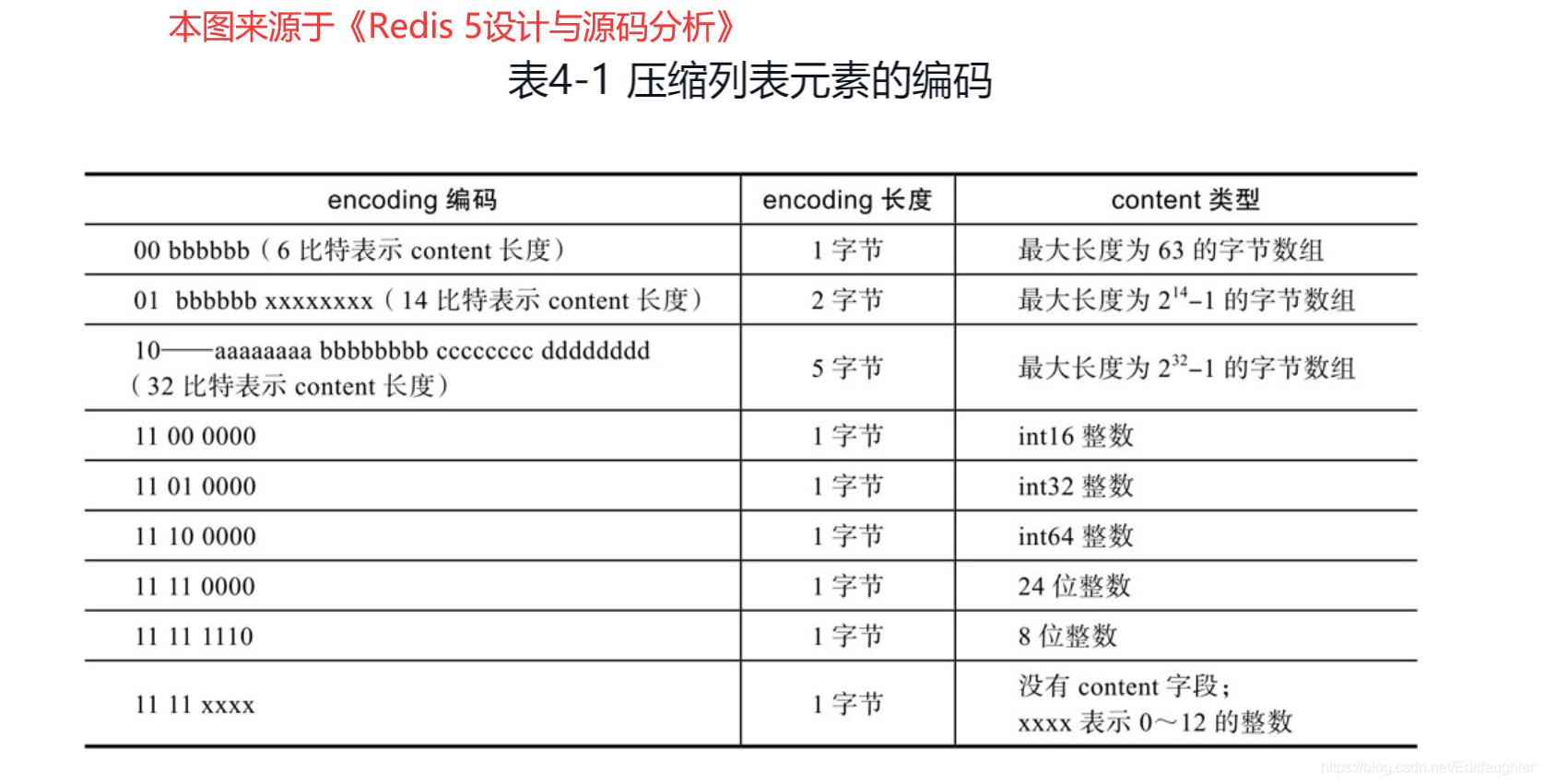

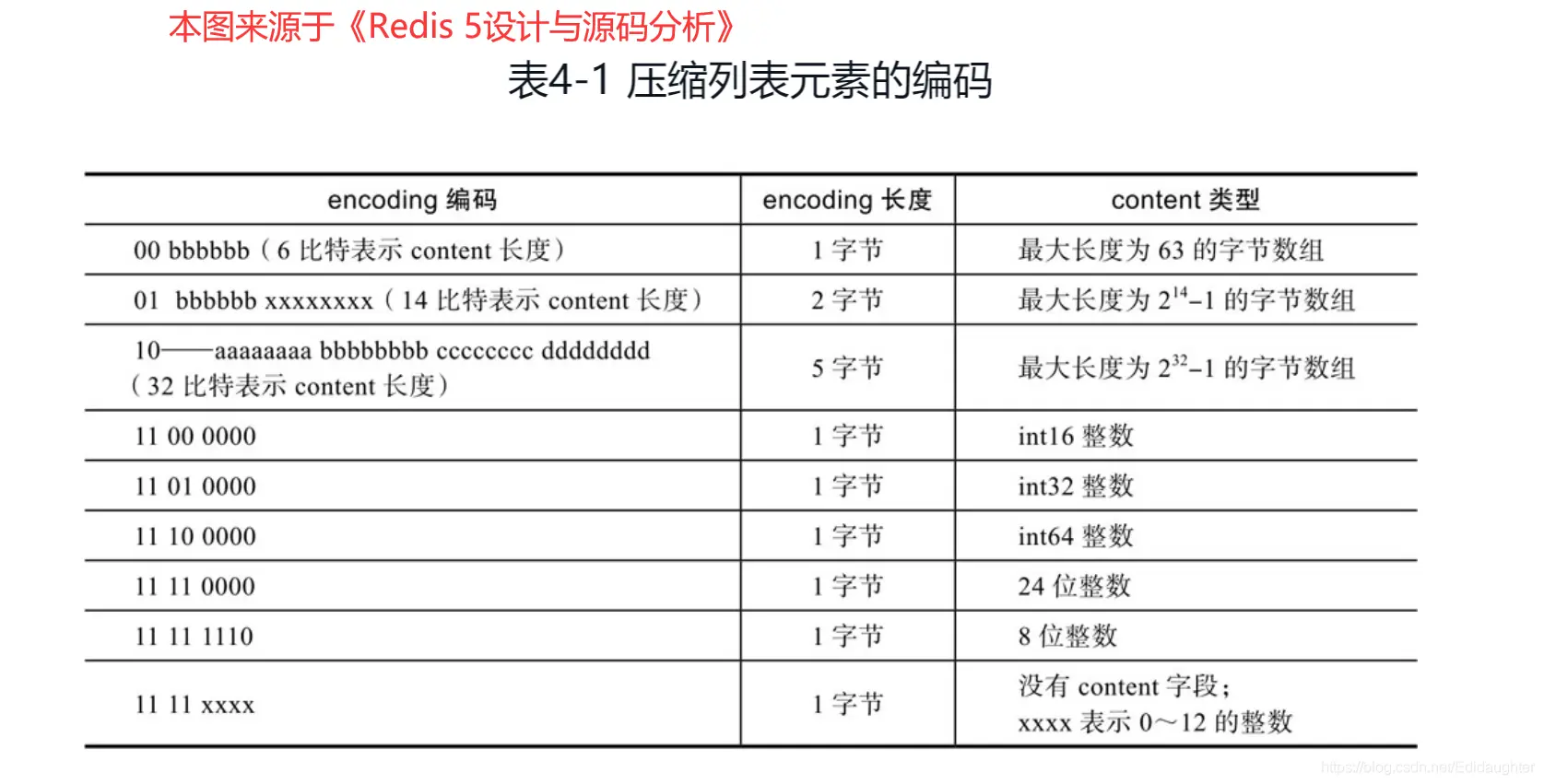

分别说下,prevlen 和 encoding 是如何根据数据的大小和类型来进行不同的空间大小分配。

压缩列表里的每个节点中的 prevlen 属性都记录了「前一个节点的长度」,而且 prevlen 属性的空间大小跟前一个节点长度值有关,比如:

- 如果 前一个节点的长度小于 254 字节 ,那么 prevlen 属性需要用 1 字节的空间来保存这个长度值;

- 如果 前一个节点的长度大于等于 254 字节 ,那么 prevlen 属性需要用 5 字节的空间来保存这个长度值;

encoding 属性的空间大小跟数据是字符串还是整数,以及字符串的长度有关,如下图(下图中的 content 表示的是实际数据,即本文的 data 字段):

- 如果 当前节点的数据是整数 ,则 encoding 会使用 1 字节的空间进行编码,也就是 encoding 长度为 1 字节。通过 encoding 确认了整数类型,就可以确认整数数据的实际大小了,比如如果 encoding 编码确认了数据是 int16 整数,那么 data 的长度就是 int16 的大小。

- 如果 当前节点的数据是字符串,根据字符串的长度大小 ,encoding 会使用 1 字节/2字节/5字节的空间进行编码,encoding 编码的前两个 bit 表示数据的类型,后续的其他 bit 标识字符串数据的实际长度,即 data 的长度。

连锁更新

压缩列表除了查找复杂度高的问题,还有一个问题。

压缩列表新增某个元素或修改某个元素时,如果空间不不够,压缩列表占用的内存空间就需要重新分配。而当新插入的元素较大时,可能会导致后续元素的 prevlen 占用空间都发生变化,从而引起「连锁更新」问题,导致每个元素的空间都要重新分配,造成访问压缩列表性能的下降 。

前面提到,压缩列表节点的 prevlen 属性会根据前一个节点的长度进行不同的空间大小分配:

- 如果前一个 节点的长度小于 254 字节 ,那么 prevlen 属性需要用 1 字节的空间来保存这个长度值;

- 如果前一个 节点的长度大于等于 254 字节 ,那么 prevlen 属性需要用 5 字节的空间来保存这个长度值;

现在假设一个压缩列表中有多个连续的、长度在 250~253 之间的节点,如下图:

因为这些节点长度值小于 254 字节,所以 prevlen 属性需要用 1 字节的空间来保存这个长度值。

这时,如果将一个长度大于等于 254 字节的新节点加入到压缩列表的表头节点,即新节点将成为 e1 的前置节点,如下图:

因为 e1 节点的 prevlen 属性只有 1 个字节大小,无法保存新节点的长度,此时就需要对压缩列表的空间重分配操作,并将 e1 节点的 prevlen 属性从原来的 1 字节大小扩展为 5 字节大小。

多米诺牌的效应就此开始。

e1 原本的长度在 250~253 之间,因为刚才的扩展空间,此时 e1 的长度就大于等于 254 了,因此原本 e2 保存 e1 的 prevlen 属性也必须从 1 字节扩展至 5 字节大小。

正如扩展 e1 引发了对 e2 扩展一样,扩展 e2 也会引发对 e3 的扩展,而扩展 e3 又会引发对 e4 的扩展… 一直持续到结尾。

这种在特殊情况下产生的连续多次空间扩展操作就叫做「连锁更新」 ,就像多米诺牌的效应一样,第一张牌倒下了,推动了第二张牌倒下;第二张牌倒下,又推动了第三张牌倒下…,

压缩列表的缺陷

空间扩展操作也就是重新分配内存,因此 连锁更新一旦发生,就会导致压缩列表占用的内存空间要多次重新分配,这就会直接影响到压缩列表的访问性能 。

所以说, 虽然压缩列表紧凑型的内存布局能节省内存开销,但是如果保存的元素数量增加了,或是元素变大了,会导致内存重新分配,最糟糕的是会有「连锁更新」的问题 。

因此, 压缩列表只会用于保存的节点数量不多的场景 ,只要节点数量足够小,即使发生连锁更新,也是能接受的。

虽说如此,Redis 针对压缩列表在设计上的不足,在后来的版本中,新增设计了两种数据结构:quicklist(Redis 3.2 引入) 和 listpack(Redis 5.0 引入)。这两种数据结构的设计目标,就是尽可能地保持压缩列表节省内存的优势,同时解决压缩列表的「连锁更新」的问题。

4.hash表

哈希表是一种保存键值对(key-value)的数据结构。

哈希表中的每一个 key 都是独一无二的,程序可以根据 key 查找到与之关联的 value,或者通过 key 来更新 value,又或者根据 key 来删除整个 key-value等等。

在讲压缩列表的时候,提到过 Redis 的 Hash 对象的底层实现之一是压缩列表(最新 Redis 代码已将压缩列表替换成 listpack)。Hash 对象的另外一个底层实现就是哈希表。

哈希表优点在于,它 能以 O(1) 的复杂度快速查询数据 。怎么做到的呢?将 key 通过 Hash 函数的计算,就能定位数据在表中的位置,因为哈希表实际上是数组,所以可以通过索引值快速查询到数据。

但是存在的风险也是有,在哈希表大小固定的情况下,随着数据不断增多,那么哈希冲突的可能性也会越高。

解决哈希冲突的方式,有很多种。

Redis 采用了「链式哈希」来解决哈希冲突 ,在不扩容哈希表的前提下,将具有相同哈希值的数据串起来,形成链接起,以便这些数据在表中仍然可以被查询到。

接下来,详细说说哈希表。

哈希表结构设计

Redis 的哈希表结构如下:

typedef struct dictht {

//哈希表数组

dictEntry **table;

//哈希表大小

unsigned long size;

//哈希表大小掩码,用于计算索引值

unsigned long sizemask;

//该哈希表已有的节点数量

unsigned long used;

} dictht;

可以看到,哈希表是一个数组(dictEntry **table),数组的每个元素是一个指向「哈希表节点(dictEntry)」的指针。

哈希表节点的结构如下:

typedef struct dictEntry {

//键值对中的键

void *key;

//键值对中的值

union {

void *val;

uint64_t u64;

int64_t s64;

double d;

} v;

//指向下一个哈希表节点,形成链表

struct dictEntry *next;

} dictEntry;

dictEntry 结构里不仅包含指向键和值的指针,还包含了指向下一个哈希表节点的指针,这个指针可以将多个哈希值相同的键值对链接起来,以此来解决哈希冲突的问题,这就是链式哈希。

另外,这里还跟你提一下,dictEntry 结构里键值对中的值是一个「联合体 v」定义的,因此,键值对中的值可以是一个指向实际值的指针,或者是一个无符号的 64 位整数或有符号的 64 位整数或double 类的值。这么做的好处是可以节省内存空间,因为当「值」是整数或浮点数时,就可以将值的数据内嵌在 dictEntry 结构里,无需再用一个指针指向实际的值,从而节省了内存空间。

哈希冲突

哈希表实际上是一个数组,数组里多每一个元素就是一个哈希桶。

当一个键值对的键经过 Hash 函数计算后得到哈希值,再将(哈希值 % 哈希表大小)取模计算,得到的结果值就是该 key-value 对应的数组元素位置,也就是第几个哈希桶。

什么是哈希冲突呢?

举个例子,有一个可以存放 8 个哈希桶的哈希表。key1 经过哈希函数计算后,再将「哈希值 % 8 」进行取模计算,结果值为 1,那么就对应哈希桶 1,类似的,key9 和 key10 分别对应哈希桶 1 和桶 6。

此时,key1 和 key9 对应到了相同的哈希桶中,这就发生了哈希冲突。

因此,**当有两个以上数量的 kay 被分配到了哈希表中同一个哈希桶上时,此时称这些 key 发生了冲突。

链式哈希

Redis 采用了「 链式哈希 」的方法来解决哈希冲突。

链式哈希是怎么实现的?

实现的方式就是每个哈希表节点都有一个 next 指针,用于指向下一个哈希表节点,因此多个哈希表节点可以用 next 指针构成一个单项链表, 被分配到同一个哈希桶上的多个节点可以用这个单项链表连接起来 ,这样就解决了哈希冲突。

还是用前面的哈希冲突例子,key1 和 key9 经过哈希计算后,都落在同一个哈希桶,链式哈希的话,key1 就会通过 next 指针指向 key9,形成一个单向链表。

不过,链式哈希局限性也很明显,随着链表长度的增加,在查询这一位置上的数据的耗时就会增加,毕竟链表的查询的时间复杂度是 O(n)。

要想解决这一问题,就需要进行 rehash,也就是对哈希表的大小进行扩展。

接下来,看看 Redis 是如何实现的 rehash 的。

rehash

哈希表结构设计的这一小节,我给大家介绍了 Redis 使用 dictht 结构体表示哈希表。不过,在实际使用哈希表时,Redis 定义一个 dict 结构体,这个结构体里定义了 两个哈希表(ht[2]) 。

typedef struct dict {

…

//两个Hash表,交替使用,用于rehash操作

dictht ht[2];

…

} dict;

之所以定义了 2 个哈希表,是因为进行 rehash 的时候,需要用上 2 个哈希表了。

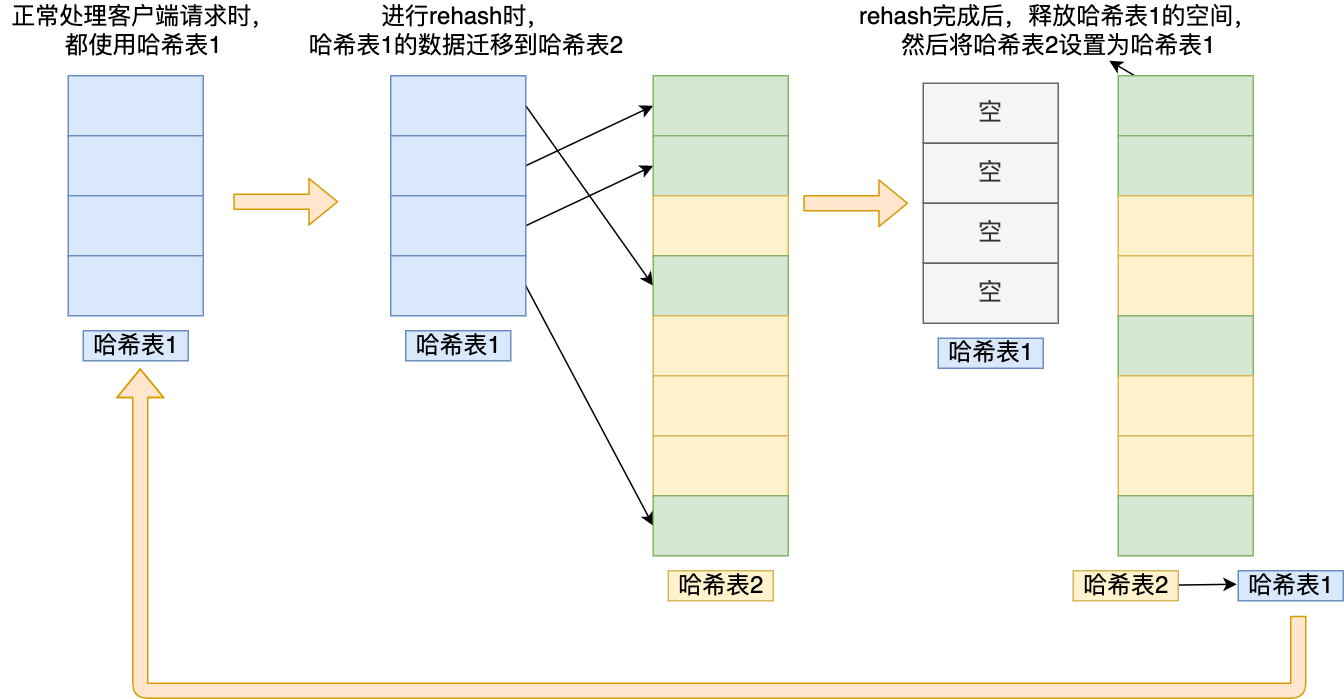

在正常服务请求阶段,插入的数据,都会写入到「哈希表 1」,此时的「哈希表 2 」 并没有被分配空间。

随着数据逐步增多,触发了 rehash 操作,这个过程分为三步:

- 给「哈希表 2」 分配空间,一般会比「哈希表 1」 大 2 倍;

- 将「哈希表 1 」的数据迁移到「哈希表 2」 中;

- 迁移完成后,「哈希表 1 」的空间会被释放,并把「哈希表 2」 设置为「哈希表 1」,然后在「哈希表 2」 新创建一个空白的哈希表,为下次 rehash 做准备。

为了方便你理解,我把 rehash 这三个过程画在了下面这张图:

这个过程看起来简单,但是其实第二步很有问题, 如果「哈希表 1 」的数据量非常大,那么在迁移至「哈希表 2 」的时候,因为会涉及大量的数据拷贝,此时可能会对 Redis 造成阻塞,无法服务其他请求 。

渐进式 rehash

为了避免 rehash 在数据迁移过程中,因拷贝数据的耗时,影响 Redis 性能的情况,所以 Redis 采用了 渐进式 rehash ,也就是将数据的迁移的工作不再是一次性迁移完成,而是分多次迁移。

渐进式 rehash 步骤如下:

- 给「哈希表 2」 分配空间;

- 在 rehash 进行期间,每次哈希表元素进行新增、删除、查找或者更新操作时,Redis 除了会执行对应的操作之外,还会顺序将「哈希表 1 」中索引位置上的所有 key-value 迁移到「哈希表 2」 上 ;

- 随着处理客户端发起的哈希表操作请求数量越多,最终在某个时间点会把「哈希表 1 」的所有 key-value 迁移到「哈希表 2」,从而完成 rehash 操作。

这样就巧妙地把一次性大量数据迁移工作的开销,分摊到了多次处理请求的过程中,避免了一次性 rehash 的耗时操作。

在进行渐进式 rehash 的过程中,会有两个哈希表,所以在渐进式 rehash 进行期间,哈希表元素的删除、查找、更新等操作都会在这两个哈希表进行。

比如,查找一个 key 的值的话,先会在「哈希表 1」 里面进行查找,如果没找到,就会继续到哈希表 2 里面进行找到。

另外,在渐进式 rehash 进行期间,新增一个 key-value 时,会被保存到「哈希表 2 」里面,而「哈希表 1」 则不再进行任何添加操作,这样保证了「哈希表 1 」的 key-value 数量只会减少,随着 rehash 操作的完成,最终「哈希表 1 」就会变成空表。

rehash 触发条件

介绍了 rehash 那么多,还没说什么时情况下会触发 rehash 操作呢?

rehash 的触发条件跟**负载因子(load factor)**有关系。

负载因子可以通过下面这个公式计算:

触发 rehash 操作的条件,主要有两个:

- 当负载因子大于等于 1 ,并且 Redis 没有在执行 bgsave 命令或者 bgrewiteaof 命令,也就是没有执行 RDB 快照或没有进行 AOF 重写的时候,就会进行 rehash 操作。

- 当负载因子大于等于 5 时,此时说明哈希冲突非常严重了,不管有没有有在执行 RDB 快照或 AOF 重写,都会强制进行 rehash 操作。

5.整数集合

整数集合是 Set 对象的底层实现之一。当一个 Set 对象只包含整数值元素,并且元素数量不大时,就会使用整数集这个数据结构作为底层实现。

整数集合结构设计

整数集合本质上是一块连续内存空间,它的结构定义如下:

typedef struct intset {

//编码方式

uint32_t encoding;

//集合包含的元素数量

uint32_t length;

//保存元素的数组

int8_t contents[];

} intset;

可以看到,保存元素的容器是一个 contents 数组,虽然 contents 被声明为 int8_t 类型的数组,但是实际上 contents 数组并不保存任何 int8_t 类型的元素,contents 数组的真正类型取决于 intset 结构体里的 encoding 属性的值。比如:

- 如果 encoding 属性值为 INTSET_ENC_INT16,那么 contents 就是一个 int16_t 类型的数组,数组中每一个元素的类型都是 int16_t;

- 如果 encoding 属性值为 INTSET_ENC_INT32,那么 contents 就是一个 int32_t 类型的数组,数组中每一个元素的类型都是 int32_t;

- 如果 encoding 属性值为 INTSET_ENC_INT64,那么 contents 就是一个 int64_t 类型的数组,数组中每一个元素的类型都是 int64_t;

不同类型的 contents 数组,意味着数组的大小也会不同。

整数集合的升级操作

整数集合会有一个升级规则,就是当我们将一个新元素加入到整数集合里面,如果新元素的类型(int32_t)比整数集合现有所有元素的类型(int16_t)都要长时,整数集合需要先进行升级,也就是按新元素的类型(int32_t)扩展 contents 数组的空间大小,然后才能将新元素加入到整数集合里,当然升级的过程中,也要维持整数集合的有序性。

整数集合升级的过程不会重新分配一个新类型的数组,而是在原本的数组上扩展空间,然后在将每个元素按间隔类型大小分割,如果 encoding 属性值为 INTSET_ENC_INT16,则每个元素的间隔就是 16 位。

举个例子,假设有一个整数集合里有 3 个类型为 int16_t 的元素。

现在,往这个整数集合中加入一个新元素 65535,这个新元素需要用 int32_t 类型来保存,所以整数集合要进行升级操作,首先需要为 contents 数组扩容, 在原本空间的大小之上再扩容多 80 位(4x32-3x16=80),这样就能保存下 4 个类型为 int32_t 的元素 。

扩容完 contents 数组空间大小后,需要将之前的三个元素转换为 int32_t 类型,并将转换后的元素放置到正确的位上面,并且需要维持底层数组的有序性不变,整个转换过程如下:

整数集合升级有什么好处呢?

如果要让一个数组同时保存 int16_t、int32_t、int64_t 类型的元素,最简单做法就是直接使用 int64_t 类型的数组。不过这样的话,当如果元素都是 int16_t 类型的,就会造成内存浪费的情况。

整数集合升级就能避免这种情况,如果一直向整数集合添加 int16_t 类型的元素,那么整数集合的底层实现就一直是用 int16_t 类型的数组,只有在我们要将 int32_t 类型或 int64_t 类型的元素添加到集合时,才会对数组进行升级操作。

因此,整数集合升级的好处是 节省内存资源 。

整数集合支持降级操作吗?

不支持降级操作 ,一旦对数组进行了升级,就会一直保持升级后的状态。比如前面的升级操作的例子,如果删除了 65535 元素,整数集合的数组还是 int32_t 类型的,并不会因此降级为 int16_t 类型。

6.跳表

Redis 只有 Zset 对象的底层实现用到了跳表,跳表的优势是能支持平均 O(logN) 复杂度的节点查找。

zset 结构体里有两个数据结构:一个是跳表,一个是哈希表。这样的好处是既能进行高效的范围查询,也能进行高效单点查询。

typedef struct zset {

dict *dict;

zskiplist *zsl;

} zset;

Zset 对象在执行数据插入或是数据更新的过程中,会依次在跳表和哈希表中插入或更新相应的数据,从而保证了跳表和哈希表中记录的信息一致。

Zset 对象能支持范围查询(如 ZRANGEBYSCORE 操作),这是因为它的数据结构设计采用了跳表,而又能以常数复杂度获取元素权重(如 ZSCORE 操作),这是因为它同时采用了哈希表进行索引。

可能很多人会奇怪,为什么我开头说 Zset 对象的底层数据结构是「压缩列表」或者「跳表」,而没有说哈希表呢?

Zset 对象在使用跳表作为数据结构的时候,是使用由「哈希表+跳表」组成的 struct zset,但是我们讨论的时候,都会说跳表是 Zset 对象的底层数据结构,而不会提及哈希表,是因为 struct zset 中的哈希表只是用于以常数复杂度获取元素权重,大部分操作都是跳表实现的。

接下来,详细的说下跳表。

跳表结构设计

链表在查找元素的时候,因为需要逐一查找,所以查询效率非常低,时间复杂度是O(N),于是就出现了跳表。 跳表是在链表基础上改进过来的,实现了一种「多层」的有序链表 ,这样的好处是能快读定位数据。

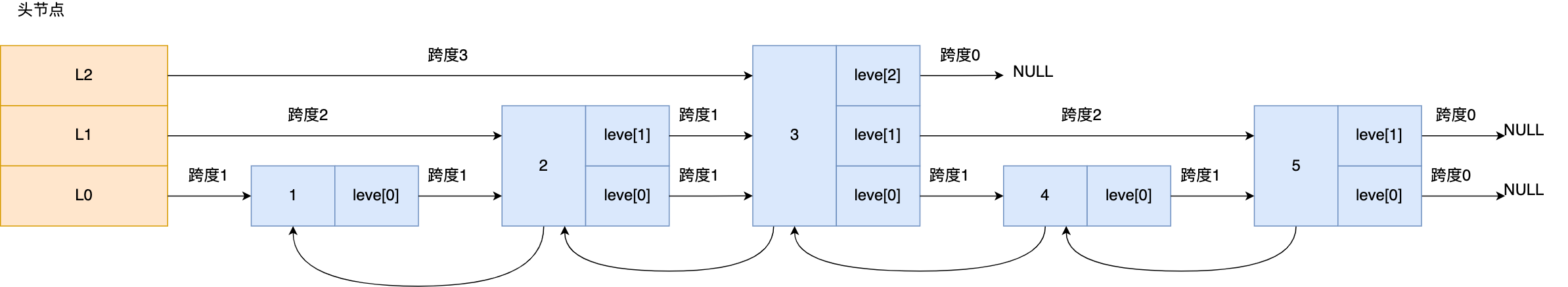

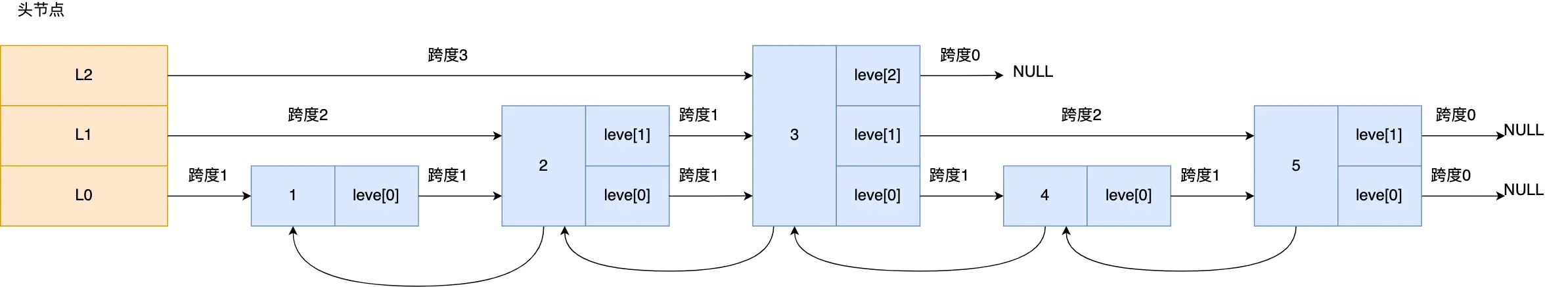

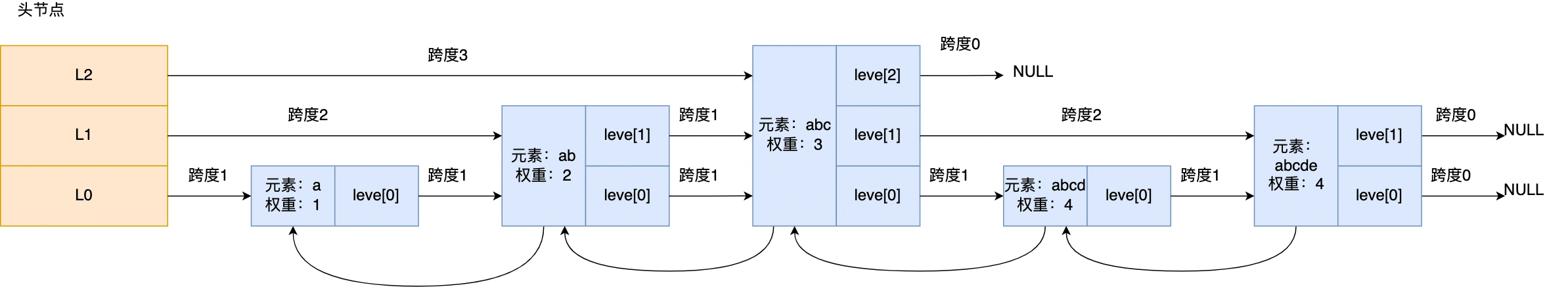

那跳表长什么样呢?我这里举个例子,下图展示了一个层级为 3 的跳表。

图中头节点有 L0~L2 三个头指针,分别指向了不同层级的节点,然后每个层级的节点都通过指针连接起来:

- L0 层级共有 5 个节点,分别是节点1、2、3、4、5;

- L1 层级共有 3 个节点,分别是节点 2、3、5;

- L2 层级只有 1 个节点,也就是节点 3 。

如果我们要在链表中查找节点 4 这个元素,只能从头开始遍历链表,需要查找 4 次,而使用了跳表后,只需要查找 2 次就能定位到节点 4,因为可以在头节点直接从 L2 层级跳到节点 3,然后再往前遍历找到节点 4。

可以看到,这个查找过程就是在多个层级上跳来跳去,最后定位到元素。当数据量很大时,跳表的查找复杂度就是 O(logN)。

那跳表节点是怎么实现多层级的呢?这就需要看「跳表节点」的数据结构了,如下:

typedef struct zskiplistNode {

//Zset 对象的元素值

sds ele;

//元素权重值

double score;

//后向指针

struct zskiplistNode *backward;

//节点的level数组,保存每层上的前向指针和跨度

struct zskiplistLevel {

struct zskiplistNode *forward;

unsigned long span;

} level[];

} zskiplistNode;

Zset 对象要同时保存「元素」和「元素的权重」,对应到跳表节点结构里就是 sds 类型的 ele 变量和 double 类型的 score 变量。每个跳表节点都有一个后向指针(struct zskiplistNode *backward),指向前一个节点,目的是为了方便从跳表的尾节点开始访问节点,这样倒序查找时很方便。

跳表是一个带有层级关系的链表,而且每一层级可以包含多个节点,每一个节点通过指针连接起来,实现这一特性就是靠跳表节点结构体中的 zskiplistLevel 结构体类型的 level 数组 。

level 数组中的每一个元素代表跳表的一层,也就是由 zskiplistLevel 结构体表示,比如 leve[0] 就表示第一层,leve[1] 就表示第二层。zskiplistLevel 结构体里定义了「指向下一个跳表节点的指针」和「跨度」,跨度时用来记录两个节点之间的距离。

比如,下面这张图,展示了各个节点的跨度。

第一眼看到跨度的时候,以为是遍历操作有关,实际上并没有任何关系,遍历操作只需要用前向指针(struct zskiplistNode *forward)就可以完成了。

跨度实际上是为了计算这个节点在跳表中的排位 。具体怎么做的呢?因为跳表中的节点都是按序排列的,那么计算某个节点排位的时候,从头节点点到该结点的查询路径上,将沿途访问过的所有层的跨度累加起来,得到的结果就是目标节点在跳表中的排位。

举个例子,查找图中节点 3 在跳表中的排位,从头节点开始查找节点 3,查找的过程只经过了一个层(L2),并且层的跨度是 3,所以节点 3 在跳表中的排位是 3。

另外,图中的头节点其实也是 zskiplistNode 跳表节点,只不过头节点的后向指针、权重、元素值都没有用到,所以图中省略了这部分。

问题来了,由谁定义哪个跳表节点是头节点呢?这就介绍「跳表」结构体了,如下所示:

typedef struct zskiplist {

struct zskiplistNode *header, *tail;

unsigned long length;

int level;

} zskiplist;

跳表结构里包含了:

- 跳表的头尾节点,便于在O(1)时间复杂度内访问跳表的头节点和尾节点;

- 跳表的长度,便于在O(1)时间复杂度获取跳表节点的数量;

- 跳表的最大层数,便于在O(1)时间复杂度获取跳表中层高最大的那个节点的层数量;

跳表节点查询过程

查找一个跳表节点的过程时,跳表会从头节点的最高层开始,逐一遍历每一层。在遍历某一层的跳表节点时,会用跳表节点中的 SDS 类型的元素和元素的权重来进行判断,共有两个判断条件:

- 如果当前节点的权重「小于」要查找的权重时,跳表就会访问该层上的下一个节点。

- 如果当前节点的权重「等于」要查找的权重时,并且当前节点的 SDS 类型数据「小于」要查找的数据时,跳表就会访问该层上的下一个节点。

如果上面两个条件都不满足,或者下一个节点为空时,跳表就会使用目前遍历到的节点的 level 数组里的下一层指针,然后沿着下一层指针继续查找,这就相当于跳到了下一层接着查找。

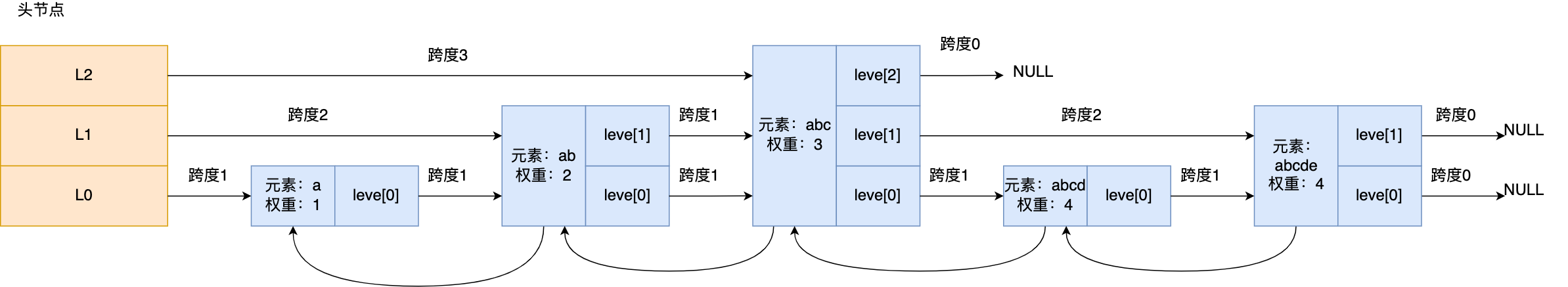

举个例子,下图有个 3 层级的跳表。

如果要查找「元素:abcd,权重:4」的节点,查找的过程是这样的:

- 先从头节点的最高层开始,L2 指向了「元素:abc,权重:3」节点,这个节点的权重比要查找节点的小,所以要访问该层上的下一个节点;

- 但是该层的下一个节点是空节点( leve[2]指向的是空节点),于是就会跳到「元素:abc,权重:3」节点的下一层去找,也就是 leve[1];

- 「元素:abc,权重:3」节点的 leve[1] 的下一个指针指向了「元素:abcde,权重:4」的节点,然后将其和要查找的节点比较。虽然「元素:abcde,权重:4」的节点的权重和要查找的权重相同,但是当前节点的 SDS 类型数据「大于」要查找的数据,所以会继续跳到「元素:abc,权重:3」节点的下一层去找,也就是 leve[0];

- 「元素:abc,权重:3」节点的 leve[0] 的下一个指针指向了「元素:abcd,权重:4」的节点,该节点正是要查找的节点,查询结束。

跳表节点层数设置

跳表的相邻两层的节点数量的比例会影响跳表的查询性能。

举个例子,下图的跳表,第二层的节点数量只有 1 个,而第一层的节点数量有 6 个。

这时,如果想要查询节点 6,那基本就跟链表的查询复杂度一样,就需要在第一层的节点中依次顺序查找,复杂度就是 O(N) 了。所以,为了降低查询复杂度,我们就需要维持相邻层结点数间的关系。

跳表的相邻两层的节点数量最理想的比例是 2:1,查找复杂度可以降低到 O(logN) 。

下图的跳表就是,相邻两层的节点数量的比例是 2 : 1。

那怎样才能维持相邻两层的节点数量的比例为 2 : 1 呢?

如果采用新增节点或者删除节点时,来调整跳表节点以维持比例的方法的话,会带来额外的开销。

Redis 则采用一种巧妙的方法是, 跳表在创建节点的时候,随机生成每个节点的层数 ,并没有严格维持相邻两层的节点数量比例为 2 : 1 的情况。

具体的做法是, 跳表在创建节点时候,会生成范围为[0-1]的一个随机数,如果这个随机数小于 0.25(相当于概率 25%),那么层数就增加 1 层,然后继续生成下一个随机数,直到随机数的结果大于 0.25 结束,最终确定该节点的层数 。

这样的做法,相当于每增加一层的概率不超过 25%,层数越高,概率越低,层高最大限制是 64。

为什么用跳表而不用平衡树?

这里插一个常见的面试题:为什么 Zset 的实现用跳表而不用平衡树(如 AVL树、红黑树等)?

对于这个问题 (opens new window),Redis的作者 @antirez 是怎么说的:

There are a few reasons:

- They are not very memory intensive. It’s up to you basically. Changing parameters about the probability of a node to have a given number of levels will make then less memory intensive than btrees.

- A sorted set is often target of many ZRANGE or ZREVRANGE operations, that is, traversing the skip list as a linked list. With this operation the cache locality of skip lists is at least as good as with other kind of balanced trees.

- They are simpler to implement, debug, and so forth. For instance thanks to the skip list simplicity I received a patch (already in Redis master) with augmented skip lists implementing ZRANK in O(log(N)). It required little changes to the code.

简单翻译一下,主要是从内存占用、对范围查找的支持、实现难易程度这三方面总结的原因:

- 它们不是非常内存密集型的。基本上由你决定。改变关于节点具有给定级别数的概率的参数将使其比 btree 占用更少的内存。

- Zset 经常需要执行 ZRANGE 或 ZREVRANGE 的命令,即作为链表遍历跳表。通过此操作,跳表的缓存局部性至少与其他类型的平衡树一样好。

- 它们更易于实现、调试等。例如,由于跳表的简单性,我收到了一个补丁(已经在Redis master中),其中扩展了跳表,在 O(log(N) 中实现了 ZRANK。它只需要对代码进行少量修改。

我再详细补充点:

- 从内存占用上来比较,跳表比平衡树更灵活一些 。平衡树每个节点包含 2 个指针(分别指向左右子树),而跳表每个节点包含的指针数目平均为 1/(1-p),具体取决于参数 p 的大小。如果像 Redis里的实现一样,取 p=1/4,那么平均每个节点包含 1.33 个指针,比平衡树更有优势。

- 在做范围查找的时候,跳表比平衡树操作要简单 。在平衡树上,我们找到指定范围的小值之后,还需要以中序遍历的顺序继续寻找其它不超过大值的节点。如果不对平衡树进行一定的改造,这里的中序遍历并不容易实现。而在跳表上进行范围查找就非常简单,只需要在找到小值之后,对第 1 层链表进行若干步的遍历就可以实现。

- 从算法实现难度上来比较,跳表比平衡树要简单得多 。平衡树的插入和删除操作可能引发子树的调整,逻辑复杂,而跳表的插入和删除只需要修改相邻节点的指针,操作简单又快速。

7.quicklist

quicklist 的结构体跟链表的结构体类似,都包含了表头和表尾,区别在于 quicklist 的节点是 quicklistNode。

typedef struct quicklist {

//quicklist的链表头

quicklistNode *head; //quicklist的链表头

//quicklist的链表头

quicklistNode *tail;

//所有压缩列表中的总元素个数

unsigned long count;

//quicklistNodes的个数

unsigned long len;

...

} quicklist;

接下来看看,quicklistNode 的结构定义:

typedef struct quicklistNode {

//前一个quicklistNode

struct quicklistNode *prev; //前一个quicklistNode

//下一个quicklistNode

struct quicklistNode *next; //后一个quicklistNode

//quicklistNode指向的压缩列表

unsigned char *zl;

//压缩列表的的字节大小

unsigned int sz;

//压缩列表的元素个数

unsigned int count : 16; //ziplist中的元素个数

....

} quicklistNode;

可以看到,quicklistNode 结构体里包含了前一个节点和下一个节点指针,这样每个 quicklistNode 形成了一个双向链表。但是链表节点的元素不再是单纯保存元素值,而是保存了一个压缩列表,所以 quicklistNode 结构体里有个指向压缩列表的指针 *zl。

我画了一张图,方便你理解 quicklist 数据结构。

在向 quicklist 添加一个元素的时候,不会像普通的链表那样,直接新建一个链表节点。而是会检查插入位置的压缩列表是否能容纳该元素,如果能容纳就直接保存到 quicklistNode 结构里的压缩列表,如果不能容纳,才会新建一个新的 quicklistNode 结构。

quicklist 会控制 quicklistNode 结构里的压缩列表的大小或者元素个数,来规避潜在的连锁更新的风险,但是这并没有完全解决连锁更新的问题。

8.listpark

quicklist 虽然通过控制 quicklistNode 结构里的压缩列表的大小或者元素个数,来减少连锁更新带来的性能影响,但是并没有完全解决连锁更新的问题。

因为 quicklistNode 还是用了压缩列表来保存元素,压缩列表连锁更新的问题,来源于它的结构设计,所以要想彻底解决这个问题,需要设计一个新的数据结构。

于是,Redis 在 5.0 新设计一个数据结构叫 listpack,目的是替代压缩列表,它最大特点是 listpack 中每个节点不再包含前一个节点的长度了,压缩列表每个节点正因为需要保存前一个节点的长度字段,就会有连锁更新的隐患。

我看了 Redis 的 Github,在最新 6.2 发行版本中,Redis Hash 对象、ZSet 对象的底层数据结构的压缩列表还未被替换成 listpack,而 Redis 的最新代码(还未发布版本)已经将所有用到压缩列表底层数据结构的 Redis 对象替换成 listpack 数据结构来实现,估计不久将来,Redis 就会发布一个将压缩列表为 listpack 的发行版本 。

listpack 结构设计

listpack 采用了压缩列表的很多优秀的设计,比如还是用一块连续的内存空间来紧凑地保存数据,并且为了节省内存的开销,listpack 节点会采用不同的编码方式保存不同大小的数据。

我们先看看 listpack 结构:

listpack 头包含两个属性,分别记录了 listpack 总字节数和元素数量,然后 listpack 末尾也有个结尾标识。图中的 listpack entry 就是 listpack 的节点了。

每个 listpack 节点结构如下:

主要包含三个方面内容:

- encoding,定义该元素的编码类型,会对不同长度的整数和字符串进行编码;

- data,实际存放的数据;

- len,encoding+data的总长度;

可以看到, listpack 没有压缩列表中记录前一个节点长度的字段了,listpack 只记录当前节点的长度,当我们向 listpack 加入一个新元素的时候,不会影响其他节点的长度字段的变化,从而避免了压缩列表的连锁更新问题 。

redis的内存淘汰策略

过期删除策略,是删除已过期的 key,而当 Redis 的运行内存已经超过 Redis 设置的最大内存之后,则会使用内存淘汰策略删除符合条件的 key,以此来保障 Redis 高效的运行。

如何设置redis最大内存

在配置文件 redis.conf 中,可以通过参数 maxmemory <bytes> 来设定最大运行内存,只有在 Redis 的运行内存达到了我们设置的最大运行内存,才会触发内存淘汰策略。 不同位数的操作系统,maxmemory 的默认值是不同的:

- 在 64 位操作系统中,maxmemory 的默认值是 0,表示没有内存大小限制,那么不管用户存放多少数据到 Redis 中,Redis 也不会对可用内存进行检查,直到 Redis 实例因内存不足而崩溃也无作为。

- 在 32 位操作系统中,maxmemory 的默认值是 3G,因为 32 位的机器最大只支持 4GB 的内存,而系统本身就需要一定的内存资源来支持运行,所以 32 位操作系统限制最大 3 GB 的可用内存是非常合理的,这样可以避免因为内存不足而导致 Redis 实例崩溃

redis内存淘汰策略有哪些?

一共有8种内存淘汰策略。8种分为不进行数据淘汰和进行数据淘汰两种。

1、不进行数据淘汰的策略

noeviction (Redis3.0之后,默认的内存淘汰策略) :它表示当运行内存超过最大设置内存时,不淘汰任何数据,而是不再提供服务,直接返回错误。

2、进行数据淘汰的策略

针对「进行数据淘汰」这一类策略,又可以细分为「在设置了过期时间的数据中进行淘汰」和「在所有数据范围内进行淘汰」这两类策略。

在设置了过期时间的数据中进行淘汰:

- volatile-random :随机淘汰设置了过期时间的任意键值;

- volatile-ttl :优先淘汰更早过期的键值。

- volatile-lru (Redis3.0 之前,默认的内存淘汰策略):淘汰所有设置了过期时间的键值中,最久未使用的键值;(根据访问时间来淘汰)

- volatile-lfu (Redis 4.0 后新增的内存淘汰策略):淘汰所有设置了过期时间的键值中,最少使用的键值;(根据访问次数来淘汰)

在所有数据范围内进行淘汰:

- allkeys-random :随机淘汰任意键值;

- allkeys-lru :淘汰整个键值中最久未使用的键值;

- allkeys-lfu (Redis 4.0 后新增的内存淘汰策略):淘汰整个键值中最少使用的键值。

如何查看内存淘汰策略

可以使用config get maxmemory-policy指令获取

127.0.0.1:6379> config get maxmemory-policy

1) "maxmemory-policy"

2) "noeviction"

可以看出,当前 Redis 使用的是 noeviction 类型的内存淘汰策略,它是 Redis 3.0 之后默认使用的内存淘汰策略,表示当运行内存超过最大设置内存时,不淘汰任何数据,但新增操作会报错。

如何修改内存淘汰策略

- 方式一:通过“

config set maxmemory-policy <策略>”命令设置。它的优点是设置之后立即生效,不需要重启 Redis 服务,缺点是重启 Redis 之后,设置就会失效。 - 方式二:通过修改 Redis 配置文件修改,设置“

maxmemory-policy <策略>”,它的优点是重启 Redis 服务后配置不会丢失,缺点是必须重启 Redis 服务,设置才能生效。

LRU和LFU算法的区别

LRU算法

LRU 全称是 Least Recently Used 翻译为 最近最少使用 ,会选择淘汰最近最少使用的数据。

传统 LRU 算法的实现是基于「链表」结构,链表中的元素按照操作顺序从前往后排列,最新操作的键会被移动到表头,当需要内存淘汰时,只需要删除链表尾部的元素即可,因为链表尾部的元素就代表最久未被使用的元素。

Redis 并没有使用这样的方式实现 LRU 算法,因为传统的 LRU 算法存在两个问题:

- 需要用链表管理所有的缓存数据,这会带来额外的空间开销;

- 当有数据被访问时,需要在链表上把该数据移动到头端,如果有大量数据被访问,就会带来很多链表移动操作,会很耗时,进而会降低 Redis 缓存性能。

redis实现LRU

Redis 实现的是一种 近似 LRU 算法 ,目的是为了更好的节约内存,它的 实现方式是在 Redis 的对象结构体中添加一个额外的字段,用于记录此数据的最后一次访问时间 。

当 Redis 进行内存淘汰时,会使用 随机采样的方式来淘汰数据 ,它是随机取 5 个值(此值可配置),然后 淘汰最久没有使用的那个 。

Redis 实现的 LRU 算法的优点:

- 不用为所有的数据维护一个大链表,节省了空间占用;

- 不用在每次数据访问时都移动链表项,提升了缓存的性能;

但是 LRU 算法有一个问题, 无法解决缓存污染问题 ,比如应用一次读取了大量的数据,而这些数据只会被读取这一次,那么这些数据会留存在 Redis 缓存中很长一段时间,造成缓存污染。

redis实现LFU

LFU 全称是 Least Frequently Used 翻译为**最近最不常用的,**LFU 算法是根据数据访问次数来淘汰数据的,它的核心思想是“如果数据过去被访问多次,那么将来被访问的频率也更高”。

所以, LFU 算法会记录每个数据的访问次数。当一个数据被再次访问时,就会增加该数据的访问次数。这样就解决了偶尔被访问一次之后,数据留存在缓存中很长一段时间的问题,相比于 LRU 算法也更合理一些。

LFU 算法相比于 LRU 算法的实现,多记录了「数据的访问频次」的信息。Redis 对象的结构如下:

typedef struct redisObject {

...

// 24 bits,用于记录对象的访问信息

unsigned lru:24;

...

} robj;

LRU和LFU结构区别:

在 LRU 算法中 ,Redis 对象头的 24 bits 的 lru 字段是用来记录 key 的访问时间戳,因此在 LRU 模式下,Redis可以根据对象头中的 lru 字段记录的值,来比较最后一次 key 的访问时间长,从而淘汰最久未被使用的 key。

在 LFU 算法中 ,Redis对象头的 24 bits 的 lru 字段被分成两段来存储,高 16bit 存储 ldt(Last Decrement Time),低 8bit 存储 logc(Logistic Counter)。

- ldt 是用来记录 key 的访问时间戳;

- logc 是用来记录 key 的访问频次,它的值越小表示使用频率越低,越容易淘汰,每个新加入的 key 的logc 初始值为 5。

注意,logc 并不是单纯的访问次数,而是访问频次(访问频率),因为 logc 会随时间推移而衰减的 。

在每次 key 被访问时,会先对 logc 做一个衰减操作,衰减的值跟前后访问时间的差距有关系,如果上一次访问的时间与这一次访问的时间差距很大,那么衰减的值就越大,这样实现的 LFU 算法是根据访问频率来淘汰数据的,而不只是访问次数。访问频率需要考虑 key 的访问是多长时间段内发生的。key 的先前访问距离当前时间越长,那么这个 key 的访问频率相应地也就会降低,这样被淘汰的概率也会更大。

对 logc 做完衰减操作后,就开始对 logc 进行增加操作,增加操作并不是单纯的 + 1,而是根据概率增加,如果 logc 越大的 key,它的 logc 就越难再增加。

所以,Redis 在访问 key 时,对于 logc 是这样变化的:

- 先按照上次访问距离当前的时长,来对 logc 进行衰减;

- 然后,再按照一定概率增加 logc 的值

redis.conf 提供了两个配置项,用于调整 LFU 算法从而控制 logc 的增长和衰减:

lfu-decay-time用于调整 logc 的衰减速度,它是一个以分钟为单位的数值,默认值为1,lfu-decay-time 值越大,衰减越慢;lfu-log-factor用于调整 logc 的增长速度,lfu-log-factor 值越大,logc 增长越慢。

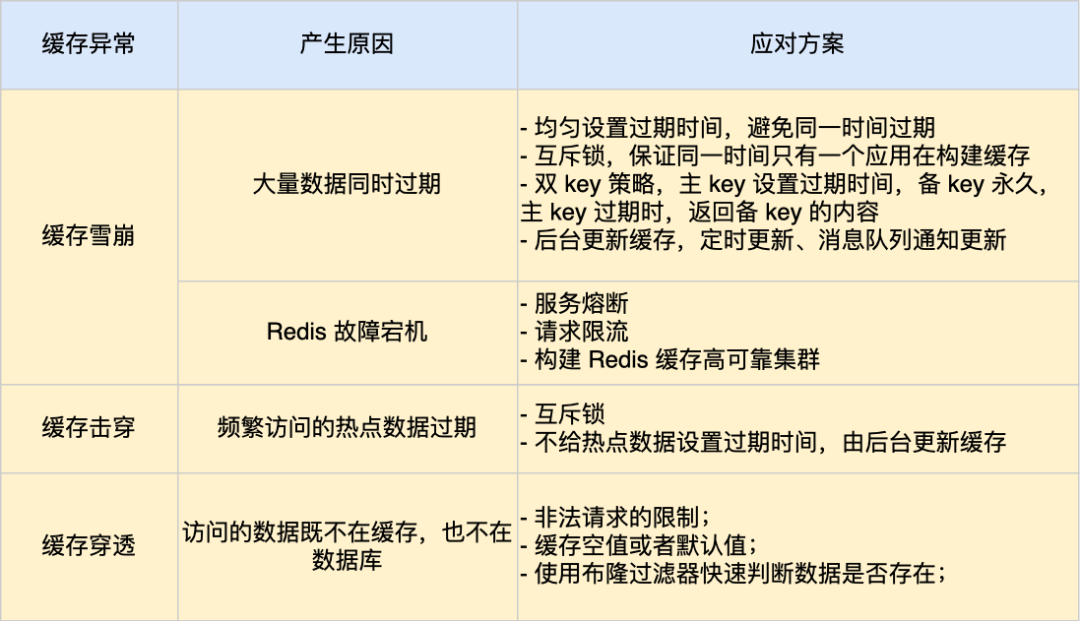

redis的缓存策略

由于数据存储受限,系统并不是将所有数据都需要存放到缓存中的,而 只是将其中一部分热点数据缓存起来 ,所以我们要设计一个热点数据动态缓存的策略。

热点数据动态缓存的策略总体思路: 通过数据最新访问时间来做排名,并过滤掉不常访问的数据,只留下经常访问的数据 。

以电商平台场景中的例子,现在要求只缓存用户经常访问的 Top 1000 的商品。具体细节如下:

- 先通过缓存系统做一个排序队列(比如存放 1000 个商品),系统会根据商品的访问时间,更新队列信息,越是最近访问的商品排名越靠前;

- 同时系统会定期过滤掉队列中排名最后的 200 个商品,然后再从数据库中随机读取出 200 个商品加入队列中;